Thinkless

Rahmenwerk für LLMs zur Optimierung des Denkens durch Wahl der Antwortkomplexität basierend auf den Anforderungen der Aufgabe.

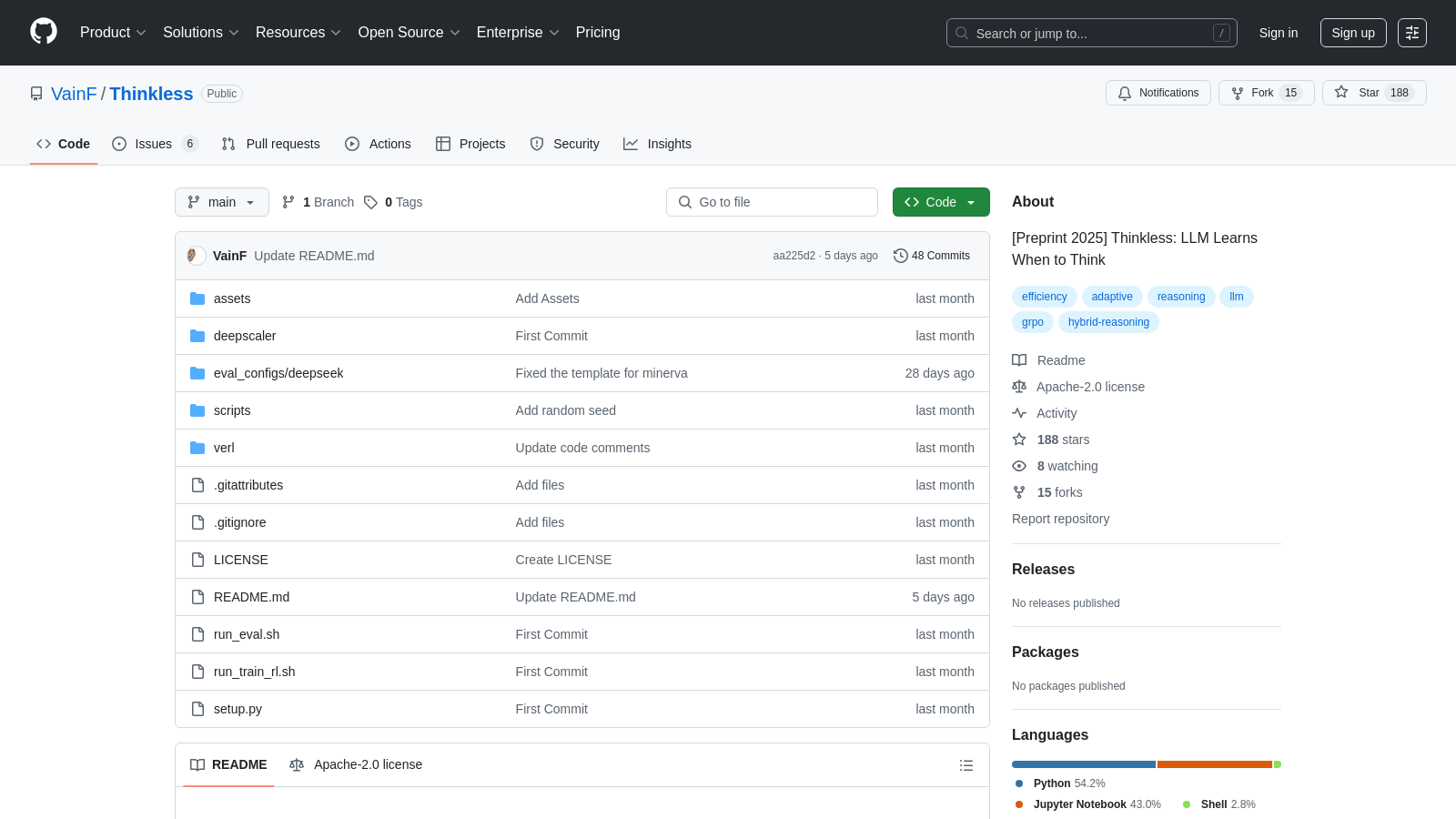

Github.comFolgen für Updates & Angebote

Erhalten Sie Benachrichtigungen für Thinkless Rabatte, neue Features & Preisänderungen

Ähnliche Tools

Was ist Thinkless?

Thinkless ist ein innovatives Framework, das für große Sprachmodelle (LLMs) entwickelt wurde, um zu lernen, wann kritisch gedacht werden soll, bevor Antworten generiert werden. Durch die Nutzung eines einzigartigen Trainingsparadigmas, das auf Verstärkungslernen basiert, zielt Thinkless darauf ab, das Denken in großen Sprachmodellen (LLMs) zu optimieren, indem es ihnen ermöglicht, zwischen kurzen und langen Antworten basierend auf der Komplexität der Aufgaben zu wählen. Kürzlich wurden signifikante Verbesserungen am Framework vorgenommen, die seine Stellung als führende Lösung für adaptives Denken in LLMs festigen.

Die Kerninnovation von Thinkless liegt in seiner ausgeklügelten Verwendung des Decoupled Group Relative Policy Optimization (DeGRPO)-Algorithmus. Dieser fortschrittliche Ansatz trennt strategisch die Lernziele in zwei verschiedene Komponenten: Eine überwacht die Wahl des Denkmodi durch einen Kontrolltoken-Verlust, während die andere die Genauigkeit der generierten Antworten über den Antwortverlust steigert. Diese sorgfältige Trennung stabilisiert nicht nur den Trainingsprozess, sondern minimiert auch die Rechnerlast, die mit dem Denken von LLMs verbunden ist, und erleichtert effizientere Abläufe. Darüber hinaus wurden Verbesserungen am Algorithmus vorgenommen, um seine Fähigkeit zu erhöhen, das Training zu stabilisieren und den Leistungsabfall zu verhindern, der oft bei naiven Implementierungen ähnlicher Methoden zu beobachten ist.

Funktionsweise

Das Herz des Thinkless-Frameworks besteht aus zwei wichtigen Kontrolltoken:

Hauptmerkmale

- Adaptives Denken: Thinkless passt seine Antwortgenerierung entsprechend der Aufgabenkomplexität und den Fähigkeiten des Modells an, was es äußerst vielseitig macht.

- Verbesserte Effizienz: Das Framework reduziert erheblich die Notwendigkeit für umfangreiche Denkwege, was mit Leistungsverbesserungen bei verschiedenen Benchmark-Tests korreliert und die Anforderungen an langes Denken um 50-90 % senkt.

- Verstärkungslernansatz: Thinkless verwendet ein Verstärkungslern-Framework, das nicht nur ein besseres Verständnis der Aufgabenkomplexität fördert, sondern auch vorhersagt, wann tiefere Überlegungen notwendig sind.

- Empirische Ergebnisse: Die neuesten Iterationen des Frameworks haben überlegene Ergebnisse in empirischen Tests gezeigt und validieren damit seinen innovativen Ansatz für das Training und das Denken von LLMs.

Installation und Nutzung

Die Einrichtung von Thinkless ist unkompliziert und kann direkt innerhalb einer Conda-Umgebung durchgeführt werden. Der Installationsprozess umfasst die Einrichtung der Python-Abhängigkeiten, das Herunterladen relevanter Modellkomponenten aus dem offiziellen Repository und die Nutzung eines einfachen Befehlszeilenprozesses zum Start des Trainings. Die Benutzer werden durch die Einrichtung mit detaillierter Dokumentation im Repository geleitet, was die Einarbeitung verbessert und Einrichtungsspielräume beseitigt.

Fazit

Zusammenfassend verkörpert Thinkless ein zukunftsorientiertes Tool, das neu definiert, wie LLMs mit komplexen Denkaufgaben umgehen, und die rechnerische Effizienz sowie die Genauigkeit der Antworten erheblich vorantreibt. Durch die Nutzung seines innovativen Designs und praktischer Anwendungen in realen Szenarien ist Thinkless eine wesentliche Ressource für Forscher und Praktiker im sich rasch entwickelnden Bereich der künstlichen Intelligenz. Das Engagement für seine fortlaufende Entwicklung stellt sicher, dass es nicht nur den aktuellen Anforderungen gerecht wird, sondern sich auch an zukünftige Bedürfnisse im Bereich der großen Sprachmodelle und des fortschrittlichen Denkens anpasst.

Vorteile & Nachteile

Vorteile

- Nutzen adaptive Schlussfolgerungen zur Verbesserung der Effizienz bei der Aufgabenerledigung.

- Verwendet ein einzigartiges Verstärkungslernmodell mit dualen Steuerungstoken.

- Reduziert die Nutzung von langkettigem Denken erheblich und verbessert die Berechnungsgeschwindigkeit.

Häufig gestellte Fragen

Thinkless ist Open Source und kostenlos zu nutzen.

Laut unseren neuesten Informationen scheint dieses Tool derzeit leider kein lebenslanges Angebot zu haben.

Der DeGRPO-Algorithmus steht im Mittelpunkt des Thinkless-Frameworks. Er zerlegt das Lernziel des hybriden Denkens in zwei separate Komponenten: einen Kontrolltoken-Verlust und einen Antwortverlust. Diese Trennung ermöglicht eine feinkörnige Kontrolle über die Beiträge jedes Ziels während des Trainings. Der Kontrolltoken-Verlust bestimmt, wie das Modell zwischen Kurz- und Langform-Denken auswählt, während der Antwortverlust die Genauigkeit der generierten Antworten verbessert. Durch die Stabilisierung des Trainings und die Verhinderung eines Zusammenbruchs verbessert DeGRPO die Leistung bei verschiedenen Denkbenchmarks erheblich.

Thinkless verbessert die rechnerische Effizienz, indem es Sprachmodellen ermöglicht, je nach Komplexität der Aufgabe und den Fähigkeiten des Modells adaptiv zwischen Kurz- und Langform-Argumentation zu wählen. Durch die Reduzierung der Notwendigkeit für langes Ketten-Denken um 50 % bis 90 % minimiert Thinkless den Ressourcenverbrauch während der Inferenz, während die Genauigkeit der Ergebnisse beibehalten oder sogar verbessert wird. Dies macht es effizienter als traditionelle Denkansätze in großen Sprachmodellen.

Um Thinkless zu installieren, müssen Sie eine Umgebung mit Python 3.10 und den erforderlichen Abhängigkeiten erstellen. Verwenden Sie dazu speziell Conda, um eine neue Umgebung zu erstellen und Pakete wie PyTorch, LM_eval und Ray zu installieren. Für CUDA-Unterstützung stellen Sie sicher, dass Sie die entsprechende Version von NVIDIA CUDA installieren. Detaillierte Installationsbefehle finden Sie in der README-Datei des Projekts auf GitHub. Achten Sie darauf, die Dokumentation zu konsultieren, um zusätzliche Anforderungen basierend auf Ihrer Systemkonfiguration zu überprüfen.

Ja, Thinkless ist so konzipiert, dass es sich mit beliebten maschinellen Lernframeworks wie PyTorch integrieren lässt, wie durch die Installation des torch-Pakets als Abhängigkeit angezeigt. Da es mit Standardwerkzeugen entwickelt wurde, können Benutzer es mit anderen Bibliotheken und Frameworks für Aufgaben wie Datenverarbeitung und zusätzliches Modelltraining verbinden. Benutzer können sich die Installations- und Gebrauchsanweisungen im GitHub-Repository ansehen, um ein besseres Verständnis für die Integration zu erhalten.

Um schnell mit Thinkless zu beginnen, müssen Sie zunächst Ihre Programmierumgebung mit der erforderlichen Python-Version und den Bibliotheken einrichten. Nachdem Sie Ihre Conda-Umgebung aktiviert haben, können Sie AutoModelForCausalLM und AutoTokenizer aus der Transformers-Bibliothek importieren. Von dort aus laden Sie das Thinkless-Modell und bereiten Ihre Eingabeaufforderungen für das Denken vor. Die Projektdokumentation enthält Beispielcodeschnipsel, die Ihnen helfen, Antworten zu generieren und die Ausgaben des Modells effektiv zu bewerten.

Sie können die Leistung des Thinkless-Modells mithilfe der im Repository bereitgestellten Evaluierungsskripte bewerten, die es Ihnen ermöglichen, mehrere Inferenzwiederholungen durchzuführen. Dies hilft dabei, Ergebnisse für verschiedene Aufgaben und Metriken zu sammeln. Das Evaluierungstool basiert auf Eingabeaufforderungen in OpenAI/simple-evals, und Sie können Evaluierungsbefehle ausführen, um Metriken aus den in calcs gespeicherten Ergebnissen zu generieren, wie z.B. Genauigkeit und Antwortqualität, die Ihnen helfen, die Fähigkeiten des Modells zu verstehen.

Während Thinkless die Effizienz bei Denkaufgaben erheblich verbessert, gehören zu den potenziellen Einschränkungen eine Abhängigkeit von der Qualität des ursprünglichen Modells und der Trainingsdaten. Der Algorithmus kann auch nicht optimal bei spezifischen, hochkomplexen Denkaufgaben funktionieren, die ein tiefes Verständnis des Kontexts erfordern. Darüber hinaus kann das Feineinstellen von Hyperparametern wie thinkless_alpha und correct_think_reward Experimente erfordern, um die besten Ergebnisse zu erzielen, was zeitaufwendig sein kann.

Zur Feinabstimmung von Thinkless könnten Sie damit beginnen, die Hyperparameter anzupassen, wie thinkless_alpha und correct_think_reward. Wenn die Konvergenz langsam ist oder das Modell zu einem bestimmten Denkmodus tendiert, ziehen Sie in Betracht, diese Parameter schrittweise zu erhöhen, um die Leistung zu verbessern. Das Experimentieren mit verschiedenen Trainingsdatensätzen und Techniken, die in der Projektdokumentation beschrieben sind, kann ebenfalls helfen, die Leistung basierend auf Ihrem spezifischen Anwendungsfall zu optimieren.