Folgen für Updates & Angebote

Erhalten Sie Benachrichtigungen für vui Rabatte, neue Features & Preisänderungen

Ähnliche Tools

Was ist vui?

VUI ist ein innovatives Tool, das sich auf konversationale Sprachmodelle konzentriert, die direkt auf Geräten eingesetzt werden können. Es bietet eine effiziente und benutzerfreundliche Lösung für sprachbezogene Aufgaben. Die primären Modelle im VUI-Toolkit sind auf umfangreichen Datensätzen trainiert, wodurch sie in der Lage sind, Audio effektiv zu verarbeiten und kontextuell relevante Antworten zu erzeugen.

Aktualisierte Hauptmerkmale:

- Multiple Modelle: Vui bietet eine Vielzahl von Modellen, darunter Vui.BASE, Vui.ABRAHAM und Vui.COHOST, die jeweils für verschiedene Arten von konversationalen Interaktionen optimiert sind. Vui.BASE wurde speziell auf 40.000 Stunden Audio-Konversationen trainiert und bietet eine robuste Grundlage für verschiedene Anwendungen.

- Sprachklonen: Benutzer können die Modelle für Sprachklon-Funktionen nutzen, die es ihnen ermöglichen, Stimmen mit angemessener Genauigkeit basierend auf den vortrainierten Datensätzen zu replizieren. Die Fähigkeit, Stimmen zu klonen, ist verbessert, es wird jedoch angemerkt, dass die Ergebnisse aufgrund von Einschränkungen in den Trainingsdaten möglicherweise nicht perfekt sind.

- Effizienz: Die Modelle sind so konzipiert, dass sie auf Geräten ohne umfangreiche Cloud-Ressourcen effektiv funktionieren, was sie ideal für Anwendungen macht, die eine niedrige Latenz und hohe Reaktionsgeschwindigkeit erfordern. Die VUI-Modelle nutzen einen auf Llama basierenden Transformer, der Audio-Token vorhersagt und Fortschritte in der Modellarchitektur zeigt, die ihre Betriebseffizienz verbessern.

- Audio-Tokenisierung: Ein wesentliches Merkmal ist der fluac Audio-Tokenizer, der effektiv die Anzahl der Codes pro Sekunde reduziert und die Gesamtverarbeitungsgeschwindigkeit von 83,1 Hz auf 21,53 Hz erhöht.

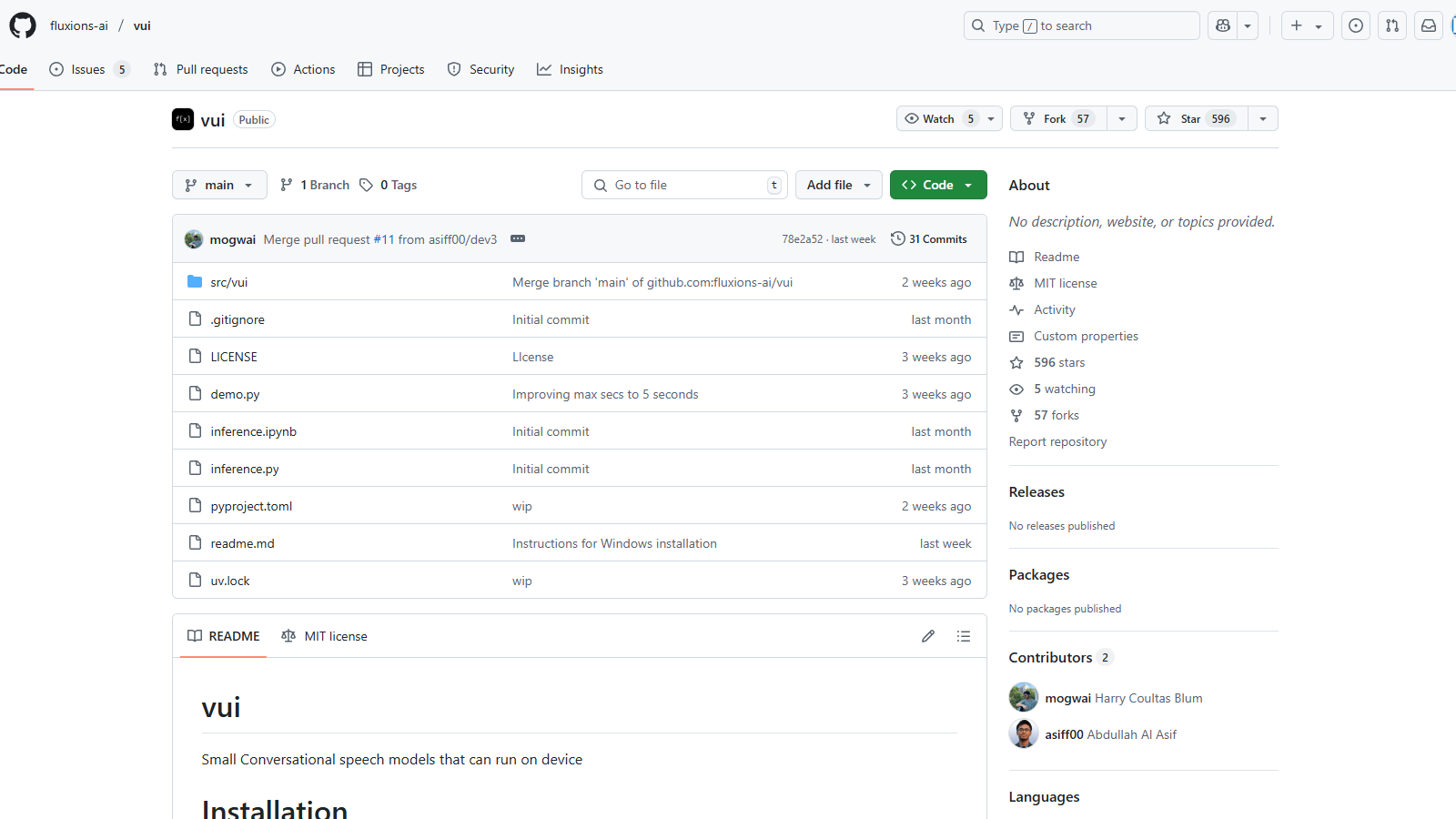

Installation und Nutzung:

Um VUI zu verwenden, können Benutzer es einfach über einen Paketmanager mit dem Befehl pip install -e . installieren. Der Installationsprozess ist unkompliziert, und eine Demo kann mit python demo.py ausgeführt werden. Diese Flexibilität ermöglicht es Entwicklern, die Modelle in verschiedenen Anwendungen zu implementieren und die Benutzererfahrungen durch nahtlose Spracherkennung und -erzeugungsfunktionen zu verbessern.

Herausforderungen und Überlegungen:

Obwohl die Modelle beeindruckende Fähigkeiten zeigen, sind sie nicht ohne Einschränkungen. Benutzer können einige Eigenheiten erleben, wie gelegentliche Halluzinationen, die auftreten, wenn die KI Antworten generiert, die nicht auf ihren Trainingsdaten basieren. Dieses Phänomen wird vom Entwicklungsteam anerkannt, während sie sich um kontinuierliche Verbesserung und Community-Engagement bemühen.

Trotz dieser Herausforderungen stellen die VUI-Modelle einen erheblichen Fortschritt in der konversationalen KI dar, insbesondere für Projekte, die darauf abzielen, die Interaktivität durch Stimme zu verbessern. Das Entwicklungsteam betont kontinuierliche Verbesserungen, teilt Erkenntnisse und geht auf Probleme basierend auf dem Feedback der Community ein. Dieses Engagement für die Entwicklung wird durch den Einsatz modernster Technologien und durch Zusammenarbeit mit anderen Open-Source-Projekten unterstützt.

Anerkennungen:

Die Entwicklung von VUI erkennt die Beiträge mehrerer Open-Source-Projekte an, darunter Whisper von OpenAI und Audiocraft von Facebook Research, was ein gemeinschaftliches Bemühen zeigt, robuste Werkzeuge zur Sprachverarbeitung zu schaffen. Durch diese Zusammenarbeiten verbessert VUI seine Angebote und bleibt relevant im schnelllebigen Bereich der Audioverarbeitungstechnologie.

Vorteile & Nachteile

Vorteile

- Bietet kleine Gesprächs-Sprachmodelle, die direkt auf dem Gerät ohne Cloud-Unterstützung betrieben werden können.

- Beinhaltet kontextbewusste Modelle für einen einzelnen Sprecher und zwei Sprecher für vielseitige Anwendungen.

- Verwendet einen auf Lama basierenden Transformer zur Audiotoken-Vorhersage und verbessert die Leistung.

Nachteile

- Die Sprachsynthese ist nicht perfekt aufgrund begrenzter Trainingsdaten und Ressourcen.

Häufig gestellte Fragen

vui ist Open Source und kostenlos zu nutzen.

Laut unseren neuesten Informationen scheint dieses Tool derzeit leider kein lebenslanges Angebot zu haben.

{toolName} bietet drei Hauptmodelle an: Vui.BASE, das auf 40.000 Stunden Audio-Gesprächen trainiert wurde; Vui.ABRAHAM, das als Modell für einen einzelnen Sprecher konzipiert ist und kontextbewusste Antworten geben kann, und Vui.COHOST, das die Kommunikation zwischen zwei Sprechern ermöglicht. Diese Modelle bedienen verschiedene Anwendungsfälle, die von grundlegenden Interaktionen bis hin zu komplexen Dialogen zwischen mehreren Parteien reichen.

Ja, du kannst {toolName} lokal ausführen. Um es zu installieren, verwende den pip-Befehl mit folgender Syntax: 'pip install -e .' Dies installiert das Tool im Editiermodus. Stelle sicher, dass Python auf deinem Gerät installiert ist, um die Einrichtung durchzuführen. Folge der README-Dokumentation im Repository für detaillierte Schritte und Anforderungen.

Obwohl {toolName} Funktionen zur Stimmklonung bietet, ist es wichtig zu beachten, dass das Basismodell möglicherweise keine perfekten Ergebnisse liefert, da der Trainingsdatensatz begrenzt ist. Das Modell hat keine umfangreichen Audioeingaben erhalten, was zu Inkonsistenzen beim Klonen bestimmter Stimmen führen kann. Benutzer sollten ihre Erwartungen entsprechend anpassen und diesen Aspekt bei der Verwendung der Stimmklonungsfunktion berücksichtigen.

{toolName} nutzt eine robuste Audio-Tokenisierungstechnik, die in Zusammenarbeit mit Fluac entwickelt wurde und auf dem Descript-Audio-Codec basiert. Dies reduziert die Anzahl der verarbeiteten Audiocodes erheblich, von 83,1 Hz auf 21,53 Hz, was eine effizientere Datenverarbeitung während der Audioverarbeitung ermöglicht. Diese Verbesserung führt zu schnelleren und genaueren Sprachvorhersagen.

Für eine optimale Leistung sollte {toolName} am besten auf Hochleistungshardware ausgeführt werden, insbesondere auf Systemen, die mit NVIDIA 4090 GPUs ausgestattet sind, wie von den Entwicklern angegeben. Der Einsatz solch leistungsstarker Hardware verkürzt die Verarbeitungszeit und verbessert die Fähigkeit des Modells, intensive Audiooperationen zu bewältigen.

Ja, {toolName} hat Halluzinationen, bei denen die Ausgabe möglicherweise nicht mit der Realität übereinstimmt. Dies ist eine häufige Herausforderung in der Leistung von KI-Modellen, insbesondere bei der Schulung mit begrenzten Ressourcen. Benutzer sollten sich dessen bewusst sein und die Genauigkeit kritischer Ausgaben überprüfen.

{toolName} mit anderen Tools wie Whisper und Audiocraft zu integrieren, kann seine Möglichkeiten erweitern. Whisper hilft bei einer robusten Spracherkennung, während Audiocraft die Audioverarbeitungsfunktionen verbessern kann. Die Erkundung dieser Partnerschaften kann das Benutzererlebnis und die Funktionalität von {toolName} erheblich steigern.

{toolName} wird auf GitHub gehostet, wo Nutzer durch Issues und Diskussionen Community-Unterstützung finden können. Für detaillierte Nutzungshinweise sollten die Nutzer die README-Dokumentation im Repository konsultieren. Die Teilnahme an der Community kann auch wertvolle Tipps zur Fehlersuche und Einblicke von anderen Nutzern liefern.