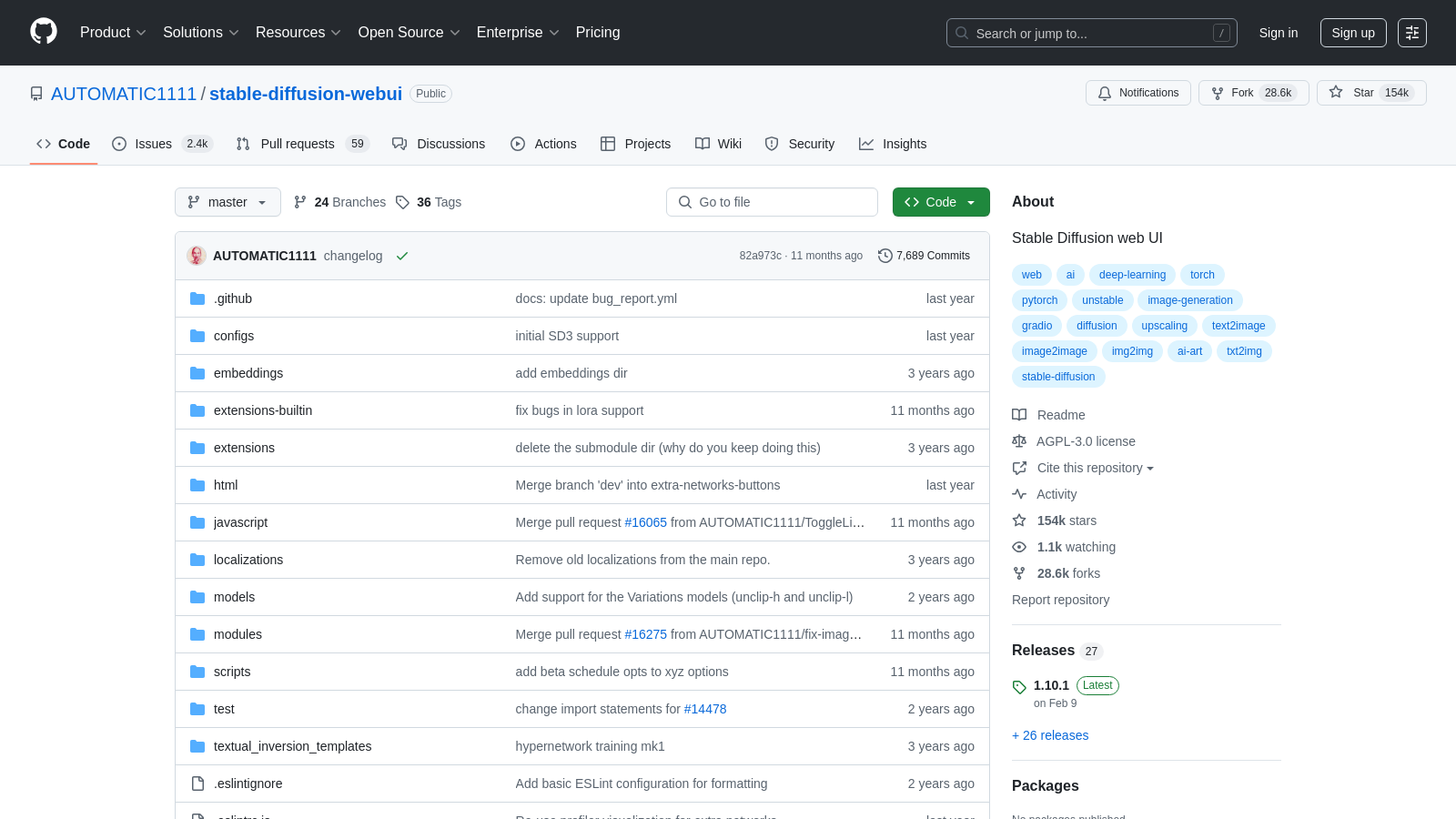

Automatic1111 - Stable Diffusion web UI

Interfaz web interactiva para generar imágenes con Stable Diffusion utilizando el marco Gradio.

Github.comSigue para actualizaciones y ofertas

Recibe alertas sobre descuentos, lanzamientos de funciones y cambios de precios de Automatic1111 - Stable Diffusion web UI

Herramientas Similares

¿Qué es Automatic1111 - Stable Diffusion web UI?

Stable Diffusion Web UI ofrece una interfaz de navegador integral para Stable Diffusion basada en la biblioteca Gradio. Esta intuitiva plataforma sirve como puente, proporcionando una interfaz interactiva para una tecnología normalmente reservada para aquellos con experiencia técnica avanzada. Su diseño fácil de usar garantiza que incluso aquellos que no están profundamente versados en tecnología AI puedan aprovechar al máximo las capacidades de Stable Diffusion.

La herramienta cuenta con una gran cantidad de características que mejoran la experiencia del usuario y proporcionan versatilidad a sus usuarios. Admite tanto los modos de texto a imagen como de imagen a imagen, y una instalación con un solo clic hace que el proceso de configuración sea muy fácil, aunque las instalaciones de Python y Git son requisitos previos. Para aquellos que se sumergen más en la manipulación de imágenes, características como outpainting, inpainting y color sketch son increíblemente útiles. El mecanismo de atención permite a los usuarios especificar partes del texto en las que el modelo debe enfocarse, lo que hace que la salida sea más precisa. Es importante destacar que una innovadora función de Loopback permite el procesamiento repetido de img2img, mientras que el gráfico X/Y/Z proporciona una forma única de visualizar imágenes con parámetros variables. Además, la plataforma admite varios mejoradores de neural network como GFPGAN, RealESRGAN, ESRGAN, SwinIR y Swin2SR. La flexibilidad está a la vanguardia con opciones para interrumpir el procesamiento, admite diversas capacidades de tarjetas de video y parámetros de generación ajustables.

El diseño intuitivo de Stable Diffusion Web UI se extiende a los elementos de su interfaz de usuario. Una práctica pestaña de extras incluye herramientas como CodeFormer, una herramienta para la restauración de rostros, y LDSR para la mejora de resolución superlativa latente. La página de configuración no solo es integral, sino centrada en el usuario, ofreciendo sugerencias al pasar el mouse por los elementos de la interfaz de usuario y flexibilidad para ajustar los valores predeterminados. Funciones como la vista previa de generación de imágenes en tiempo real, la barra de progreso y la capacidad de reorganizar los elementos en la interfaz de usuario hacen que la experiencia del usuario sea perfecta. Una característica destacada es el soporte de tiling, que permite a los usuarios crear imágenes con texturas, asegurando la versatilidad en los resultados de diseño.

Para aquellos que buscan una guía de instalación, la plataforma ofrece instrucciones detalladas para varios sistemas, desde Windows 10/11 hasta Linux e incluso Apple Silicon. También hay opciones de servicios en línea, como Google Colab, que ofrecen flexibilidad según las preferencias del usuario. Además, se fomentan las contribuciones de la comunidad y una sección dedicada a la documentación garantiza que los usuarios tengan todos los recursos que necesitan. La página de "Características" ofrece una visión en profundidad de las capacidades de la interfaz de usuario de Stable Diffusion, mientras que las secciones dedicadas a las descargas y los modelos guían a los usuarios sobre cómo aprovechar al máximo la tecnología de manera óptima. La integración de herramientas avanzadas como Hypernetworks, LoRA, Alt-Diffusion y el Inpainting Model SD2 subraya el compromiso de la plataforma de estar a la vanguardia de la tecnología de manipulación de imágenes impulsada por AI.

En conclusión, Stable Diffusion Web UI es una plataforma de vanguardia que logra cerrar la brecha entre la compleja tecnología de AI y los usuarios cotidianos. Su exhaustiva lista de características, combinada con un diseño intuitivo, la posiciona como una herramienta esencial para cualquier persona que desee explorar las vastas posibilidades de la manipulación de imágenes impulsada por AI.

Pros y Contras

Pros

- Ofrece una amplia gama de características para la generación de imágenes, incluyendo outpainting e inpainting.

- Soporta scripts personalizados y extensiones de la comunidad para una funcionalidad mejorada.

- Permite ediciones interactivas de los prompts durante la generación de imágenes para mayor flexibilidad.

Contras

- Requiere una instalación adecuada de Python y Git, lo que puede desanimar a los principiantes.

Preguntas frecuentes

Automatic1111 - Stable Diffusion web UI está disponible sin costo.

Esta herramienta ofrece un acuerdo de por vida.

{toolName} admite varias integraciones y extensiones para mejorar las capacidades de generación de imágenes. Esto incluye herramientas como GFPGAN para la restauración de rostros, CodeFormer como una alternativa, RealESRGAN para escalado, y opciones adicionales de redes neuronales, incluyendo SwinIR y LDSP. La API también permite el uso de modelos de inpainting dedicados a través de extensiones, lo que la hace flexible para diversos casos de uso.

{toolName} ha sido reportado como compatible con tarjetas de video de 4 GB y, en algunos casos, incluso con tarjetas de 2 GB. Incluye características como la validación en vivo de la longitud del token del prompt y soporta ajustes avanzados de ruido, lo que ayuda a optimizar el rendimiento en hardware de gama baja. Los usuarios deben asegurarse de cumplir con las dependencias requeridas, especialmente si están utilizando sistemas con procesadores gráficos de NVIDIA, AMD o Intel.

{toolName} permite a los usuarios personalizar los prompts con opciones como la inversión textual, la especificación de atención y el prompting negativo. Puedes ajustar partes del texto para influir en los elementos de la imagen generada y utilizar embeddings o Loras únicos para experimentar con diferentes estilos. Además, la función de composición de difusión (composable-diffusion) permite el uso de múltiples prompts con pesos especificados.

Para instalar {toolName} en Windows, primero asegúrate de tener Python 3.10.6 instalado (ten en cuenta que las versiones más recientes pueden no ser compatibles). Luego, instala Git. Descarga el repositorio stable-diffusion-webui usando el comando `git clone https://github.com/AUTOMATIC1111/stable-diffusion-webui.git`. Por último, ejecuta el archivo `webui-user.bat` desde el Explorador de Windows como un usuario normal para iniciar la interfaz.

Sí, usar la extensión xformers puede acelerar significativamente la generación de imágenes en tarjetas gráficas compatibles. Además, aprovechar las optimizaciones de GPU y el procesamiento por lotes puede agilizar el flujo de trabajo. Se recomienda ajustar los valores ETA del muestreador y experimentar con diferentes métodos de muestreo para reducir los tiempos de procesamiento.

Para solucionar errores en {toolName}, los usuarios pueden comenzar revisando la página de problemas de GitHub para ver informes similares y posibles soluciones. Además, explorar las discusiones de la comunidad o los foros relacionados con la herramienta puede proporcionar información útil. Si el problema persiste, considera enviar un informe de errores con información detallada al repositorio de GitHub del proyecto.

¡Absolutamente! {toolName} admite múltiples prompts a través del método de difusión compuesta (composable-diffusion). Puedes combinar fácilmente diferentes prompts utilizando 'AND' en mayúsculas para generar una variedad diversa de imágenes. La herramienta también te permite especificar pesos para cada prompt, dándote un control más preciso sobre la influencia de cada componente en la salida final.

{toolName} ofrece varias funciones de ajuste de imagen, incluyendo outpainting, inpainting y redimensionamiento. Puedes utilizar opciones para correcciones de alta resolución y elegir entre múltiples técnicas de aumento, como ESRGAN y RealESRGAN. La aplicación también incluye configuraciones avanzadas para la gestión de ruido y la capacidad de restaurar parámetros de imagen para realizar modificaciones fácilmente.