Thinkless

Marco para LLMs que optimiza el razonamiento eligiendo la complejidad de la respuesta según las demandas de la tarea.

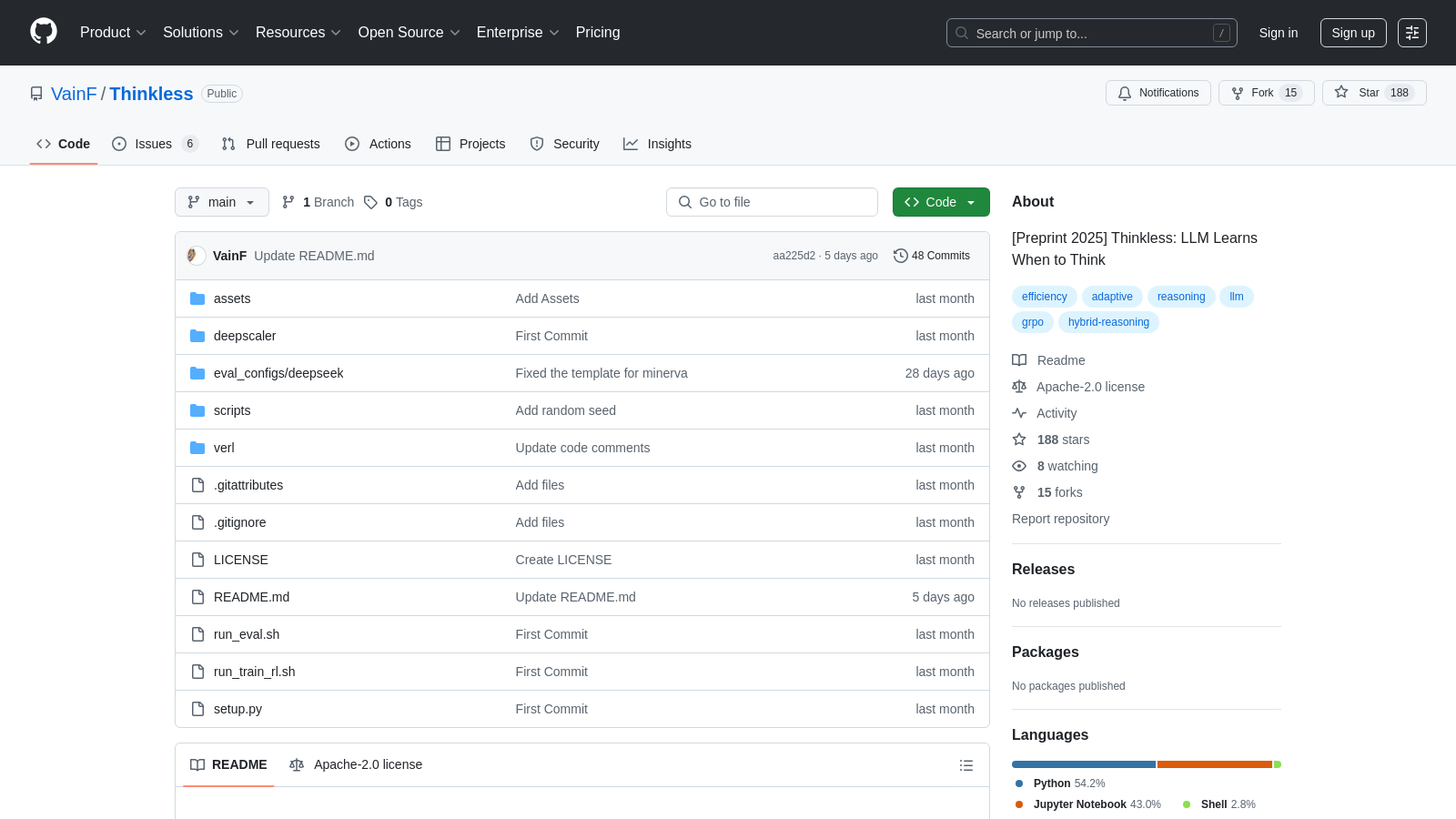

Github.comSigue para actualizaciones y ofertas

Recibe alertas sobre descuentos, lanzamientos de funciones y cambios de precios de Thinkless

Herramientas Similares

¿Qué es Thinkless?

Thinkless es un marco innovador diseñado para que los modelos de lenguaje de gran tamaño (LLMs) aprendan cuándo pensar críticamente antes de generar respuestas. Al utilizar un paradigma de entrenamiento único basado en el aprendizaje por refuerzo, Thinkless tiene como objetivo optimizar el razonamiento en los modelos de lenguaje de gran tamaño (LLMs), permitiéndoles elegir entre respuestas cortas y de formato largo en función de la complejidad de las tareas. Recientemente, se han realizado mejoras significativas en el marco, consolidando su posición como una solución líder para el razonamiento adaptativo en LLMs.

La innovación central de Thinkless radica en su uso sofisticado del algoritmo Decoupled Group Relative Policy Optimization (DeGRPO). Este enfoque avanzado separa estratégicamente los objetivos de aprendizaje en dos componentes distintos: uno supervisa la elección del modo de razonamiento a través de una pérdida de token de control, mientras que el otro mejora la precisión de las respuestas generadas a través de la pérdida de respuesta. Esta meticulosa separación no solo estabiliza el proceso de entrenamiento, sino que también minimiza la carga computacional asociada con el razonamiento de LLM, facilitando operaciones más eficientes. Además, se han realizado mejoras en el algoritmo para aumentar su capacidad de estabilizar el entrenamiento y prevenir el colapso de rendimiento que a menudo se observa en implementaciones ingenuas de métodos similares.

Cómo Funciona

El corazón del marco Thinkless está compuesto por dos tokens de control clave:

Características Clave

- Razonamiento Adaptativo: Thinkless ajusta su generación de respuestas de acuerdo con la complejidad de la tarea y las capacidades del modelo, haciéndolo altamente versátil.

- Eficiencia Mejorada: El marco reduce significativamente la necesidad de rutas de razonamiento extensas, lo que se correlaciona con mejoras en el rendimiento en diversas pruebas de referencia, reduciendo los requisitos de pensamiento encadenado en un 50-90%.

- Enfoque de Aprendizaje por Refuerzo: Thinkless emplea un marco de aprendizaje por refuerzo que no solo fomenta una mejor comprensión de la complejidad de la tarea, sino que también predice cuándo es imperativo un razonamiento más profundo.

- Resultados Empíricos: Las últimas iteraciones del marco han demostrado resultados superiores en pruebas empíricas, validando aún más su enfoque innovador en el entrenamiento y razonamiento de LLM.

Instalación y Uso

Configurar Thinkless es sencillo y se puede ejecutar directamente dentro de un entorno conda. El proceso de instalación abarca la configuración de dependencias de Python, la descarga de componentes de modelo relevantes desde el repositorio oficial y la utilización de un proceso simple de línea de comandos para iniciar el entrenamiento. Los usuarios son guiados a través de la configuración con documentación detallada encontrada dentro del repositorio, mejorando la experiencia de incorporación mientras se eliminan ambigüedades de configuración.

Conclusión

En resumen, Thinkless encarna una herramienta visionaria que redefine cómo los LLMs interactúan con tareas de razonamiento complejas, avanzando significativamente la eficiencia computacional y la precisión de las respuestas. Al aprovechar su diseño innovador y aplicaciones prácticas en escenarios del mundo real, Thinkless se afirma como un recurso crucial tanto para investigadores como para profesionales en el campo en rápida evolución de la inteligencia artificial. La participación en su desarrollo continuo asegura que no solo satisfaga las demandas actuales, sino que también se adapte a las necesidades futuras en el ámbito de los modelos de lenguaje de gran tamaño y el razonamiento avanzado.

Pros y Contras

Pros

- Emplea razonamiento adaptativo para mejorar la eficiencia en el rendimiento de tareas.

- Utiliza un modelo de aprendizaje por refuerzo único con tokens de control duales.

- Reduce significativamente el uso del razonamiento en cadena larga, mejorando la velocidad de cálculo.

Preguntas frecuentes

Thinkless es de código abierto y gratis de usar.

Según nuestra última información, esta herramienta no parece tener un acuerdo de por vida en este momento, lamentablemente.

El algoritmo DeGRPO está en el núcleo del marco de trabajo de Thinkless. Descompone el objetivo de aprendizaje del razonamiento híbrido en dos componentes separados: una pérdida de token de control y una pérdida de respuesta. Esta separación permite un control detallado sobre las contribuciones de cada objetivo durante el entrenamiento. La pérdida de token de control determina cómo el modelo elige entre el razonamiento de formato corto y largo, mientras que la pérdida de respuesta mejora la precisión de las respuestas generadas. Al estabilizar el entrenamiento y prevenir colapsos, DeGRPO mejora significativamente el rendimiento en varios puntos de referencia de razonamiento.

Thinkless mejora la eficiencia computacional al permitir que los modelos de lenguaje seleccionen de manera adaptativa entre razonamiento de forma corta y de forma larga, dependiendo de la complejidad de la tarea y las capacidades del modelo. Al reducir la necesidad de pensamiento en cadenas largas entre un 50% y un 90%, Thinkless minimiza el consumo de recursos durante la inferencia, mientras mantiene o incluso mejora la precisión de los resultados. Esto lo hace más eficiente que los enfoques de razonamiento tradicionales en grandes modelos de lenguaje.

Para instalar Thinkless, necesitas crear un entorno con Python 3.10 y las dependencias necesarias. Específicamente, utiliza Conda para crear un nuevo entorno e instalar paquetes como PyTorch, LM_eval y Ray. Para soporte de CUDA, asegúrate de instalar la versión correspondiente de NVIDIA CUDA. Se proporcionan comandos de instalación detallados en el README del proyecto en GitHub. Asegúrate de consultar la documentación para cualquier requisito adicional basado en la configuración de tu sistema.

Sí, Thinkless está diseñado para integrarse con marcos de aprendizaje automático populares, como PyTorch, como se indica con la instalación del paquete torch como una dependencia. Dado que está construido utilizando herramientas estándar, los usuarios pueden conectarlo con otras bibliotecas y marcos para tareas como el procesamiento de datos y el entrenamiento adicional de modelos. Los usuarios pueden consultar las instrucciones de instalación y uso en el repositorio de GitHub para obtener una mejor comprensión de la integración.

Para comenzar rápidamente con Thinkless, primero necesitarás configurar tu entorno de programación con la versión de Python y las bibliotecas requeridas. Después de activar tu entorno de Conda, puedes importar AutoModelForCausalLM y AutoTokenizer de la biblioteca transformers. A partir de ahí, carga el modelo Thinkless y prepara tus textos de entrada para el razonamiento. La documentación del proyecto incluye fragmentos de código de ejemplo para guiarte en la generación de respuestas y en la evaluación efectiva de las salidas del modelo.

Puedes evaluar el rendimiento del modelo Thinkless utilizando los scripts de evaluación proporcionados en el repositorio, que te permiten ejecutar múltiples repeticiones de inferencia. Esto ayudará a reunir resultados para diferentes tareas y métricas. La herramienta de evaluación se basa en prompts en OpenAI/simple-evals, y puedes ejecutar comandos de evaluación para generar métricas a partir de los resultados guardados en calcs, como la precisión y la calidad de las respuestas, lo que ayuda a comprender las capacidades del modelo.

Si bien Thinkless mejora significativamente la eficiencia en las tareas de razonamiento, las limitaciones potenciales incluyen una dependencia de la calidad del modelo inicial y de la calidad de los datos de entrenamiento. El algoritmo también puede no funcionar de manera óptima en tareas de razonamiento específicas y altamente complejas que requieren una comprensión profunda del contexto. Además, ajustar hiperparámetros como thinkless_alpha y correct_think_reward puede requerir experimentación para lograr los mejores resultados, lo que puede ser un proceso que consume tiempo.

Para ajustar Thinkless, podrías empezar ajustando los hiperparámetros, como thinkless_alpha y correct_think_reward. Si la convergencia es lenta o si el modelo se sesga hacia un modo de razonamiento particular, considera aumentar gradualmente estos parámetros para mejorar el rendimiento. Experimentar con diferentes conjuntos de datos de entrenamiento y técnicas descritas en la documentación del proyecto también puede ayudar a optimizar el rendimiento según tu caso de uso específico.