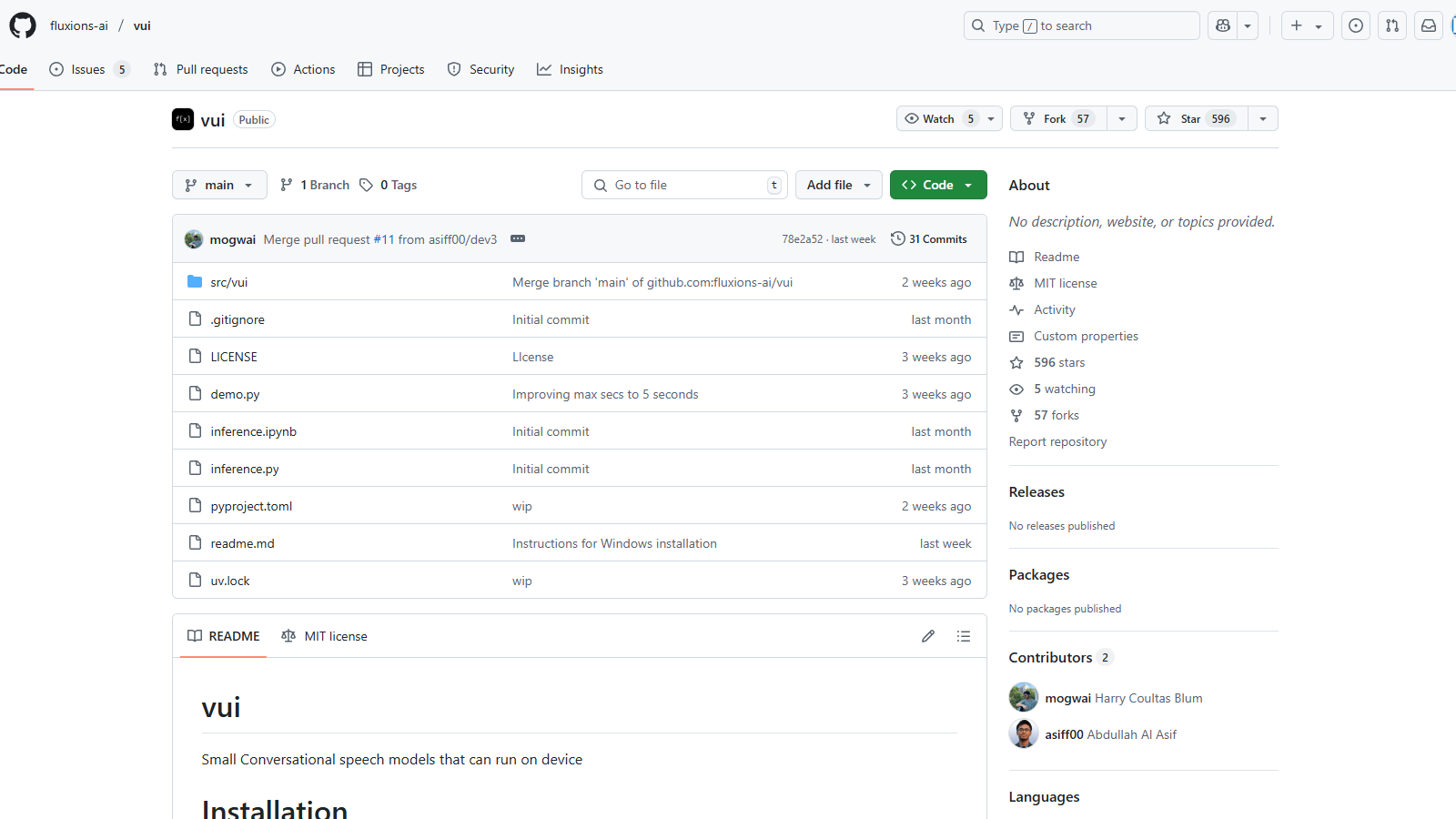

vui

Modelos de voz conversacional que funcionan en el dispositivo.

Github.comSigue para actualizaciones y ofertas

Recibe alertas sobre descuentos, lanzamientos de funciones y cambios de precios de vui

Herramientas Similares

¿Qué es vui?

VUI es una herramienta innovadora centrada en modelos de habla conversacional diseñados para operar directamente en dispositivos, proporcionando una solución eficiente y fácil de usar para tareas relacionadas con el habla. Los modelos principales disponibles en el kit de herramientas VUI están entrenados en conjuntos de datos extensos, lo que les permite procesar audio de manera efectiva y producir respuestas contextualmente relevantes.

Características Clave Actualizadas:

- Múltiples Modelos: Vui ofrece una variedad de modelos, incluidos Vui.BASE, Vui.ABRAHAM y Vui.COHOST, cada uno optimizado para diferentes tipos de interacciones conversacionales. Vui.BASE ha sido entrenado específicamente en 40,000 horas de conversaciones de audio, proporcionando una base sólida para varias aplicaciones.

- Clonación de Voz: Los usuarios pueden aprovechar los modelos para capacidades de clonación de voz, lo que les permite replicar voces con una precisión razonable basada en los conjuntos de datos preentrenados. La capacidad de clonar voces se ha mejorado, pero se señala que los resultados pueden no ser perfectos debido a limitaciones en los datos de entrenamiento.

- Eficiencia: Los modelos están diseñados para funcionar de manera efectiva en dispositivos sin necesitar amplios recursos en la nube, lo que los hace ideales para aplicaciones que requieren baja latencia y alta capacidad de respuesta. Los modelos VUI utilizan un transformador basado en llama que predice tokens de audio, mostrando avances en la arquitectura del modelo que mejoran su eficiencia operativa.

- Tokenización de Audio: Una característica significativa es el tokenizador de audio fluac, que reduce efectivamente el número de códigos por segundo, mejorando la velocidad de procesamiento general de 83.1hz a 21.53hz.

Instalación y Uso:

Para comenzar a usar VUI, los usuarios pueden instalarlo fácilmente a través de un administrador de paquetes utilizando el comando pip install -e .. El proceso de instalación es sencillo y se puede ejecutar una demostración ejecutando python demo.py. Esta flexibilidad permite a los desarrolladores implementar los modelos en varias aplicaciones, mejorando las experiencias del usuario con funcionalidades de reconocimiento y generación de voz sin interrupciones.

Desafíos y Consideraciones:

Si bien los modelos muestran capacidades impresionantes, no están exentos de limitaciones. Los usuarios pueden experimentar algunas peculiaridades, como alucinaciones ocasionales, que ocurren cuando la IA genera respuestas que no se basan en sus datos de entrenamiento. Esta realidad es reconocida por el equipo de desarrollo mientras se esfuerzan por la mejora continua y el compromiso con la comunidad.

A pesar de estos desafíos, los modelos VUI representan un avance significativo en la IA conversacional, particularmente para proyectos que buscan mejorar la interactividad a través de la voz. El equipo de desarrollo enfatiza la mejora continua, compartiendo conocimientos y abordando problemas basados en la retroalimentación de la comunidad. Este compromiso con el desarrollo está respaldado por el uso de tecnologías de vanguardia y esfuerzos colaborativos con otros proyectos de código abierto.

Atribuciones:

El desarrollo de VUI reconoce las contribuciones de varios proyectos de código abierto, incluidos Whisper de OpenAI y Audiocraft de Facebook Research, mostrando un esfuerzo comunitario hacia la construcción de herramientas robustas para el procesamiento del habla. A través de estas colaboraciones, VUI mejora sus ofertas y mantiene relevancia en el área de tecnología de procesamiento de audio en rápida evolución.

Pros y Contras

Pros

- Ofrece pequeños modelos de habla conversacional que pueden ejecutarse en el dispositivo sin necesidad de soporte en la nube.

- Incluye modelos de un solo hablante y de dos hablantes con conciencia del contexto para aplicaciones versátiles.

- Utiliza un transformador basado en llama para la predicción de tokens de audio, mejorando el rendimiento.

Contras

- La clonación de voz no es perfecta debido a los datos de entrenamiento y recursos limitados.

Preguntas frecuentes

vui es de código abierto y gratis de usar.

Según nuestra última información, esta herramienta no parece tener un acuerdo de por vida en este momento, lamentablemente.

{toolName} ofrece tres modelos principales: Vui.BASE, que es el modelo base entrenado con 40,000 horas de conversaciones de audio; Vui.ABRAHAM, diseñado como un modelo de un solo hablante capaz de respuestas contextualmente relevantes, y Vui.COHOST, que permite la comunicación entre dos hablantes. Estos modelos sirven para diversos casos de uso, que van desde interacciones conversacionales fundamentales hasta diálogos complejos entre múltiples partes.

Sí, puedes ejecutar {toolName} localmente. Para instalarlo, utiliza el comando pip con la siguiente sintaxis: 'pip install -e .' Esto instalará la herramienta en modo editable. Asegúrate de tener Python instalado en tu dispositivo para la configuración. Consulta la documentación README en el repositorio para obtener pasos y requisitos detallados.

Aunque {toolName} ofrece capacidades de clonación de voz, es importante tener en cuenta que el modelo base puede no producir resultados perfectos debido a un conjunto de datos de entrenamiento limitado. El modelo no ha recibido entradas de audio extensas, lo que resulta en inconsistencias al clonar voces específicas. Los usuarios deben gestionar sus expectativas y considerar este aspecto al utilizar la función de clonación de voz.

{toolName} utiliza una técnica de tokenización de audio robusta, desarrollada en colaboración con Fluac, que se basa en el Descript-Audio-Codec. Esto reduce significativamente el número de códigos de audio procesados, disminuyendo de 83.1 Hz a 21.53 Hz, lo que permite un manejo de datos más eficiente durante el procesamiento de audio. Esta mejora permite realizar predicciones de voz más rápidas y precisas.

Para un rendimiento óptimo, {toolName} se ejecuta mejor en hardware de alto rendimiento, específicamente en configuraciones equipadas con GPUs NVIDIA 4090, según indica su desarrollador. El uso de este tipo de hardware potente reduce el tiempo de procesamiento y mejora la capacidad del modelo para manejar operaciones de audio intensivas.

Sí, {toolName} experimenta alucinaciones, donde la salida puede no alinearse con la realidad. Este es un desafío común en el rendimiento de los modelos de IA, particularmente cuando se entrena con recursos limitados. Los usuarios deben estar al tanto de esto y verificar la precisión de las salidas críticas.

Integrar {toolName} con otras herramientas, como Whisper y Audiocraft, puede expandir sus capacidades. Whisper ayuda en el reconocimiento de voz robusto, mientras que Audiocraft puede mejorar las funciones de procesamiento de audio. Explorar estas asociaciones puede elevar significativamente la experiencia del usuario y la funcionalidad de {toolName}.

{toolName} se aloja en GitHub, donde los usuarios pueden encontrar soporte comunitario a través de problemas y discusiones. Para obtener una guía detallada de uso, los usuarios deben consultar la documentación README proporcionada en el repositorio. Participar en la comunidad también puede ofrecer valiosos consejos de solución de problemas y perspectivas de otros usuarios.