Thinkless

Cadre pour les LLMs afin d'optimiser le raisonnement en choisissant la complexité de la réponse en fonction des exigences de la tâche.

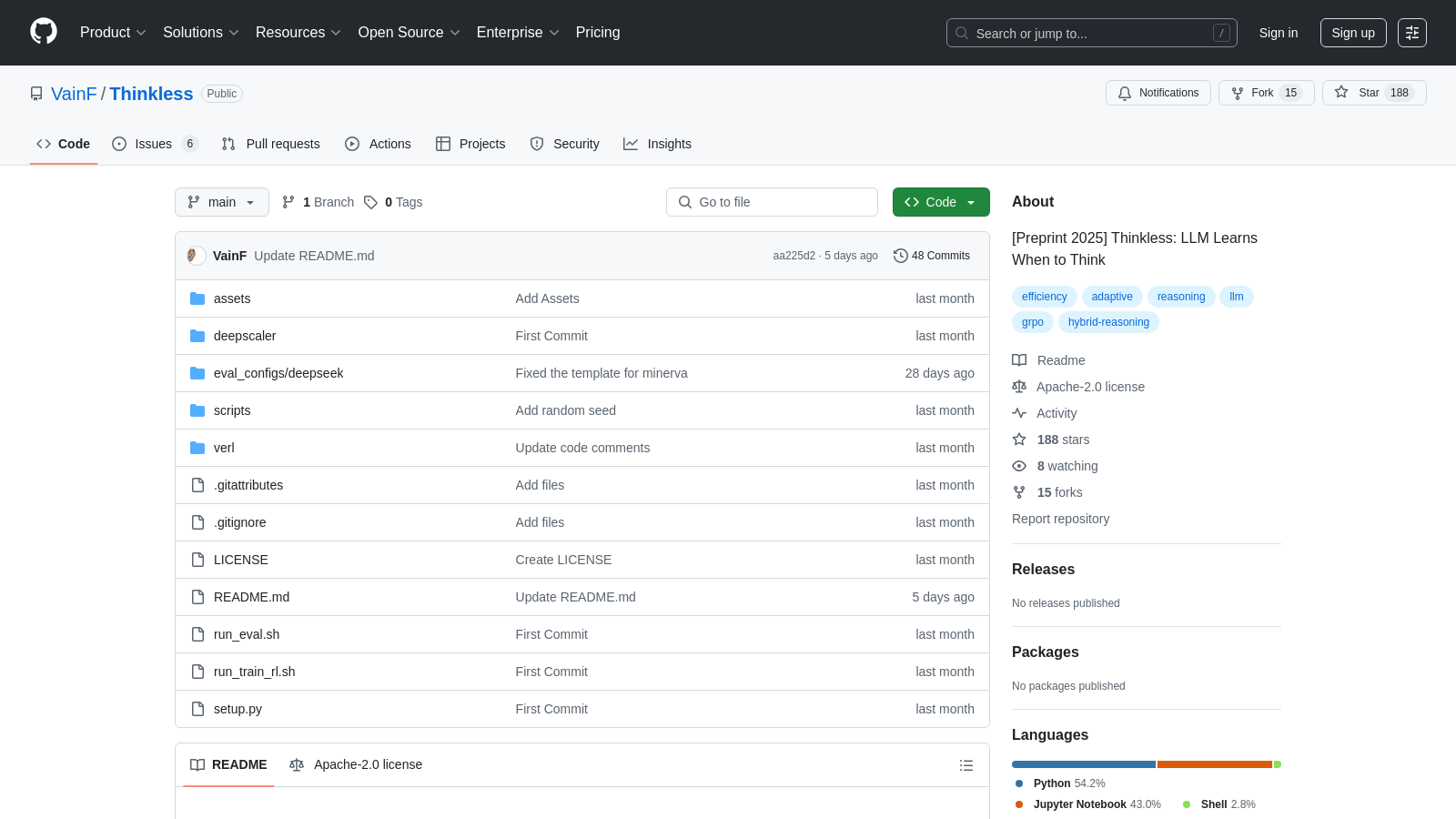

Github.comSuivez pour des mises à jour et des offres

Recevez des alertes pour les réductions, les nouvelles fonctionnalités et les changements de prix de Thinkless

Outils Similaires

Qu'est-ce que Thinkless ?

Thinkless est un cadre innovant conçu pour les modèles de langage de grande taille (LLMs) afin d'apprendre quand réfléchir de manière critique avant de générer des réponses. En utilisant un paradigme d'entraînement unique basé sur l'apprentissage par renforcement, Thinkless vise à optimiser le raisonnement dans les modèles de langage de grande taille (LLMs), leur permettant de choisir entre des réponses courtes et longues en fonction de la complexité des tâches. Récemment, des améliorations significatives ont été apportées au cadre, consolidant sa position en tant que solution de premier plan pour le raisonnement adaptatif dans les LLMs.

L'innovation centrale de Thinkless réside dans son utilisation sophistiquée de l'algorithme de Découplage de l'Optimisation des Politiques Relatives de Groupe (DeGRPO). Cette approche avancée sépare stratégiquement les objectifs d'apprentissage en deux composants distincts : l'un supervise le choix du mode de raisonnement par le biais d'une perte de token de contrôle, tandis que l'autre améliore l'exactitude des réponses générées via une perte de réponse. Cette séparation méticuleuse stabilise non seulement le processus d'entraînement mais minimise également la charge computationnelle associée au raisonnement LLM, facilitant des opérations plus efficaces. De plus, des améliorations ont été apportées à l'algorithme pour renforcer sa capacité à stabiliser l'entraînement et à prévenir l'effondrement des performances souvent observé dans les implémentations naïves de méthodes similaires.

Comment ça marche

Au cœur du cadre Thinkless se trouvent deux jetons de contrôle clés :

Caractéristiques clés

- Raisonnement adaptatif : Thinkless ajuste sa génération de réponses en fonction de la complexité de la tâche et des capacités du modèle, ce qui le rend très polyvalent.

- Efficacité améliorée : Le cadre réduit considérablement le besoin de chemins de raisonnement étendus, ce qui est corrélé avec des améliorations de performance dans divers tests de référence, réduisant les exigences de réflexion prolongée de 50 à 90 %.

- Approche d'apprentissage par renforcement : Thinkless utilise un cadre d'apprentissage par renforcement qui favorise non seulement une meilleure compréhension de la complexité des tâches mais qui prédit également quand un raisonnement plus approfondi est impératif.

- Résultats empiriques : Les dernières itérations du cadre ont démontré des résultats supérieurs dans des tests empiriques, validant encore son approche innovante de l'entraînement et du raisonnement des LLMs.

Installation et utilisation

La configuration de Thinkless est simple et peut être exécutée directement dans un environnement conda. Le processus d'installation comprend la mise en place des dépendances Python, le téléchargement des composants de modèle pertinents depuis le dépôt officiel, et l'utilisation d'un simple processus en ligne de commande pour initier l'entraînement. Les utilisateurs sont guidés à travers la configuration grâce à une documentation détaillée disponible dans le dépôt, améliorant l'expérience d'intégration tout en éliminant les ambiguïtés de configuration.

Conclusion

En résumé, Thinkless incarne un outil tourné vers l'avenir qui redéfinit la manière dont les LLMs interagissent avec des tâches de raisonnement complexes, faisant un progrès significatif en termes d'efficacité computationnelle et d'exactitude des réponses. En tirant parti de son design innovant et de ses applications pratiques dans des scénarios du monde réel, Thinkless représente une ressource cruciale tant pour les chercheurs que pour les praticiens dans le domaine en constante évolution de l'intelligence artificielle. L'engagement dans son développement continu garantit qu'il répond non seulement aux exigences actuelles mais s'adapte aussi aux besoins futurs dans le domaine des modèles de langage de grande taille et du raisonnement avancé.

Avantages & Inconvénients

Avantages

- Utilise un raisonnement adaptatif pour améliorer l'efficacité dans l'exécution des tâches.

- Utilise un modèle d'apprentissage par renforcement unique avec des jetons de contrôle doubles.

- Réduit considérablement l'utilisation du raisonnement en chaîne longue, améliorant ainsi la vitesse de calcul.

Questions fréquemment posées

Thinkless est open source et gratuit à utiliser.

Selon nos dernières informations, cet outil ne semble pas avoir d'offre à vie pour le moment, malheureusement.

L'algorithme DeGRPO est au cœur du cadre Thinkless. Il décompose l'objectif d'apprentissage du raisonnement hybride en deux composants distincts : une perte de jeton de contrôle et une perte de réponse. Cette séparation permet un contrôle précis sur les contributions de chaque objectif pendant l'entraînement. La perte de jeton de contrôle détermine comment le modèle choisit entre le raisonnement en format court et en format long, tandis que la perte de réponse améliore la précision des réponses générées. En stabilisant l'entraînement et en empêchant l'effondrement, DeGRPO améliore considérablement les performances sur divers benchmarks de raisonnement.

Thinkless améliore l'efficacité computationnelle en permettant aux modèles linguistiques de choisir de manière adaptative entre un raisonnement de courte durée et un raisonnement de longue durée, en fonction de la complexité de la tâche et des capacités du modèle. En réduisant la nécessité de raisonnement en chaîne longue de 50 % à 90 %, Thinkless minimise la consommation de ressources pendant l'inférence tout en maintenant, voire en améliorant, la précision des résultats. Cela le rend plus efficace que les approches de raisonnement traditionnelles dans les grands modèles linguistiques.

Pour installer Thinkless, vous devez créer un environnement avec Python 3.10 et les dépendances nécessaires. Plus précisément, utilisez Conda pour créer un nouvel environnement et installer des paquets tels que PyTorch, LM_eval et Ray. Pour le support CUDA, assurez-vous d'installer la version correspondante de NVIDIA CUDA. Des commandes d'installation détaillées sont fournies dans le README du projet sur GitHub. Veillez à consulter la documentation pour toute exigence supplémentaire en fonction de la configuration de votre système.

Oui, Thinkless est conçu pour s'intégrer avec des frameworks d'apprentissage automatique populaires, comme PyTorch, comme l'indique l'installation du paquet torch en tant que dépendance. Étant construit à l'aide d'outils standards, les utilisateurs peuvent l'interface avec d'autres bibliothèques et frameworks pour des tâches telles que le traitement des données et l'entraînement supplémentaire de modèles. Les utilisateurs peuvent consulter les instructions d'installation et d'utilisation dans le dépôt GitHub pour mieux comprendre l'intégration.

Pour commencer rapidement avec Thinkless, vous devez d'abord configurer votre environnement de programmation avec la version de Python requise et les bibliothèques nécessaires. Après avoir activé votre environnement Conda, vous pouvez importer AutoModelForCausalLM et AutoTokenizer depuis la bibliothèque transformers. Ensuite, chargez le modèle Thinkless et préparez vos invites d'entrée pour le raisonnement. La documentation du projet comprend des extraits de code d'exemple pour vous guider dans la génération de réponses et l'évaluation efficace des sorties du modèle.

Vous pouvez évaluer la performance du modèle Thinkless en utilisant les scripts d'évaluation fournis dans le dépôt, qui vous permettent d'effectuer plusieurs répétitions d'inférence. Cela vous aidera à rassembler des résultats pour différentes tâches et métriques. L'outil d'évaluation est basé sur des instructions dans OpenAI/simple-evals, et vous pouvez exécuter des commandes d'évaluation pour générer des métriques à partir des résultats enregistrés dans calcs, tels que la précision et la qualité des réponses, ce qui aide à comprendre les capacités du modèle.

Bien que Thinkless améliore considérablement l'efficacité dans les tâches de raisonnement, les limitations potentielles incluent une dépendance à la qualité du modèle initial et celle des données d'entraînement. L'algorithme peut également ne pas performer de manière optimale sur des tâches de raisonnement spécifiques et très complexes qui nécessitent une compréhension approfondie du contexte. De plus, l'ajustement des hyperparamètres tels que thinkless_alpha et correct_think_reward peut nécessiter des expérimentations pour obtenir les meilleurs résultats, ce qui peut prendre du temps.

Pour affiner Thinkless, vous pouvez commencer par ajuster les hyperparamètres, tels que thinkless_alpha et correct_think_reward. Si la convergence est lente ou si le modèle bias vers un mode de raisonnement particulier, envisagez d'augmenter progressivement ces paramètres pour améliorer les performances. Expérimenter avec différents jeux de données d'entraînement et techniques décrites dans la documentation du projet peut également aider à optimiser les performances en fonction de votre cas d'utilisation spécifique.