Thinkless

LLMs के लिए एक ढांचा जो कार्य की आवश्यकताओं के आधार पर प्रतिक्रिया की जटिलता को चुनकर तर्क को अनुकूलित करता है।

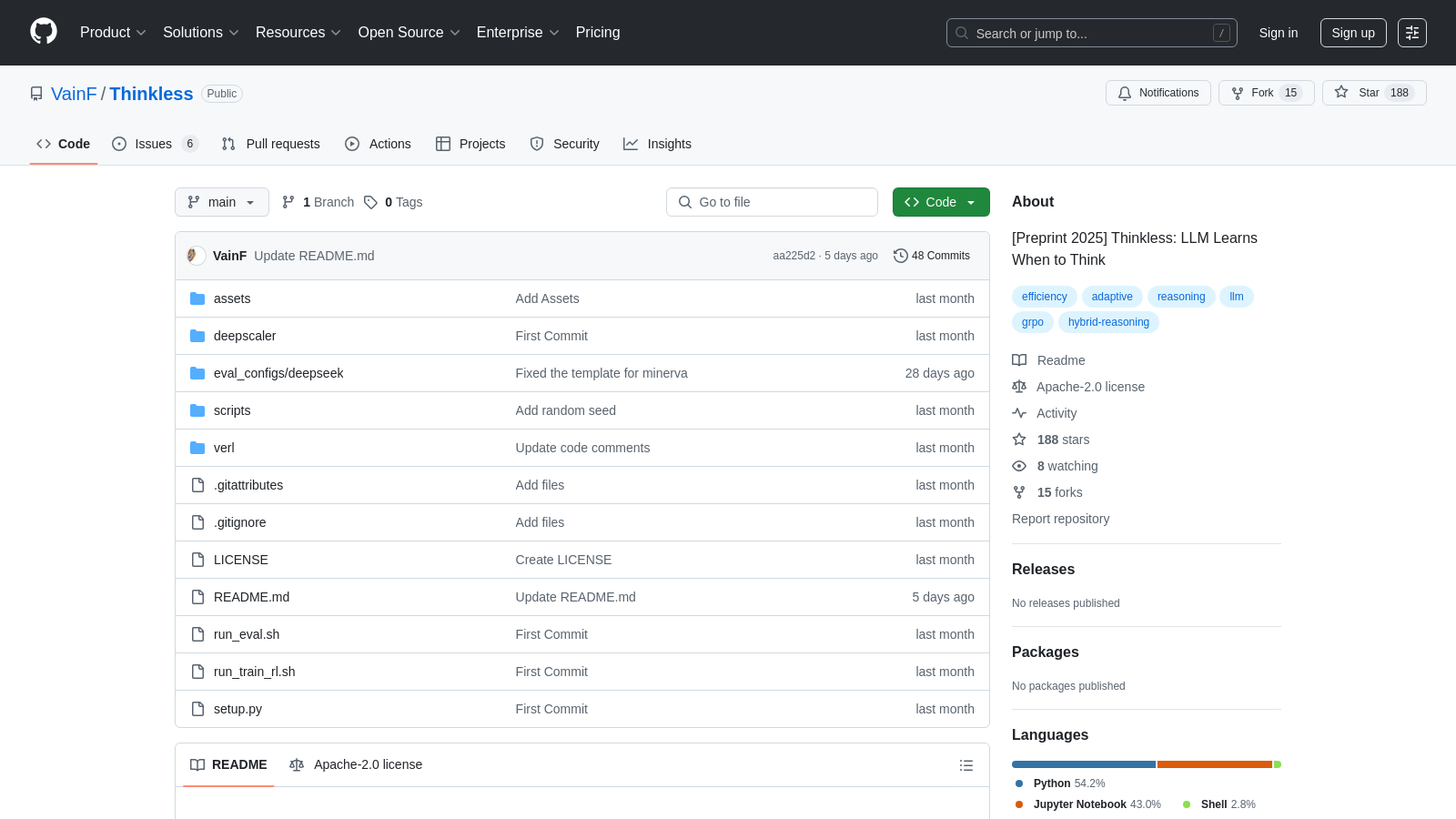

Github.comअपडेट और डील्स के लिए अनुसरण करें

Thinkless छूट, फीचर रिलीज़ और मूल्य परिवर्तन के लिए अलर्ट प्राप्त करें

समान उपकरण

क्या है Thinkless?

Thinkless एक नवीनतम ढांचा है जिसे बड़े भाषा मॉडल (LLMs) के लिए डिज़ाइन किया गया है ताकि वे जवाब उत्पन्न करने से पहले विचार करने का समय कब लेना चाहिए यह सीख सकें। Thinkless एक अद्वितीय प्रशिक्षण पद्धति का उपयोग करता है जो पुनर्बलन सीखने पर आधारित है, ताकि यह बड़े भाषा मॉडल (LLMs) में कारण स्पष्टता को अनुकूलित कर सके, जिससे उन्हें कार्यों की जटिलता के आधार पर छोटे और लंबे रूपों के उत्तरों के बीच चयन करने की सुविधा मिलती है। हाल ही में, इस ढांचे में महत्वपूर्ण सुधार किए गए हैं, जिसने LLMs में अनुकूलनशील तर्क के लिए इसे एक प्रमुख समाधान के रूप में स्थापित किया है।

Thinkless का मुख्य नवाचार इसके कुशल उपयोग में है, जो Decoupled Group Relative Policy Optimization (DeGRPO) एल्गोरिदम पर आधारित है। यह उन्नत दृष्टिकोण रणनीतिक रूप से सीखने के लक्ष्यों को दो अलग-अलग घटकों में विभाजित करता है: एक तर्क मोड के चयन को एक नियंत्रण टोकन हानि के माध्यम से देखता है, जबकि दूसरा प्रतिक्रिया हानि के माध्यम से उत्पन्न उत्तरों की सटीकता को बढ़ाता है। इस बारिकी से विभाजन न केवल प्रशिक्षण प्रक्रिया को स्थिर करता है बल्कि LLM तर्क से संबंधित गणनात्मक बोझ को भी कम करता है, जिससे अधिक कुशल संचालन संभव होता है। इसके अलावा, एल्गोरिदम में सुधार किए गए हैं ताकि प्रशिक्षण को स्थिर करने और समान तरीकों के सादा कार्यान्वयन में अक्सर देखी जाने वाली प्रदर्शन गिरावट को रोकने की क्षमता को बढ़ाया जा सके।

यह कैसे काम करता है

Thinkless ढांचे का दिल दो प्रमुख नियंत्रण टोकन पर आधारित है:

प्रमुख विशेषताएँ

- अनुकूलनशील तर्क: Thinkless अपने उत्तर उत्पन्न करने को कार्य की जटिलता और मॉडल की क्षमताओं के अनुसार समायोजित करता है, जिससे यह अत्यधिक बहुपरकारी बनता है।

- सुधारी गई दक्षता: ढांचा व्यापक तर्क पथों की आवश्यकता को महत्वपूर्ण रूप से कम करता है, जो विभिन्न बेंचमार्क परीक्षणों में प्रदर्शन में सुधार के साथ संबंधित होता है, लंबे श्रृंखला सोच की आवश्यकताओं को 50-90% तक कम करता है।

- पुनर्बलन सीखने का दृष्टिकोण: Thinkless एक पुनर्बलन सीखने के ढांचे का उपयोग करता है जो न केवल कार्य की जटिलता को बेहतर समझने को बढ़ावा देता है बल्कि यह भी भविष्यवाणी करता है कि कब गहरे तर्क आवश्यक होते हैं।

- व्यावहारिक परिणाम: ढांचे के नवीनतम संस्करणों ने व्यावहारिक परीक्षणों में उत्कृष्ट परिणाम प्रदर्शित किए हैं, जो LLM प्रशिक्षण और तर्क के लिए इसके नवीनतम दृष्टिकोण को और मान्यताप्रद करते हैं।

इंस्टॉलेशन और उपयोग

Thinkless को स्थापित करना सरल है और इसे सीधे एक कोंडा वातावरण के भीतर कार्यान्वित किया जा सकता है। स्थापना प्रक्रिया में Python निर्भरताओं को स्थापित करना, आधिकारिक भंडार से संबंधित मॉडल घटकों को डाउनलोड करना, और प्रशिक्षण शुरू करने के लिए एक सरल कमांड-लाइन प्रक्रिया का उपयोग करना शामिल है। उपयोगकर्ताओं को सेटअप के दौरान विस्तृत दस्तावेज़ीकरण के माध्यम से मार्गदर्शित किया जाता है, जिससे ऑनबोर्डिंग अनुभव को बढ़ाया जाता है जबकि सेटअप से जुड़े अस्पष्टताओं को समाप्त किया जाता है।

निष्कर्ष

संक्षेप में, Thinkless एक भविष्य के दृष्टिकोण वाला उपकरण है जो LLMs के जटिल तर्क कार्यों के साथ इंटरफ़ेस को पुनर्परिभाषित करता है, गणनात्मक दक्षता और उत्तर की सटीकता को महत्वपूर्ण रूप से आगे बढ़ाता है। अपने नवीनतम डिज़ाइन और वास्तविक दुनिया के परिदृश्यों में व्यावहारिक अनुप्रयोगों का लाभ उठाते हुए, Thinkless तेजी से विकसित हो रहे कृत्रिम बुद्धिमत्ता के क्षेत्र में शोधकर्ताओं और पेशेवरों के लिए एक महत्वपूर्ण संसाधन के रूप में खड़ा है। इसके ongoing विकास में संलग्न होना यह सुनिश्चित करता है कि यह न केवल वर्तमान मांगों को पूरा करे बल्कि बड़े भाषा मॉडल और उन्नत तर्क के क्षेत्र में भविष्य की आवश्यकताओं के लिए अनुकूलित हो।

फायदे और नुकसान

फायदे

- कार्य निष्पादन में दक्षता बढ़ाने के लिए अनुकूलनशील तर्क का उपयोग करता है।

- युनीक reinforcement learning मॉडल का उपयोग करता है जिसमें डुअल कंट्रोल टोकन होते हैं।

- लंबी श्रृंखला तर्क के उपयोग को महत्वपूर्ण रूप से कम करता है, जिससे गणना की गति बढ़ती है।

अक्सर पूछे जाने वाले प्रश्न

Thinkless ओपन सोर्स है और उपयोग के लिए मुफ्त है।

हमारी नवीनतम जानकारी के अनुसार, इस उपकरण में वर्तमान में जीवनकाल सौदा उपलब्ध नहीं है, दुर्भाग्यवश।

DeGRPO एल्गोरिदम Thinkless ढांचे का मूल है। यह हाइब्रिड तर्क के शिक्षण उद्देश्य को दो अलग-अलग घटकों में विभाजित करता है: एक नियंत्रण टोकन हानि और एक प्रतिक्रिया हानि। इस विभाजन से प्रशिक्षण के दौरान प्रत्येक उद्देश्य के योगदान पर बारीक नियंत्रण रखने की अनुमति मिलती है। नियंत्रण टोकन हानि यह निर्धारित करती है कि मॉडल संक्षिप्त और लंबी तर्क के बीच कैसे चयन करता है, जबकि प्रतिक्रिया हानि उत्पन्न उत्तरों की सटीकता को बढ़ाती है। प्रशिक्षण को स्थिर करके और गिरावट को रोककर, DeGRPO विभिन्न तर्क बेंचमार्क पर प्रदर्शन में महत्वपूर्ण सुधार करता है।

Thinkless गणनात्मक दक्षता को इस तरह से बढ़ाता है कि यह भाषा मॉडलों को कार्य की जटिलता और मॉडल की क्षमताओं के आधार पर लघु-न्याय (short-form) और दीर्घ-न्याय (long-form) के बीच चयन करने की अनुमति देता है। लंबे श्रृंखला के सोचने की आवश्यकता को 50% से 90% तक कम करके, Thinkless अनुमान के दौरान संसाधन खपत को कम करता है जबकि परिणामों की सटीकता को बनाए रखते हुए या इसे बढ़ाते हुए। यह बड़े भाषा मॉडलों में पारंपरिक तर्क विधियों की तुलना में अधिक प्रभावी बनाता है।

Thinkless को स्थापित करने के लिए, आपको Python 3.10 और आवश्यक निर्भरताओं के साथ एक वातावरण बनाना होगा। विशेष रूप से, एक नया वातावरण बनाने के लिए Conda का उपयोग करें और PyTorch, LM_eval, और Ray जैसे पैकेज स्थापित करें। CUDA समर्थन के लिए, सुनिश्चित करें कि आप NVIDIA CUDA का उचित संस्करण स्थापित करें। विस्तृत स्थापना कमांड GitHub पर प्रोजेक्ट के README में दिए गए हैं। अपने सिस्टम सेटअप के आधार पर किसी भी अतिरिक्त आवश्यकताओं के लिए दस्तावेज़ीकरण की जांच करना सुनिश्चित करें।

हां, Thinkless को लोकप्रिय मशीन लर्निंग ढाँचे, जैसे कि PyTorch, के साथ एकीकृत करने के लिए डिज़ाइन किया गया है, जैसे कि torch पैकेज को निर्भरता के रूप में स्थापित करने से संकेत मिलता है। चूंकि इसे मानक उपकरणों का उपयोग करके बनाया गया है, उपयोगकर्ता इसे डेटा प्रोसेसिंग और अतिरिक्त मॉडल प्रशिक्षण जैसे कार्यों के लिए अन्य लाइब्रेरी और ढांचों के साथ इंटरफेस कर सकते हैं। उपयोगकर्ता GitHub रिपॉजिटरी में स्थापना और उपयोग के निर्देशों का संदर्भ ले सकते हैं ताकि एकीकरण की बेहतर समझ प्राप्त कर सकें।

Thinkless के साथ जल्दी से शुरू करने के लिए, आपको पहले अपनी प्रोग्रामिंग वातावरण को आवश्यक Python संस्करण और पुस्तकालयों के साथ सेट करना होगा। अपनी Conda वातावरण को सक्रिय करने के बाद, आप transformers पुस्तकालय से AutoModelForCausalLM और AutoTokenizer को आयात कर सकते हैं। इसके बाद, Thinkless मॉडल को लोड करें और तर्क करने के लिए अपने इनपुट प्रॉम्प्ट तैयार करें। इस प्रोजेक्ट की दस्तावेजीकरण में उत्तर उत्पन्न करने और मॉडल आउटपुट का प्रभावी मूल्यांकन करने के लिए मार्गदर्शन करने वाले उदाहरण कोड स्निप्पेट शामिल हैं।

आप रिपॉजिटरी में प्रदान किए गए मूल्यांकन स्क्रिप्ट का उपयोग करके थिंकलेस मॉडल के प्रदर्शन का मूल्यांकन कर सकते हैं, जो आपको कई इनफेरेंस पुनरावृत्तियाँ चलाने की अनुमति देते हैं। यह विभिन्न कार्यों और मैट्रिक्स के लिए परिणाम एकत्र करने में मदद करेगा। मूल्यांकन उपकरण OpenAI/simple-evals में प्रॉम्प्ट्स पर आधारित है, और आप calcs में सहेजे गए परिणामों से मैट्रिक्स उत्पन्न करने के लिए मूल्यांकन कमांड चला सकते हैं, जैसे कि सटीकता और प्रतिक्रिया गुणवत्ता, जो मॉडल की क्षमताओं को समझने में सहायता करते हैं।

हालांकि Thinkless तर्क कार्यों में दक्षता को काफी हद तक बढ़ाता है, संभावित सीमाएँ प्रारंभिक मॉडल की गुणवत्ता और प्रशिक्षण डेटा की गुणवत्ता पर निर्भरता शामिल हैं। यह एल्गोरिदम कुछ विशेष, अत्यधिक जटिल तर्क कार्यों पर भी आदर्श रूप से प्रदर्शन नहीं कर सकता, जिन्हें संदर्भ की गहरी समझ की आवश्यकता होती है। इसके अलावा, thinkless_alpha और correct_think_reward जैसे हाइपरपैरामीटर्स को सबसे अच्छे परिणाम प्राप्त करने के लिए प्रयोग करने की आवश्यकता हो सकती है, जो समय लेने वाला हो सकता है।

Thinkless को फाइन-ट्यून करने के लिए, आप हाइपरपैरामीटर्स को समायोजित करने से शुरू कर सकते हैं, जैसे thinkless_alpha और correct_think_reward। यदि संकुचन धीमा है या यदि मॉडल किसी विशेष तर्क पद्धति की ओर झुकता है, तो प्रदर्शन में सुधार के लिए इन पैरामीटर्स को क्रमिक रूप से बढ़ाने पर विचार करें। परियोजना की दस्तावेज़ीकरण में उल्लिखित विभिन्न प्रशिक्षण डेटा सेटों और तकनीकों के साथ प्रयोग करना भी आपके विशेष उपयोग मामले के आधार पर प्रदर्शन को अनुकूलित करने में मदद कर सकता है।