Thinkless

Framework per LLM per ottimizzare il ragionamento scegliendo la complessità della risposta in base alle esigenze del compito.

Github.comSegui per aggiornamenti e offerte

Ricevi avvisi su sconti, nuove funzionalità e cambiamenti di prezzo per Thinkless

Strumenti Simili

Cos'è Thinkless?

Thinkless è un framework innovativo progettato per i modelli di linguaggio di grandi dimensioni (LLM) per apprendere quando pensare criticamente prima di generare risposte. Sfruttando un paradigma di formazione unico basato sull'apprendimento per rinforzo, Thinkless mira a ottimizzare il ragionamento nei modelli di linguaggio di grandi dimensioni (LLM), consentendo loro di scegliere tra risposte brevi e lunghe in base alla complessità dei compiti. Recentemente, sono stati effettuati notevoli miglioramenti al framework, consolidando la sua posizione come soluzione leader per il ragionamento adattivo nei LLM.

L'innovazione centrale di Thinkless risiede nel suo uso sofisticato dell'algoritmo Decoupled Group Relative Policy Optimization (DeGRPO). Questo approccio avanzato separa strategicamente gli obiettivi di apprendimento in due componenti distinte: una supervisiona la scelta della modalità di ragionamento attraverso una perdita di token di controllo, mentre l'altra aumenta l'accuratezza delle risposte generate tramite una perdita di risposta. Questa separazione meticolosa non solo stabilizza il processo di formazione ma riduce anche il carico computazionale associato al ragionamento LLM, facilitando operazioni più efficienti. Inoltre, sono stati apportati miglioramenti all'algoritmo per aumentarne la capacità di stabilizzare l'allenamento e prevenire il collasso delle prestazioni che si osserva spesso nelle implementazioni naive di metodi simili.

Come Funziona

Il cuore del framework Thinkless è composto da due token di controllo chiave:

Caratteristiche Chiave

- Ragionamento Adattivo: Thinkless adatta la sua generazione di risposte secondo la complessità del compito e le capacità del modello, rendendolo altamente versatile.

- Efficienza Migliorata: Il framework riduce notevolmente la necessità di percorsi di ragionamento estesi, il che si correla con miglioramenti delle prestazioni in vari test benchmark, riducendo i requisiti di pensiero lungo del 50-90%.

- Approccio di Apprendimento per Rinforzo: Thinkless impiega un framework di apprendimento per rinforzo che non solo promuove una migliore comprensione della complessità del compito, ma prevede anche quando è imperativo un ragionamento più profondo.

- Risultati Empirici: Le ultime iterazioni del framework hanno dimostrato risultati superiori in test empirici, convalidando ulteriormente il suo approccio innovativo alla formazione e al ragionamento LLM.

Installazione e Utilizzo

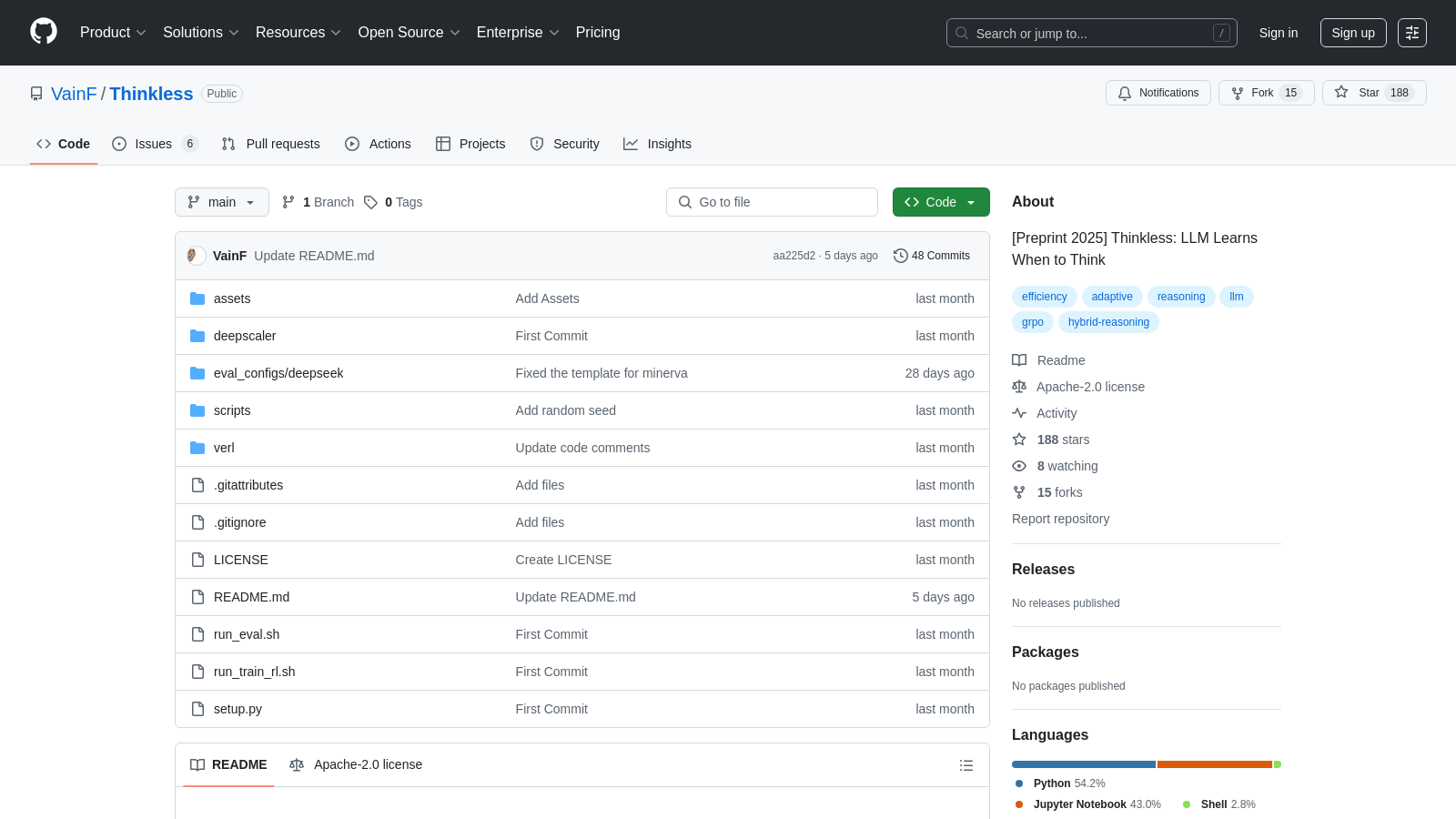

Impostare Thinkless è semplice e può essere eseguito direttamente all'interno di un ambiente conda. Il processo di installazione comprende la configurazione delle dipendenze di Python, il download dei componenti del modello pertinenti dal repository ufficiale, e l'utilizzo di un semplice processo da riga di comando per avviare l'allenamento. Gli utenti sono guidati attraverso la configurazione con documentazione dettagliata trovata all'interno del repository, migliorando l'esperienza di onboarding e eliminando ambiguità nella configurazione.

Conclusione

In sintesi, Thinkless incarna uno strumento lungimirante che ridefinisce il modo in cui i LLM interagiscono con compiti di ragionamento complessi, avanzando significativamente l'efficienza computazionale e l'accuratezza delle risposte. Sfruttando il suo design innovativo e le sue applicazioni pratiche in scenari reali, Thinkless rappresenta una risorsa cruciale sia per i ricercatori che per i professionisti nel campo in rapida evoluzione dell'intelligenza artificiale. Il coinvolgimento nel suo sviluppo continuo assicura che non solo soddisfi le attuali esigenze ma si adatti alle necessità future nel regno dei modelli di linguaggio di grandi dimensioni e del ragionamento avanzato.

Pro e Contro

Pro

- Utilizza un ragionamento adattivo per migliorare l'efficienza nell'esecuzione dei compiti.

- Utilizza un modello di apprendimento per rinforzo unico con due token di controllo.

- Riduce significativamente l'uso del ragionamento a lungo termine, migliorando la velocità di calcolo.

Domande Frequenti

Thinkless è open source e gratuito da usare.

Secondo le nostre ultime informazioni, questo strumento non sembra avere un affare a vita al momento, purtroppo.

L'algoritmo DeGRPO è al centro del framework Thinkless. Decompone l’obiettivo di apprendimento del ragionamento ibrido in due componenti separate: una perdita di token di controllo e una perdita di risposta. Questa separazione consente un controllo dettagliato sui contributi di ciascun obiettivo durante l’addestramento. La perdita di token di controllo determina come il modello sceglie tra ragionamento di breve e lungo termine, mentre la perdita di risposta migliora l'accuratezza delle risposte generate. Stabilizzando l’addestramento e prevenendo il collasso, DeGRPO migliora notevolmente le prestazioni su vari benchmark di ragionamento.

Thinkless migliora l'efficienza computazionale consentendo ai modelli di linguaggio di selezionare in modo adattivo tra ragionamento di breve e lungo periodo, a seconda della complessità del compito e delle capacità del modello. Riducendo la necessità di pensiero a lungo termine del 50% al 90%, Thinkless minimizza il consumo di risorse durante l'inferenza mantenendo o addirittura migliorando l'accuratezza dei risultati. Questo lo rende più efficiente rispetto agli approcci di ragionamento tradizionali nei grandi modelli di linguaggio.

Per installare Thinkless, devi creare un ambiente con Python 3.10 e le dipendenze necessarie. In particolare, utilizza Conda per creare un nuovo ambiente e installare pacchetti come PyTorch, LM_eval e Ray. Per il supporto CUDA, assicurati di installare la corrispondente versione di NVIDIA CUDA. I comandi di installazione dettagliati sono forniti nel README del progetto su GitHub. Assicurati di consultare la documentazione per eventuali requisiti aggiuntivi in base alla configurazione del tuo sistema.

Sì, Thinkless è progettato per integrarsi con i framework di machine learning più popolari, come PyTorch, come indicato dall'installazione del pacchetto torch come dipendenza. Poiché è costruito utilizzando strumenti standard, gli utenti possono interfacciarlo con altre librerie e framework per attività come l'elaborazione dei dati e l'ulteriore addestramento dei modelli. Gli utenti possono consultare le istruzioni per l'installazione e l'uso nel repository di GitHub per comprendere meglio l'integrazione.

Per iniziare rapidamente con Thinkless, dovrai prima configurare il tuo ambiente di programmazione con la versione di Python e le librerie richieste. Dopo aver attivato il tuo ambiente Conda, puoi importare AutoModelForCausalLM e AutoTokenizer dalla libreria transformers. Da lì, carica il modello Thinkless e prepara i tuoi input per il ragionamento. La documentazione del progetto include frammenti di codice di esempio per guidarti nella generazione di risposte e nella valutazione efficace delle uscite del modello.

Puoi valutare le performance del modello Thinkless utilizzando gli script di valutazione forniti nel repository, che ti permettono di eseguire più ripetizioni di inferenza. Questo ti aiuterà a raccogliere risultati per diversi compiti e metriche. Lo strumento di valutazione si basa sui prompt in OpenAI/simple-evals, e puoi eseguire comandi di valutazione per generare metriche dai risultati salvati in calcs, come accuratezza e qualità della risposta, che aiutano a comprendere le capacità del modello.

Sebbene Thinkless migliori significativamente l'efficienza nei compiti di ragionamento, le potenziali limitazioni includono una dipendenza dalla qualità del modello iniziale e dalla qualità dei dati di addestramento. L'algoritmo potrebbe anche non funzionare in modo ottimale su compiti di ragionamento specifici e altamente complessi che richiedono una profonda comprensione del contesto. Inoltre, la regolazione dei parametri come thinkless_alpha e correct_think_reward potrebbe richiedere sperimentazione per ottenere i migliori risultati, il che può richiedere tempo.

Per adattare Thinkless, puoi iniziare regolando i parametri iper, come thinkless_alpha e correct_think_reward. Se la convergenza è lenta o se il modello tende verso un particolare modo di ragionamento, considera di aumentare gradualmente questi parametri per migliorare le prestazioni. Sperimentare con diversi set di dati di addestramento e tecniche descritte nella documentazione del progetto può anche aiutare a ottimizzare le prestazioni in base al tuo caso d'uso specifico.