更新情報とお得な情報をフォロー

Ollama の割引、機能リリース、価格変更の通知を受け取る

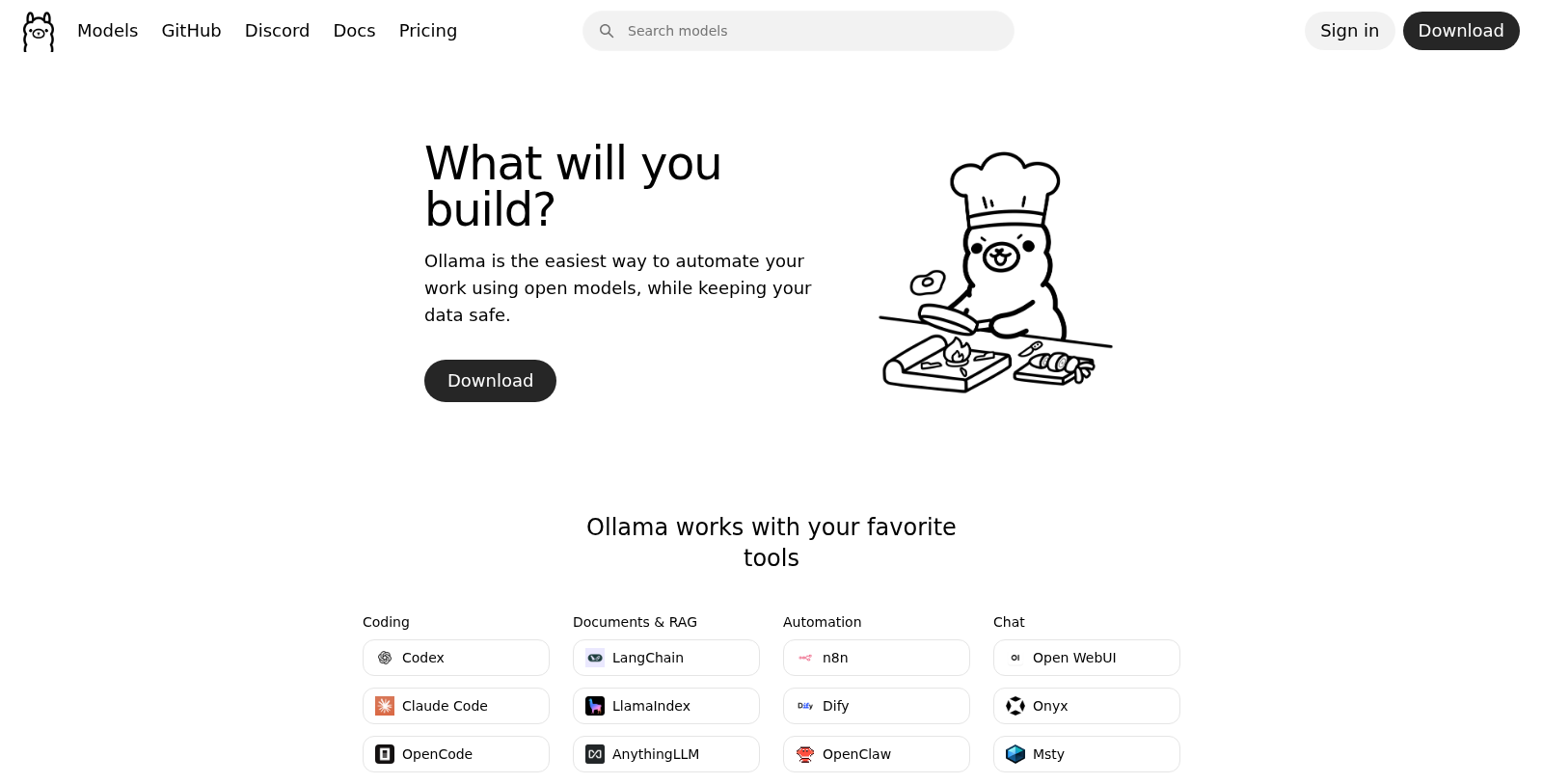

Ollamaとは何ですか?

Ollamaは、大規模言語モデルを用いた作業の自動化を簡素化する強力なツールです。ユーザーはデータプライバシーと効率を確保しながら、好みのモデルを様々なアプリケーションに簡単に統合できます。

このプラットフォームは、異なるニーズに合わせた3つの異なるプラン(Free、Pro、Max)を提供しています。Freeプランは基本的な統合と使用を提供し、ユーザーは費用をかけずにタスクを自動化できます。Proプランは月額20ドルで、複数のクラウドモデルを同時に実行する能力、クラウド使用の向上、プライベートモデル、コラボレーション機能などの拡張機能を提供します。重いタスクに従事するユーザーには、月額100ドルのMaxプランがあり、さらに大規模なクラウドモデル使用、追加のコラボレーター、包括的なタスク処理能力が提供されます。

Ollamaの主な利点の1つは、データプライバシーへの取り組みです。ユーザーはローカルハードウェアでタスクを実行しつつ、大規模モデルのためにクラウド機能を活用することで、機密情報のセキュリティを確保できます。

Ollamaは、40,000以上のコミュニティ駆動の統合により、コーディングツール、文書分析、自動化プロセスとの幅広い統合をサポートしています。これにより、コーディングタスクの自動化から文書構造の管理まで、さまざまなアプリケーションに適しています。

モデルと使用法

Ollamaを使用すると、gpt-oss、DeepSeek-R1などのさまざまなモデルをプロジェクトで利用できます。このプラットフォームの設計は、ユーザーのニーズに応じて軽いから重い使用まで対応可能であり、各プランに応じた使用制限があります。たとえば、Freeプランのユーザーは基礎的なインタラクションに適した軽い使用を受け、ProおよびMaxプランのユーザーは、継続的な作業やデータ量の多いタスクに理想的なより強力な機能を得ることができます。

コミュニティとサポート

Ollamaはまた、ユーザーがDiscordチャンネルに参加したり、フォーラムで活動したり、ツールの可能性を最大限に引き出し問題を解決するための豊富な文書にアクセスできる活気あるコミュニティを育んでいます。コミュニティライブラリはエコシステムをさらに豊かにし、ユーザーが既存の機能に基づいて構築したり改善を共有したりできるようにします。

セキュリティ機能

データのセキュリティはOllamaにとって最も重要であり、プラットフォームは使用中にプロンプトやレスポンスデータをログに記録しないことを明示しています。これにより、機密情報はローカルのマシンに留まり、クラウドモデルのリクエストは転送中に暗号化されて安全性が向上します。

将来の計画

今後、Ollamaはチームおよび企業用に拡張された機能を展開し、大規模な言語モデルを広範囲に導入しようとする企業へのアクセス可能性を広げる計画です。

結論として、Ollamaは、データのセキュリティを確保しながら大規模言語モデルの力を活用しようとする個人開発者や組織向けに設計されています。シンプルな価格構造、堅実なコミュニティ、および多様な統合オプションを組み合わせることで、AI駆動の自動化を使用して作業を最適化したい人々にとって魅力的な選択肢となっています。

利点と欠点

利点

- モデルのローカル実行をサポートし、データのプライバシーを確保します。

- さまざまなツールと統合されており、柔軟な自動化タスクを容易にします。

- モデルのカスタマイズと共有が可能で、協力的なワークフローを向上させます。

欠点

- オラマのクラウドモデルの使用は、大量のワークロードに対してサブスクリプション階層によって制限されています。

よくある質問

Ollamaは無料で始められ、料金プランは0から100 USDまで、月ごとに提供されています。

最新の情報によると、残念ながらこのツールには現在生涯契約がないようです。

Ollamaは、コード生成、文書分析、一般的なデータ操作などのタスクを自動化するのに特に効果的です。このツールは、コーディングエージェントの開発、迅速な文書分析の実施、n8nやDifyなどの自動化ツールとのシームレスな統合に使用でき、さまざまな分野で効率的なワークフローを実現します。

はい!Ollamaは、エアギャップ環境に最適な自分のハードウェア上で完全にオフラインで動作するように設計されています。クラウド機能はオプションで、ローカルで大規模な言語モデルを活用しつつ、データをプライベートに保つことができます。

Ollamaはコーディングタスクに最適化されたいくつかのモデルをサポートしています。特に、glm-4.7-flashモデルはエージェント機能をサポートしているため、コーディングに推奨されています。また、Ollamaと一緒にCodex、Claude Code、OpenCodeなどの人気ツールを使用することで、コーディングの生産性を向上させることができます。

Ollamaでは、モデルをプリロードすることで、応答時間を短縮できます。デフォルトでは、モデルはアンロードされる前に5分間メモリに保持されます。'keep_alive'パラメータを使用して、モデルが保持される時間を指定することで、これを管理できます。また、Ollamaサーバーの設定を直接構成することも可能です。これは、迅速なアクセスが必要なシナリオでのパフォーマンス最適化に特に役立ちます。

Ollamaのクラウドモデルには、プランごとに異なる年齢制限があります。たとえば、無料プランはチャットサポートなどの軽いタスクをサポートしています。一方、Proプランはデータ分析などのより広範なタスクをサポートします。Maxプランは、コーディングエージェントやバッチ処理などのワークロードに対して使用制限を設けています。

もちろんです!サブスクリプションに加入することで、プライベートモデルを作成し、協力者を招待して一緒に作業できます。モデルごとの協力者の数は、Proプランで3人、Maxプランで5人に制限されており、プラットフォーム内での効果的なチームワークが可能になります。

Ollamaの環境変数は、使用しているオペレーティングシステムに応じて設定できます。たとえば、macOSの場合は『launchctl』を使用して変数を設定し、Linuxの場合はsystemdサービスを調整します。Windowsの場合は、コントロールパネルを通じてシステムレベルの環境変数を変更できます。詳細な手順は設定ドキュメントに記載されています。

Ollamaはデータのセキュリティを非常に重要視しています。プロンプトやレスポンスデータをログに記録したり保存したりすることはなく、すべてのクラウドリクエストは転送中に暗号化されています。これにより、あなたのデータのプライバシーが守られ、外部サーバーに情報を送信することなくローカルでモデルを実行できます。