更新情報とお得な情報をフォロー

vui の割引、機能リリース、価格変更の通知を受け取る

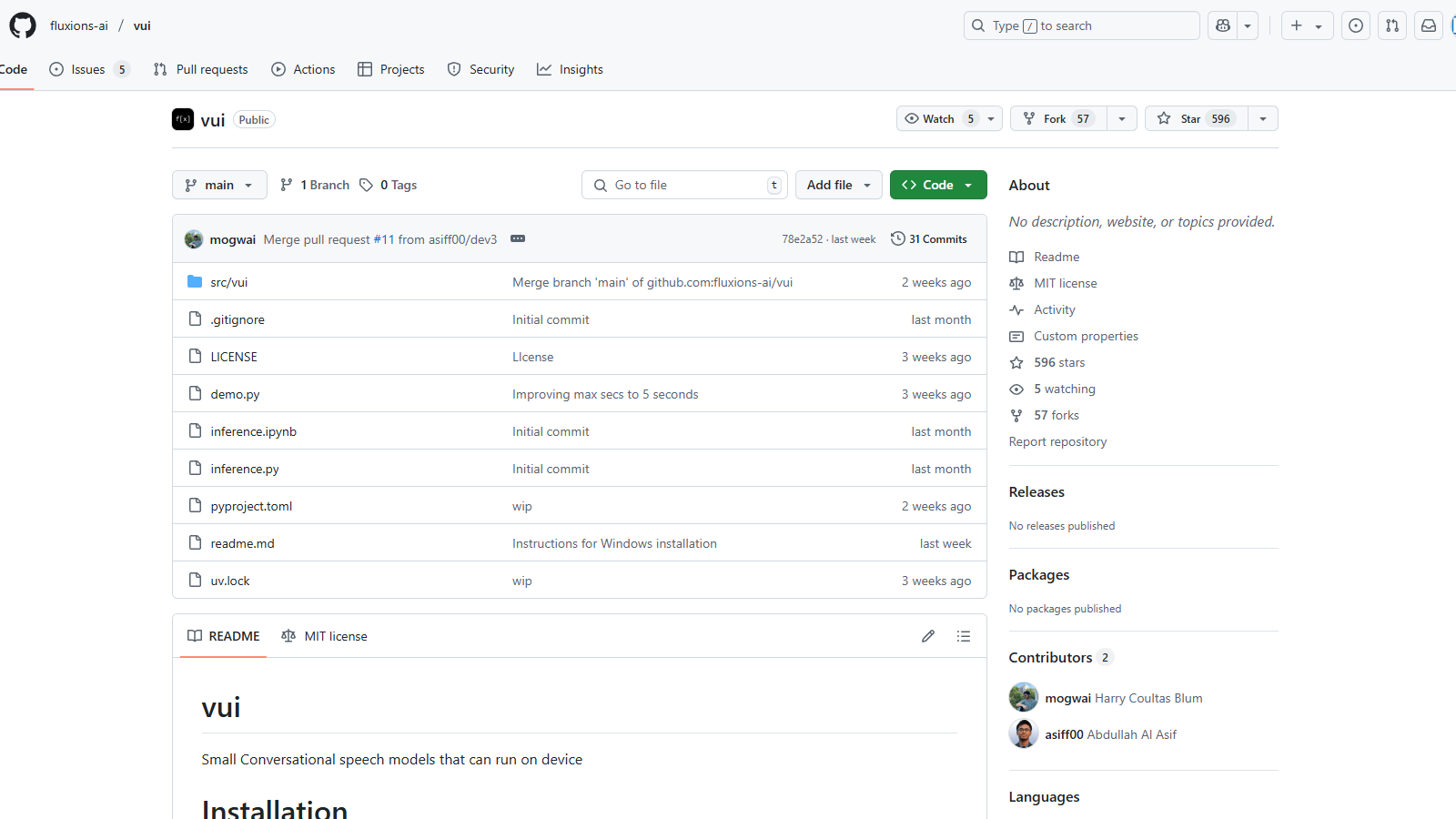

vuiとは何ですか?

VUIは、デバイス上で直接操作するために設計された会話型スピーチモデルに焦点を当てた革新的なツールであり、スピーチ関連のタスクに対して効率的でユーザーフレンドリーなソリューションを提供します。VUIツールキットで利用可能な主なモデルは、大規模なデータセットでトレーニングされており、音声を効果的に処理し、文脈に関連する応答を生成することができます。

更新された主要機能:

- 複数のモデル:Vuiは、Vui.BASE、Vui.ABRAHAM、およびVui.COHOSTを含むさまざまなモデルを提供しており、それぞれ異なるタイプの会話インタラクションに最適化されています。Vui.BASEは、40,000時間の音声会話で特にトレーニングされており、さまざまなアプリケーションのための堅牢な基盤を提供します。

- ボイスクローン:ユーザーは、事前にトレーニングされたデータセットに基づいて、合理的な精度で声を複製できるボイスクローン機能を活用できます。声のクローン化能力が向上していますが、トレーニングデータの制限により、結果が完璧ではないことが notedされます。

- 効率:これらのモデルは、広範なクラウドリソースを必要とせずにデバイスで効果的に機能するよう設計されており、低遅延と高い応答性を必要とするアプリケーションに最適です。VUIモデルは、音声トークンを予測するラマベースのトランスフォーマーを利用しており、処理効率を改善するモデルアーキテクチャの進展を示しています。

- オーディオトークン化:重要な機能は、フルアクオーディオトークナイザーであり、これにより1秒あたりのコード数を効果的に削減し、全体的な処理速度を83.1Hzから21.53Hzに向上させます。

インストールと使用法:

VUIを使用するには、ユーザーはコマンドpip install -e .を使用してパッケージマネージャ経由で簡単にインストールできます。インストールプロセスは簡単で、python demo.pyを実行することでデモを実行できます。この柔軟性により、開発者はさまざまなアプリケーションでモデルを実装でき、シームレスな音声認識と生成機能でユーザー体験を向上させます。

課題と考慮事項:

モデルは印象的な能力を示していますが、限界がないわけではありません。ユーザーは、AIがトレーニングデータに基づかない応答を生成する場合に発生する偶発的な錯覚などのいくつかの奇妙さを経験する可能性があります。この現実は、開発チームによって認識されており、継続的な改善とコミュニティとの関与に努めています。

これらの課題にもかかわらず、VUIモデルは、特に音声を通じてインタラクティビティを向上させることを目指しているプロジェクトにとって重要な進展を示しています。開発チームは、継続的な改善に重点を置き、洞察を共有し、コミュニティのフィードバックに基づいて問題に対処することを強調しています。この開発へのコミットメントは、最先端の技術の使用と他のオープンソースプロジェクトとの共同努力によって支えられています。

著作権表示:

VUIの開発は、OpenAIのWhisperやFacebook ResearchのAudiocraftを含むいくつかのオープンソースプロジェクトからの貢献を認めており、音声処理のための堅牢なツールを構築するための共同の努力を示しています。これらのコラボレーションを通じて、VUIはその提供を強化し、急速に進化するオーディオ処理技術の分野での関連性を維持しています。

利点と欠点

利点

- クラウドサポートなしでデバイス上で動作できる小型の会話音声モデルを提供します。

- 多様なアプリケーションに対応する文脈認識型の単一スピーカーおよび二重スピーカーのモデルを含んでいます。

- オーディオトークン予測にラマベースのトランスフォーマーを利用しており、パフォーマンスを向上させています。

欠点

- 音声クローンは、限られたトレーニングデータとリソースのために完璧ではありません。

よくある質問

vuiはオープンソースで、無料で使用できます。

最新の情報によると、残念ながらこのツールには現在生涯契約がないようです。

{toolName}は主に三つのモデルを提供しています。Vui.BASEは、4万時間の音声会話で学習した基本チェックポイントです。Vui.ABRAHAMは、文脈に応じた返答ができる単一スピーカーモデルとして設計されています。そして、Vui.COHOSTは二人のスピーカー間のコミュニケーションを可能にします。これらのモデルは、基本的な会話のやり取りから、複数の参加者の間での複雑な対話まで、さまざまなユースケースに対応しています。

はい、{toolName}をローカルで実行できます。インストールするには、以下の構文を使用してpipコマンドを実行してください:'pip install -e .' これにより、ツールが編集可能モードでインストールされます。セットアップには、デバイスにPythonがインストールされていることを確認してください。詳細な手順と要件については、リポジトリ内のREADMEドキュメントを参照してください。

{toolName}はボイスクローン機能を提供していますが、基本モデルは限られたトレーニングデータセットのため、完璧な結果を生成しない可能性があることに注意が必要です。このモデルは広範な音声入力を受けていないため、特定の声をクローンする際に不一致が生じることがあります。ユーザーは期待値を適切に管理し、ボイスクローン機能を使用する際にこの点を考慮する必要があります。

{toolName}は、Descript-Audio-Codecに基づくFluacとの協力で開発された強力な音声トークン化技術を利用しています。これにより、処理される音声コードの数が83.1 Hzから21.53 Hzに減少し、音声処理中のデータ処理の効率が向上します。この改善により、より速く正確な音声予測が可能になります。

最適なパフォーマンスを得るためには、{toolName} を高性能なハードウェアで運用することが推奨されます。具体的には、NVIDIA 4090 GPU を搭載したセットアップが最適です。開発者によると、このような強力なハードウェアを使用することで、処理時間が短縮され、集中的なオーディオ操作を処理するモデルの能力が向上します。

はい、{toolName}は幻覚の現象を経験することがあります。この場合、出力が現実と一致しないことがあります。これは特に限られたリソースを使用してトレーニングする際に、AIモデルのパフォーマンスにおける一般的な課題です。ユーザーはこの点を理解し、重要な出力の正確性を確認する必要があります。

{toolName}をWhisperやAudiocraftなどの他のツールと統合することで、その機能を拡張できます。Whisperは強力な音声認識をサポートし、Audiocraftは音声処理機能を強化できます。これらのパートナーシップを探求することで、{toolName}のユーザー体験や機能を大幅に向上させることができます。

{toolName}はGitHubでホストされており、ユーザーは問題やディスカッションを通じてコミュニティサポートを見つけることができます。詳細な使い方については、リポジトリに提供されているREADMEドキュメントを参照してください。コミュニティに参加することで、他のユーザーから貴重なトラブルシューティングのヒントや洞察を得ることもできます。