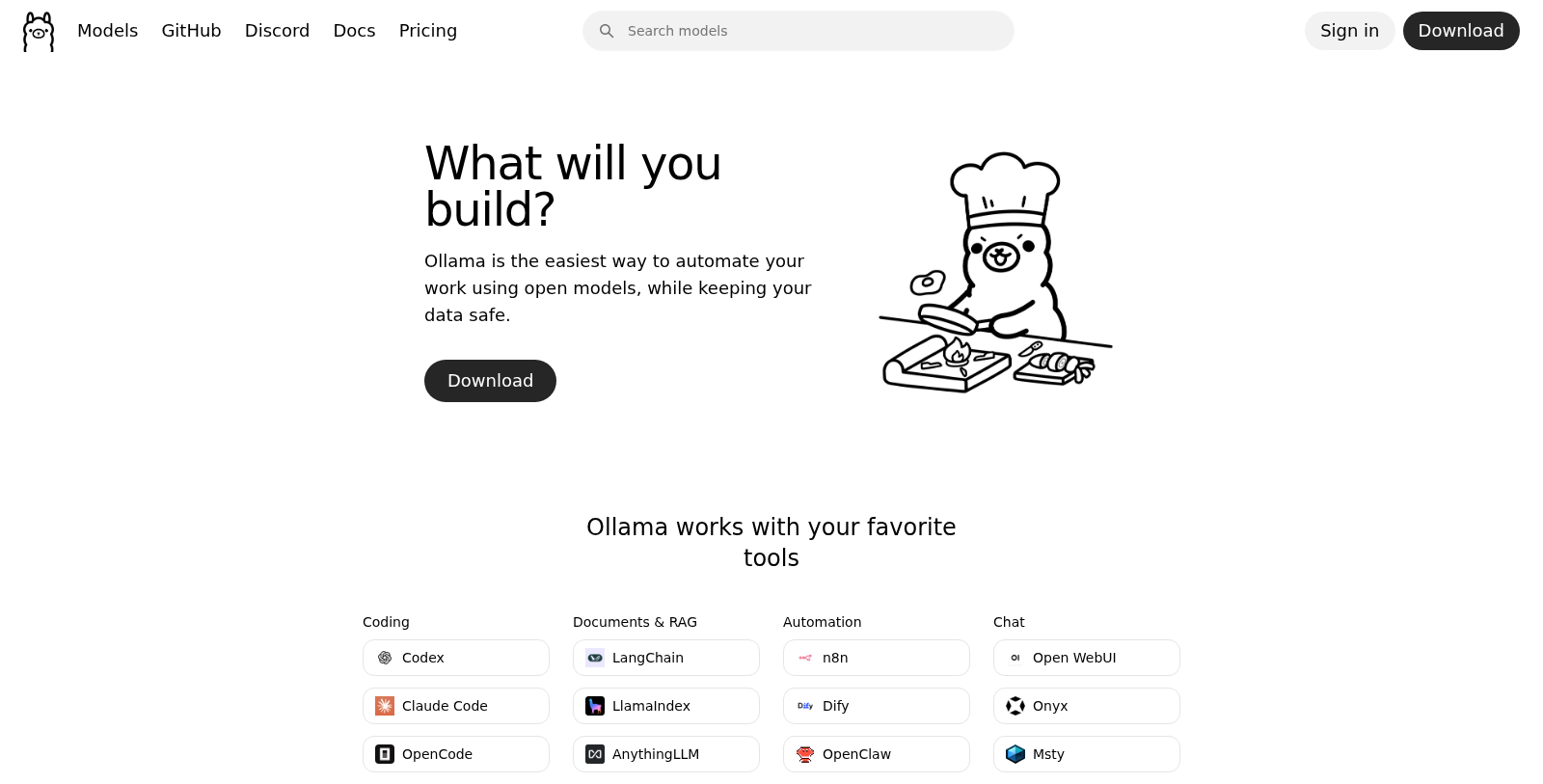

Ollama

Eenvoudig open ta modellen integreren voor taakautomatisering en dataprivacy waarborgen.

Ollama.comVolg voor updates & aanbiedingen

Ontvang meldingen voor Ollama kortingen, nieuwe functies & prijswijzigingen

Vergelijkbare Tools

Wat is Ollama?

Ollama is een krachtig hulpmiddel dat het automatiseren van werk met grote taalmodellen vereenvoudigt. Gebruikers kunnen hun favoriete modellen eenvoudig integreren in verschillende applicaties, terwijl ze dataprivacy en efficiëntie waarborgen.

Het platform biedt drie verschillende plannen die zijn afgestemd op verschillende behoeften: Gratis, Pro en Max. Het Gratis plan biedt basisintegratie en gebruik, zodat gebruikers taken kosteloos kunnen automatiseren. Het Pro plan, geprijsd op $20 per maand, biedt uitgebreide functies, waaronder de mogelijkheid om meerdere cloudmodellen gelijktijdig te draaien, verbeterd cloudgebruik, privé-modellen en samenwerkingsmogelijkheden. Voor gebruikers die met zwaardere taken omgaan, is het Max plan beschikbaar voor $100 per maand, waarmee nog uitgebreidere cloudmodelgebruik, extra samenwerkers en uitgebreide taakafhandelingsmogelijkheden mogelijk zijn.

Een van de belangrijkste voordelen van Ollama is de inzet voor dataprivacy. Gebruikers kunnen taken uitvoeren op hun lokale hardware terwijl ze cloudmogelijkheden voor grotere modellen benutten, waardoor gevoelige informatie veilig blijft.

Ollama ondersteunt een breed scala aan integraties met codeertools, documentanalyse en automatiseringsprocessen dankzij meer dan 40.000 door de gemeenschap aangedreven integraties. Dit maakt het geschikt voor verschillende toepassingen, van het automatiseren van codeertaken tot het beheer van documentstructuren.

Modellen en Gebruik

Met Ollama kunnen gebruikers verschillende modellen zoals gpt-oss, DeepSeek-R1 en anderen in hun projecten benutten. Het ontwerp van het platform is aangepast aan licht tot zwaar gebruik op basis van de behoeften van de gebruiker, met gebruikslimieten die zijn afgestemd op elk plan. Bijvoorbeeld, Gratis gebruikers ontvangen licht gebruik, geschikt voor fundamentele interacties. Ondertussen krijgen Pro en Max gebruikers meer robuuste mogelijkheden die ideaal zijn voor continu werk en datarijke taken.

Gemeenschap en Ondersteuning

Ollama bevordert ook een levendige gemeenschap waar gebruikers zich kunnen aansluiten bij Discord-kanalen, deelnemen aan forums en toegang hebben tot uitgebreide documentatie die hen helpt het potentieel van het hulpmiddel te maximaliseren en eventuele problemen op te lossen. Gemeenschapsbibliotheken verrijken verder het ecosysteem, waardoor gebruikers kunnen voortbouwen op bestaande mogelijkheden en verbeteringen kunnen delen.

Beveiligingsfuncties

Gegevensbeveiliging is van groot belang voor Ollama, aangezien het platform expliciet verklaart dat er geen prompt- of responsgegevens worden opgeslagen tijdens gebruik. Dit betekent dat gevoelige informatie op lokale machines blijft, met cloudmodelverzoeken die versleuteld zijn tijdens verzending voor extra veiligheid.

Toekomstplannen

Met het oog op de toekomst is Ollama van plan om functies uit te breiden voor team- en ondernemingsgebruik, waardoor de toegankelijkheid voor bedrijven die grote taalmodellen op grotere schaal willen inzetten, toeneemt.

Samengevat is Ollama ontworpen voor zowel individuele ontwikkelaars als organisaties die de kracht van grote taalmodellen willen benutten, terwijl ze ervoor zorgen dat gegevens veilig blijven. De eenvoudige prijsstructuur, in combinatie met een robuuste gemeenschap en gevarieerde integratiemogelijkheden, maakt het een aantrekkelijke keuze voor iedereen die hun workflows wil optimaliseren met behulp van AI-gestuurde automatisering.

Voor- en nadelen

Voordelen

- Ondersteunt lokale uitvoering van modellen, wat de privacy van gegevens waarborgt.

- Integreert met verschillende tools, waardoor flexibele automatiseringstaken mogelijk worden.

- Stelt het aanpassen en delen van modellen mogelijk, wat de samenwerkingsprocessen verbetert.

Nadelen

- Het gebruik van het cloudmodel is beperkt door abonnementsniveaus voor zware werkbelastingen.

Veelgestelde Vragen

Ollama is gratis om te beginnen, met betaalde plannen van 0 tot 100 USD per maand.

Volgens onze laatste informatie lijkt deze tool op dit moment helaas geen levenslange deal te hebben.

Ollama is bijzonder effectief voor het automatiseren van taken zoals codegeneratie, documentanalyse en algemene datamanipulatie met behulp van grote taalmodele. Het kan worden gebruikt om coding-agenten te ontwikkelen, snelle documentanalyses uit te voeren en naadloos te integreren met automatiseringstools zoals n8n en Dify, wat efficiënte workflows in verschillende sectoren mogelijk maakt.

Ja! Ollama is ontworpen om volledig offline te draaien op je eigen hardware, wat ideaal is voor air-gapped omgevingen. Cloudfuncties zijn optioneel, zodat je je gegevens privé kunt houden terwijl je lokaal gebruikmaakt van grote taalmodellen.

Ollama ondersteunt verschillende modellen die geoptimaliseerd zijn voor coderingstaken. Vooral het glm-4.7-flash model wordt aanbevolen voor codering, omdat het agentfunctionaliteit ondersteunt. Daarnaast kun je populaire tools zoals Codex, Claude Code en OpenCode gebruiken met Ollama om de productiviteit bij coderen te verbeteren.

Ollama stelt je in staat om modellen voor te laden om snellere responstijden te bereiken. Standaard blijven modellen 5 minuten in het geheugen voordat ze worden ontladen. Je kunt dit beheren door de parameter 'keep_alive' te gebruiken om op te geven hoe lang modellen geladen blijven, door de instellingen van de Ollama-server rechtstreeks te configureren. Dit is vooral nuttig voor het optimaliseren van de prestaties in scenario's die snelle toegang vereisen.

De cloudmodellen in Ollama hebben leeftijdsgrenzen die variëren per abonnement. Het gratis abonnement ondersteunt lichte taken, zoals chatondersteuning. Daarentegen ondersteunt het Pro-abonnement meer uitgebreide taken, zoals data-analyse. Het Max-abonnement stelt gebruiksbeperkingen in voor workloads, zoals coderingsagenten en batchverwerking.

Zeker! Met een abonnement kun je privé-modellen creëren en medewerkers uitnodigen om eraan te werken. Het aantal medewerkers per model is beperkt tot 3 voor het Pro-plan en 5 voor het Max-plan, wat effectieve samenwerking binnen het platform mogelijk maakt.

Omgevingsvariabelen voor Ollama kunnen worden geconfigureerd afhankelijk van je besturingssysteem. Bijvoorbeeld, op macOS gebruik je 'launchctl' om variabelen in te stellen, terwijl je op Linux de systemd-service zou aanpassen. Voor Windows kun je systeemomgevingsvariabelen wijzigen via het Configuratiescherm. Gedetailleerde stappen zijn beschikbaar in de configuratiedocumentatie.

Ollama neemt gegevensbeveiliging serieus. Het logt of slaat geen enkele prompt- of responsgegevens op, en alle cloudverzoeken zijn versleuteld tijdens verzending. Dit zorgt ervoor dat uw gegevensprivacy behouden blijft en dat u modellen lokaal kunt uitvoeren zonder informatie naar externe servers te verzenden.