Thinkless

Kader voor LLM's om redenering te optimaliseren door de responscomplexiteit aan te passen op basis van taakvereisten.

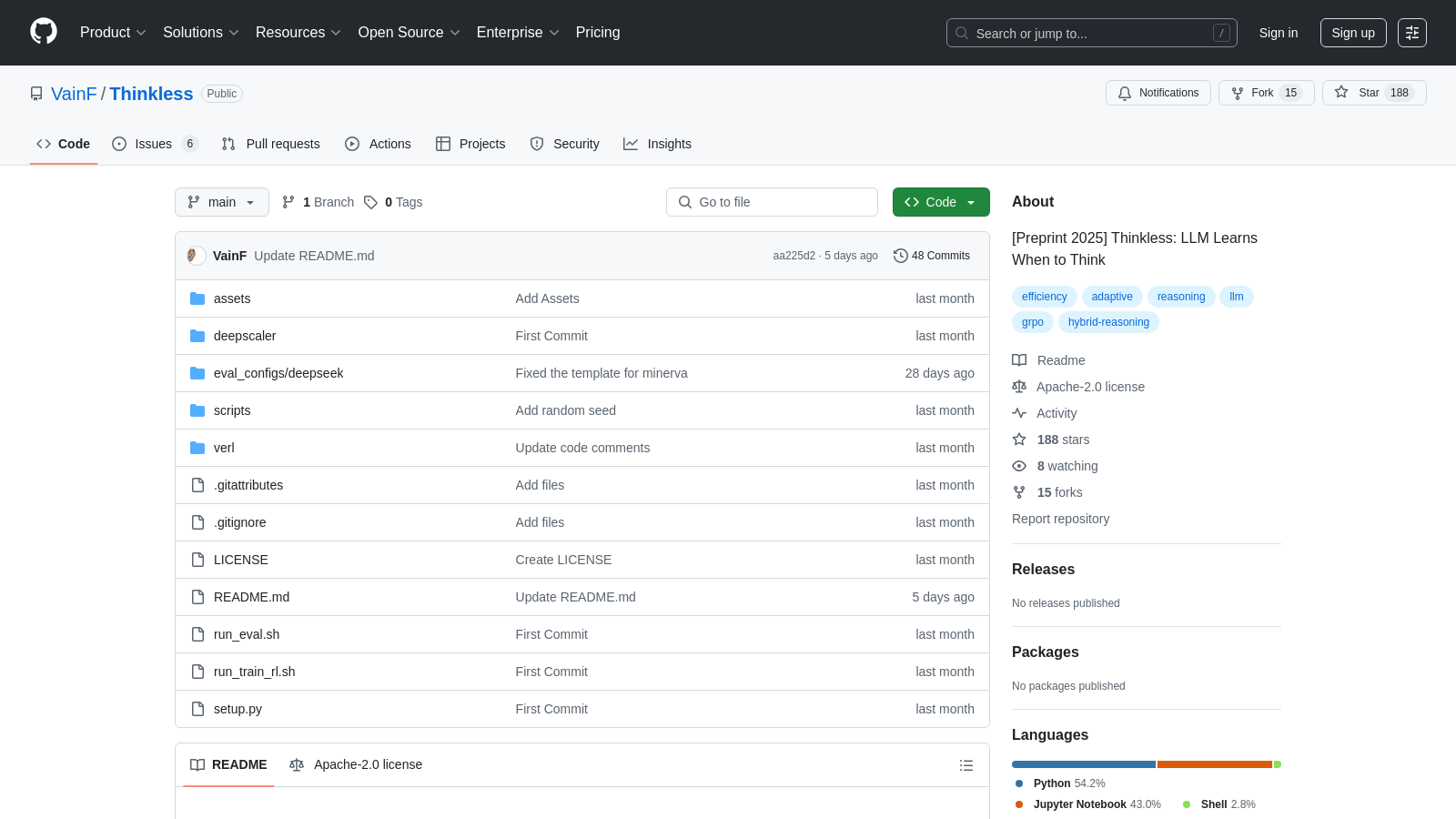

Github.comVolg voor updates & aanbiedingen

Ontvang meldingen voor Thinkless kortingen, nieuwe functies & prijswijzigingen

Vergelijkbare Tools

Wat is Thinkless?

Thinkless is een innovatief raamwerk dat is ontworpen voor grote taalmodellen (LLM's) om te leren wanneer ze kritisch moeten nadenken voordat ze antwoorden genereren. Door gebruik te maken van een uniek trainingsparadigma gebaseerd op versterkend leren, heeft Thinkless als doel de redenering in grote taalmodellen (LLM's) te optimaliseren, waardoor ze kunnen kiezen tussen korte en lange antwoorden op basis van de complexiteit van taken. Onlangs zijn er aanzienlijke verbeteringen aan het raamwerk aangebracht, waardoor het zijn positie als een leidende oplossing voor adaptieve redenering in LLM's heeft versterkt.

De kerninnovatie van Thinkless ligt in het verfijnde gebruik van het Decoupled Group Relative Policy Optimization (DeGRPO) algoritme. Deze geavanceerde benadering scheidt strategisch de leerdoelen in twee verschillende componenten: de ene supervisieert de keuze van het redeneringsmode via een controle-token verlies, terwijl de andere de nauwkeurigheid van gegenereerde antwoorden verbetert via responsverlies. Deze zorgvuldige scheiding stabiliseert niet alleen het trainingsproces, maar minimaliseert ook de rekentijd die gepaard gaat met LLM-redenering, waardoor efficiëntere operaties mogelijk zijn. Bovendien zijn verbeteringen in het algoritme aangebracht om het vermogen om training te stabiliseren te verbeteren en de prestatie-inzakking te voorkomen die vaak wordt gezien in naïeve implementaties van soortgelijke methoden.

Hoe Het Werkt

Het hart van het Thinkless-raamwerk bestaat uit twee belangrijke controle-tokens:

Belangrijkste Kenmerken

- Adaptieve Redenering: Thinkless past de generatie van antwoorden aan op basis van de taakcomplexiteit en de capaciteiten van het model, waardoor het zeer veelzijdig is.

- Verbeterde Efficiëntie: Het raamwerk vermindert aanzienlijk de noodzaak voor uitgebreide redeneringspaden, wat samenhangt met prestatieverbeteringen in verschillende benchmarktests, waarbij de vereisten voor lang-chain denken met 50-90% zijn verminderd.

- Versterkend Leren Benadering: Thinkless maakt gebruik van een versterkend leren raamwerk dat niet alleen bijdraagt aan een beter begrip van taakcomplexiteit, maar ook voorspelt wanneer diepere redenering noodzakelijk is.

- Empirische Resultaten: De laatste iteraties van het raamwerk hebben superieure resultaten aangetoond in empirische tests, wat de innovatieve benadering van LLM-training en redenering verder valideert.

Installatie en Gebruik

Het opzetten van Thinkless is eenvoudig en kan direct binnen een conda-omgeving worden uitgevoerd. Het installatieproces omvat het instellen van Python-afhankelijkheden, het downloaden van relevante modelcomponenten uit de officiële repository en het gebruiken van een eenvoudig opdrachtregelproces om de training te starten. Gebruikers worden door de setup geleid met gedetailleerde documentatie die in de repository te vinden is, wat de onboarding-ervaring verbetert en opstellingsambiguïteiten elimineert.

Conclusie

Samengevat belichaamt Thinkless een vooruitstrevend hulpmiddel dat herdefinieert hoe LLM's omgaan met complexe redeneringstaken, waarmee het de computationele efficiëntie en de nauwkeurigheid van antwoorden aanzienlijk bevordert. Door gebruik te maken van het innovatieve ontwerp en praktische toepassingen in de echte wereld, is Thinkless een cruciale bron voor zowel onderzoekers als beoefenaars in het snel evoluerende veld van kunstmatige intelligentie. De betrokkenheid bij de voortdurende ontwikkeling zorgt ervoor dat het niet alleen voldoet aan de huidige eisen, maar ook zich aanpast aan toekomstige behoeften op het gebied van grote taalmodellen en geavanceerde redenering.

Voor- en nadelen

Voordelen

- Past adaptief redeneren toe om de efficiëntie bij taakuitvoering te verbeteren.

- Maakt gebruik van een uniek reinforcement learning-model met dubbele besturings-tokens.

- Vermindert aanzienlijk het gebruik van lange ketenredenering, waardoor de rekeningssnelheid wordt verbeterd.

Veelgestelde Vragen

Thinkless is open source en gratis te gebruiken.

Volgens onze laatste informatie lijkt deze tool op dit moment helaas geen levenslange deal te hebben.

Het DeGRPO-algoritme staat centraal in het Thinkless-framework. Het decomprimeert het leerdoel van hybride redenering in twee afzonderlijke componenten: een controle token verlies en een responsverlies. Deze scheiding maakt een fijne controle mogelijk over de bijdragen van elk doel tijdens de training. Het controle token verlies bepaalt hoe het model kiest tussen kortdurende en langdurige redenering, terwijl het responsverlies de nauwkeurigheid van de gegenereerde antwoorden verbetert. Door de training te stabiliseren en instorting te voorkomen, verbetert DeGRPO de prestaties aanzienlijk op verschillende redeneringsbenchmarks.

Thinkless verbetert de computationele efficiëntie door taalmodellen in staat te stellen om adaptief te kiezen tussen kortetermijn- en langetermijnredenering, afhankelijk van de complexiteit van de taak en de mogelijkheden van het model. Door de noodzaak voor langlopende redeneringen met 50% tot 90% te verminderen, minimaliseert Thinkless het hulpbronnenverbruik tijdens de inferentie, terwijl de nauwkeurigheid van de uitkomsten behouden blijft of zelfs verbeterd wordt. Dit maakt het efficiënter dan traditionele redeneringsmethoden in grote taalmodellen.

Om Thinkless te installeren, moet je een omgeving creëren met Python 3.10 en de benodigde afhankelijkheden. Gebruik specifiek Conda om een nieuwe omgeving aan te maken en installeer pakketten zoals PyTorch, LM_eval en Ray. Voor CUDA-ondersteuning, zorg ervoor dat je de bijbehorende versie van NVIDIA CUDA installeert. Gedetailleerde installatieopdrachten zijn te vinden in de README van het project op GitHub. Zorg ervoor dat je de documentatie raadpleegt voor eventuele aanvullende vereisten op basis van jouw systeemconfiguratie.

Ja, Thinkless is ontworpen om te integreren met populaire machine learning frameworks, zoals PyTorch, zoals aangegeven door de installatie van het torch-pakket als afhankelijkheid. Aangezien het is gebouwd met standaardtools, kunnen gebruikers het interface met andere bibliotheken en frameworks voor taken zoals gegevensverwerking en extra modeltraining. Gebruikers kunnen de installatie- en gebruiksinstructies in de GitHub-repository raadplegen voor een beter begrip van de integratie.

Om snel te beginnen met Thinkless, moet je eerst je programmeeromgeving instellen met de vereiste Python-versie en bibliotheken. Nadat je je Conda-omgeving hebt geactiveerd, kun je de AutoModelForCausalLM en AutoTokenizer importeren uit de transformers-bibliotheek. Vanaf daar laad je het Thinkless-model en bereid je je invoerprompts voor redenering voor. De documentatie van het project bevat voorbeeldcodefragmenten om je te helpen bij het genereren van antwoorden en het effectief evalueren van modeluitvoer.

Je kunt de prestaties van het Thinkless-model evalueren met de evaluatiescripts die in de repository zijn opgenomen, waarmee je meerdere inferentie-herhalingen kunt uitvoeren. Dit helpt om resultaten voor verschillende taken en metrics te verzamelen. De evaluatietool is gebaseerd op prompts in OpenAI/simple-evals, en je kunt evaluatiecommando's uitvoeren om metrics te genereren uit de resultaten die zijn opgeslagen in calcs, zoals nauwkeurigheid en responskwaliteit, die helpen om de mogelijkheden van het model te begrijpen.

Hoewel Thinkless de efficiëntie bij redeneertaken aanzienlijk verbetert, zijn er mogelijke beperkingen, zoals een afhankelijkheid van de kwaliteit van het initiële model en de kwaliteit van de trainingdata. Het algoritme presteert mogelijk ook niet optimaal bij specifieke, zeer complexe redeneertaken die een diep begrip van de context vereisen. Bovendien kunnen het fijnstemmen van hyperparameters zoals thinkless_alpha en correct_think_reward experimenteel zijn om de beste resultaten te bereiken, wat tijdrovend kan zijn.

Voor het verfijnen van Thinkless kun je beginnen met het aanpassen van de hyperparameters, zoals thinkless_alpha en correct_think_reward. Als de convergentie traag is of als het model neigt naar een specifieke redeneerwijze, overweeg dan om deze parameters geleidelijk te verhogen om de prestaties te verbeteren. Experimenteren met verschillende trainingsdatasets en technieken die in de documentatie van het project zijn beschreven, kan ook helpen om de prestaties te optimaliseren op basis van jouw specifieke gebruiksgeval.