Volg voor updates & aanbiedingen

Ontvang meldingen voor vui kortingen, nieuwe functies & prijswijzigingen

Vergelijkbare Tools

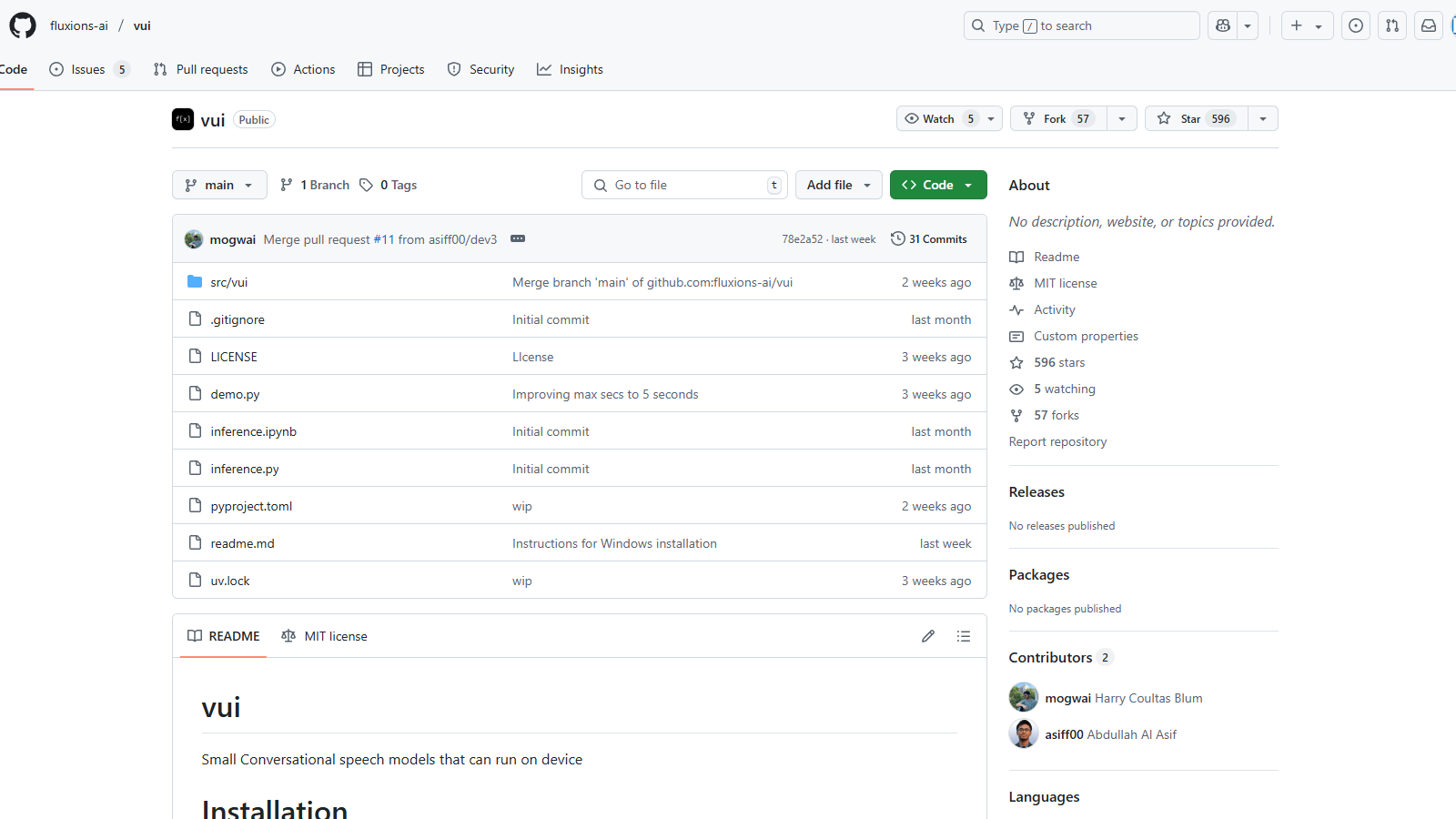

Wat is vui?

VUI is een innovatief hulpmiddel dat zich richt op conversatie spraakmodellen die zijn ontworpen om direct op apparaten te werken, en biedt een efficiënt en gebruiksvriendelijk oplossing voor spraakgerelateerde taken. De primaire modellen in de VUI-toolkit zijn getraind op uitgebreide datasets, waardoor ze audio effectief kunnen verwerken en contextueel relevante antwoorden kunnen geven.

Bijgewerkte Sleutelkenmerken:

- Meerdere Modellen: Vui biedt een verscheidenheid aan modellen, waaronder Vui.BASE, Vui.ABRAHAM, en Vui.COHOST, elk geoptimaliseerd voor verschillende soorten conversatie-interacties. Vui.BASE is specifiek getraind op 40.000 uur audio-conversaties, wat een robuuste basis biedt voor verschillende toepassingen.

- Stemkloning: Gebruikers kunnen de modellen gebruiken voor stemkloningsmogelijkheden, waarmee ze stemmen met redelijke nauwkeurigheid kunnen repliceren op basis van de voorgetrainde datasets. De mogelijkheid om stemmen te klonen is verbeterd, maar het wordt opgemerkt dat de resultaten mogelijk niet perfect zijn vanwege beperkingen in de trainingsgegevens.

- Efficiëntie: De modellen zijn ontworpen om effectief op apparaten te functioneren zonder uitgebreide cloudbronnen nodig te hebben, waardoor ze ideaal zijn voor toepassingen die lagere latentie en hoge responsiviteit vereisen. De VUI-modellen maken gebruik van een op llama gebaseerde transformer die audio-tokens voorspelt, en tonen vooruitgangen in modelarchitectuur die hun operationele efficiëntie verbeteren.

- Audio-tokenisatie: Een belangrijke functie is de fluac audio-tokenizer, die effectief het aantal codes per seconde vermindert, waardoor de algehele verwerkingssnelheid van 83,1 Hz naar 21,53 Hz wordt verbeterd.

Installatie en Gebruik:

Om VUI te beginnen gebruiken, kunnen gebruikers het eenvoudig installeren via een pakketbeheerder met het commando pip install -e .. Het installatieproces is eenvoudig, en een demo kan worden uitgevoerd door python demo.py uit te voeren. Deze flexibiliteit stelt ontwikkelaars in staat om de modellen in verschillende toepassingen toe te passen, waardoor de gebruikerservaringen worden verbeterd met naadloze spraakherkenning en generatiefuncties.

Uitdagingen en Overwegingen:

Hoewel de modellen indrukwekkende mogelijkheden tonen, zijn ze niet zonder beperkingen. Gebruikers kunnen enkele eigenaardigheden ervaren, zoals incidentele hallucinaties, die optreden wanneer de AI antwoorden genereert die niet gebaseerd zijn op zijn trainingsgegevens. Deze realiteit wordt erkend door het ontwikkelingsteam terwijl ze zich inspannen voor voortdurende verbetering en betrokkenheid van de gemeenschap.

Ondanks deze uitdagingen vertegenwoordigen VUI-modellen een significante vooruitgang in conversational AI, vooral voor projecten die gericht zijn op het verbeteren van interactiviteit via stem. Het ontwikkelingsteam benadrukt voortdurende verbetering, het delen van inzichten en het aanpakken van problemen op basis van feedback van de gemeenschap. Deze toewijding aan ontwikkeling wordt ondersteund door het gebruik van geavanceerde technologieën en samenwerkingsinspanningen met andere open-sourceprojecten.

Erkenningen:

De ontwikkeling van VUI erkent bijdragen van verschillende open-sourceprojecten, waaronder Whisper van OpenAI en Audiocraft van Facebook Research, waarmee een gemeenschappelijke inspanning wordt getoond om robuuste tools voor spraakverwerking te bouwen. Door deze samenwerkingen verbetert VUI zijn aanbod en behoudt het zijn relevantie in het snel evoluerende gebied van audioverwerkingstechnologie.

Voor- en nadelen

Voordelen

- Biedt kleine conversatiespeechmodellen die op het apparaat kunnen draaien zonder cloudondersteuning nodig te hebben.

- Bevat contextbewuste modellen voor één spreker en twee sprekers voor veelzijdige toepassingen.

- Maakt gebruik van een op llama gebaseerde transformer voor audio token voorspelling, wat de prestaties verbetert.

Nadelen

- Stemkloning is niet perfect vanwege beperkte trainingsgegevens en middelen.

Veelgestelde Vragen

vui is open source en gratis te gebruiken.

Volgens onze laatste informatie lijkt deze tool op dit moment helaas geen levenslange deal te hebben.

{toolName} biedt drie primaire modellen: Vui.BASE, dat is het basischeckpoint getraind op 40k uur aan audio gesprekken; Vui.ABRAHAM, ontworpen als een enkelsprekermodel dat in staat is tot contextbewuste antwoorden, en Vui.COHOST dat communicatie tussen twee sprekers mogelijk maakt. Deze modellen dienen verschillende gebruiksscenario's, variërend van fundamentele conversatie-interacties tot complexe dialogen tussen meerdere partijen.

Ja, je kunt {toolName} lokaal draaien. Om het te installeren, gebruik je de pip-opdracht met de volgende syntaxis: 'pip install -e .'. Dit zal de tool in bewerkbare modus installeren. Zorg ervoor dat je Python op je apparaat hebt geïnstalleerd voor de setup. Volg de README-documentatie in de repository voor gedetailleerde stappen en vereisten.

{toolName} biedt mogelijkheden voor stemklonen, maar het is belangrijk op te merken dat het basismodel mogelijk niet perfecte resultaten oplevert vanwege een beperkte trainingsdataset. Het model heeft niet veel audio-invoer ontvangen, wat leidt tot inconsistenties bij het klonen van specifieke stemmen. Gebruikers moeten hun verwachtingen beheersen en dit aspect in overweging nemen bij het gebruik van de stemklonfunctie.

{toolName} maakt gebruik van een robuuste audio-tokenisatietechniek, ontwikkeld in samenwerking met Fluac, die is gebaseerd op de Descript-Audio-Codec. Dit vermindert het aantal verwerkte audiocodes significant, van 83,1 Hz naar 21,53 Hz, waardoor efficiënter gegevensbeheer tijdens de audiobewerking mogelijk is. Deze verbetering maakt snellere en nauwkeurigere stemvoorspellingen mogelijk.

Voor optimale prestaties wordt {toolName} het best uitgevoerd op high-performance hardware, specifiek opstellingen uitgerust met NVIDIA 4090 GPU's, zoals aangegeven door de ontwikkelaar. Het gebruik van dergelijke krachtige hardware verkort de verwerkingstijd en verbetert de mogelijkheid van het model om intensieve audio-operaties uit te voeren.

Ja, {toolName} ervaart wel degelijk hallucinations, waarbij de output mogelijk niet overeenkomt met de werkelijkheid. Dit is een veelvoorkomende uitdaging in de prestaties van AI-modellen, vooral wanneer ze worden getraind met beperkte middelen. Gebruikers moeten hiervan op de hoogte zijn en de nauwkeurigheid van kritieke output verifiëren.

{toolName} integreren met andere tools, zoals Whisper en Audiocraft, kan de mogelijkheden ervan uitbreiden. Whisper helpt bij krachtige spraakherkenning, terwijl Audiocraft de audiobewerkingsfuncties kan verbeteren. Het verkennen van deze samenwerkingen kan de gebruikerservaring en functionaliteit van {toolName} aanzienlijk verhogen.

{toolName} is gehost op GitHub, waar gebruikers communityondersteuning kunnen vinden via issues en discussies. Voor gedetailleerde gebruiksaanwijzingen kunnen gebruikers de README-documentatie in de repository raadplegen. Deelnemen aan de community kan ook waardevolle tips en inzichten voor probleemoplossing van andere gebruikers opleveren.