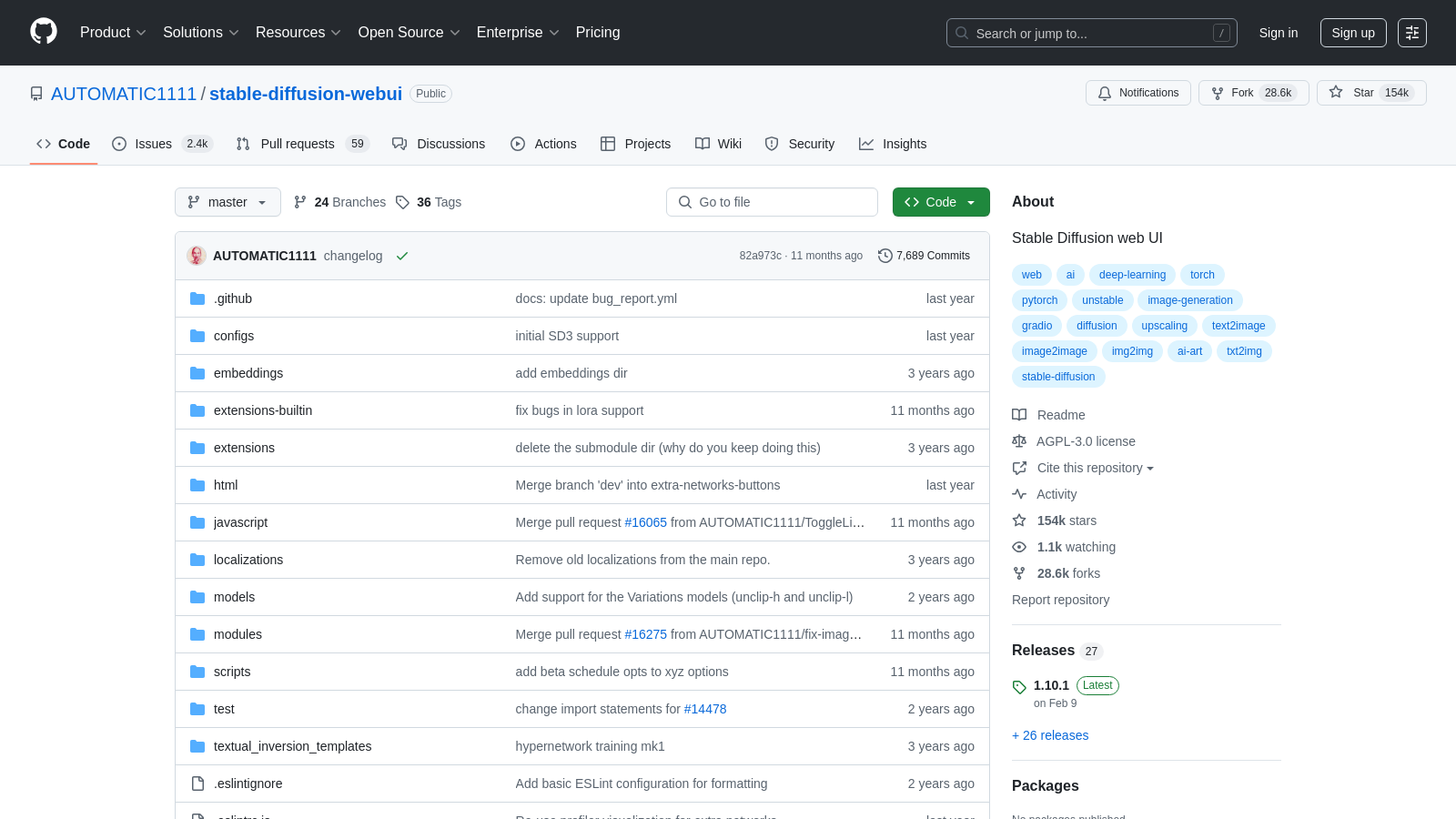

Automatic1111 - Stable Diffusion web UI

Interface web interativa para gerar imagens com o Stable Diffusion usando o framework Gradio.

Github.comSiga para atualizações e ofertas

Receba alertas sobre descontos, lançamentos de recursos e mudanças de preços do Automatic1111 - Stable Diffusion web UI

Ferramentas Similares

O que é Automatic1111 - Stable Diffusion web UI?

A Stable Diffusion Web UI oferece uma interface de navegador completa para Stable Diffusion baseada na biblioteca Gradio. Esta plataforma intuitiva funciona como uma ponte, fornecendo uma interface interativa para uma tecnologia geralmente reservada àqueles com conhecimento técnico avançado. Seu design amigável garante que até mesmo os menos familiarizados com tecnologia de IA possam aproveitar ao máximo as capacidades do Stable Diffusion.

A ferramenta possui uma infinidade de recursos, aprimorando a experiência do usuário e oferecendo versatilidade. Ela suporta modos de texto para imagem e imagem para imagem, e uma instalação com um clique torna o processo de configuração muito fácil, embora as instalações do Python e do Git sejam pré-requisitos. Para os que desejam explorar a manipulação de imagens mais a fundo, recursos como outpainting, inpainting e esboço de cores são incrivelmente úteis. O mecanismo de atenção permite que os usuários especifiquem partes do texto nas quais o modelo deve se concentrar, tornando a saída mais precisa. Notavelmente, um recurso inovador de Loopback permite o processamento repetido de img2img, enquanto o gráfico X/Y/Z fornece uma forma única de visualizar imagens com parâmetros variados. Além disso, a plataforma suporta vários upscalers de rede neural, como GFPGAN, RealESRGAN, ESRGAN, SwinIR e Swin2SR. A flexibilidade está em destaque com opções para interromper o processamento, suporte a várias capacidades de placa de vídeo e parâmetros de geração ajustáveis.

O design intuitivo da Stable Diffusion Web UI se estende aos elementos da interface do usuário. Uma aba de extras útil inclui ferramentas como CodeFormer, uma ferramenta de restauração facial, e LDSR para upscaling de super-resolução de difusão latente. A página de configurações é não apenas abrangente, mas centrada no usuário, oferecendo dicas ao passar o mouse sobre os elementos da interface e flexibilidade na alteração de valores padrão. Melhorias como uma visualização de geração de imagem ao vivo, barra de progresso e a capacidade de reorganizar elementos na interface tornam a experiência do usuário perfeitamente integrada. Um recurso destacado é o suporte a mosaicos, permitindo que os usuários criem imagens com texturas, garantindo versatilidade nos resultados de design.

Para aqueles que buscam um guia de instalação, a plataforma oferece instruções detalhadas para vários sistemas, do Windows 10/11 ao Linux e até mesmo Apple Silicon. Opções de serviço online, como Google Colab, também estão disponíveis, fornecendo flexibilidade com base nas preferências do usuário. Além disso, as contribuições da comunidade são incentivadas, e uma seção de documentação dedicada garante que os usuários tenham todos os recursos de que precisam. A página "Recursos" oferece uma visão aprofundada das capacidades da Stable Diffusion web UI, enquanto seções dedicadas para downloads e modelos orientam os usuários sobre como aproveitar a tecnologia de maneira ideal. A integração de ferramentas avançadas como Hypernetworks, LoRA, Alt-Diffusion e Inpainting Model SD2 ressalta o comprometimento da plataforma em se manter na vanguarda da tecnologia de manipulação de imagem alimentada por IA.

Em conclusão, a Stable Diffusion Web UI é uma plataforma de ponta que consegue unir a complexa tecnologia de IA com usuários do dia a dia. Sua lista abrangente de recursos, combinada com um design intuitivo, a posiciona como uma ferramenta essencial para qualquer um que deseja explorar as vastas possibilidades da manipulação de imagem impulsionada por IA.

Prós e Contras

Prós

- Oferece uma ampla gama de recursos de geração de imagens, incluindo outpainting e inpainting.

- Suporta scripts personalizados e extensões da comunidade para funcionalidade aprimorada.

- Permite edições interativas de prompts durante a geração de imagens para mais flexibilidade.

Contras

- Requer uma instalação adequada do Python e do Git, o que pode desmotivar iniciantes.

Perguntas Frequentes

Automatic1111 - Stable Diffusion web UI está disponível sem custo.

Esta ferramenta oferece um plano vitalício.

{toolName} suporta várias integrações e extensões para aprimorar as capacidades de geração de imagens. Isso inclui ferramentas como GFPGAN para restauração de faces, CodeFormer como alternativa, RealESRGAN para ampliação, e opções adicionais de redes neurais, incluindo SwinIR e LDSP. A API também permite modelos de inpainting dedicados através de extensões, tornando-a flexível para diversos casos de uso.

{toolName} foi relatado como funcionando com placas de vídeo de 4GB e, em alguns casos, até mesmo com placas de 2 GB. Ele inclui recursos como validação ao vivo da extensão do token do prompt e suporta configurações avançadas de ruído, que ajudam a otimizar o desempenho em hardware de menor capacidade. Os usuários devem garantir que atendem às dependências necessárias, especialmente se estiverem rodando em sistemas com processadores gráficos da NVIDIA, AMD ou Intel.

{toolName} permite que os usuários personalizem prompts com opções como inversão textual, especificação de atenção e prompting negativo. Você pode ajustar partes do texto para influenciar os elementos na imagem gerada e usar embutidos ou Loras únicos para experimentar diferentes estilos. Além disso, o recurso de difusão compostável permite o uso de múltiplos prompts com pesos especificados.

Para instalar {toolName} no Windows, primeiro certifique-se de que você tem o Python 3.10.6 instalado (note que versões mais recentes podem não ser compatíveis). Em seguida, instale o Git. Baixe o repositório stable-diffusion-webui usando o comando `git clone https://github.com/AUTOMATIC1111/stable-diffusion-webui.git`. Por último, execute o arquivo `webui-user.bat` a partir do Windows Explorer como um usuário comum para iniciar a interface.

Sim, usar a extensão xformers pode acelerar significativamente a geração de imagens em placas de vídeo compatíveis. Além disso, aproveitar as otimizações de GPU e o processamento em lote pode agilizar o fluxo de trabalho. Recomendações incluem ajustar os valores ETA do sampler e experimentar diferentes métodos de amostragem para reduzir os tempos de processamento.

Para solucionar erros no {toolName}, os usuários podem começar verificando a página de problemas no GitHub para relatórios semelhantes e possíveis soluções. Além disso, explorar as discussões da comunidade ou fóruns relacionados à ferramenta pode fornecer insights. Se o problema persistir, considere enviar um relato de erro com informações detalhadas para o repositório GitHub do projeto.

Com certeza! O {toolName} suporta múltiplos prompts através do método de difusão composicional. Você pode facilmente combinar diferentes prompts usando 'E' em maiúsculas para gerar uma variedade diversificada de imagens. A ferramenta também permite que você especifique pesos para cada prompt, dando a você um controle mais preciso sobre a influência de cada componente na saída final.

{toolName} oferece vários recursos de ajuste de imagem, incluindo outpainting, inpainting e redimensionamento. Você pode utilizar opções para correções em alta resolução e escolher entre várias técnicas de upscaling, como ESRGAN e RealESRGAN. O aplicativo também inclui configurações avançadas para gerenciamento de ruído e a capacidade de restaurar parâmetros de imagem para modificações fáceis.