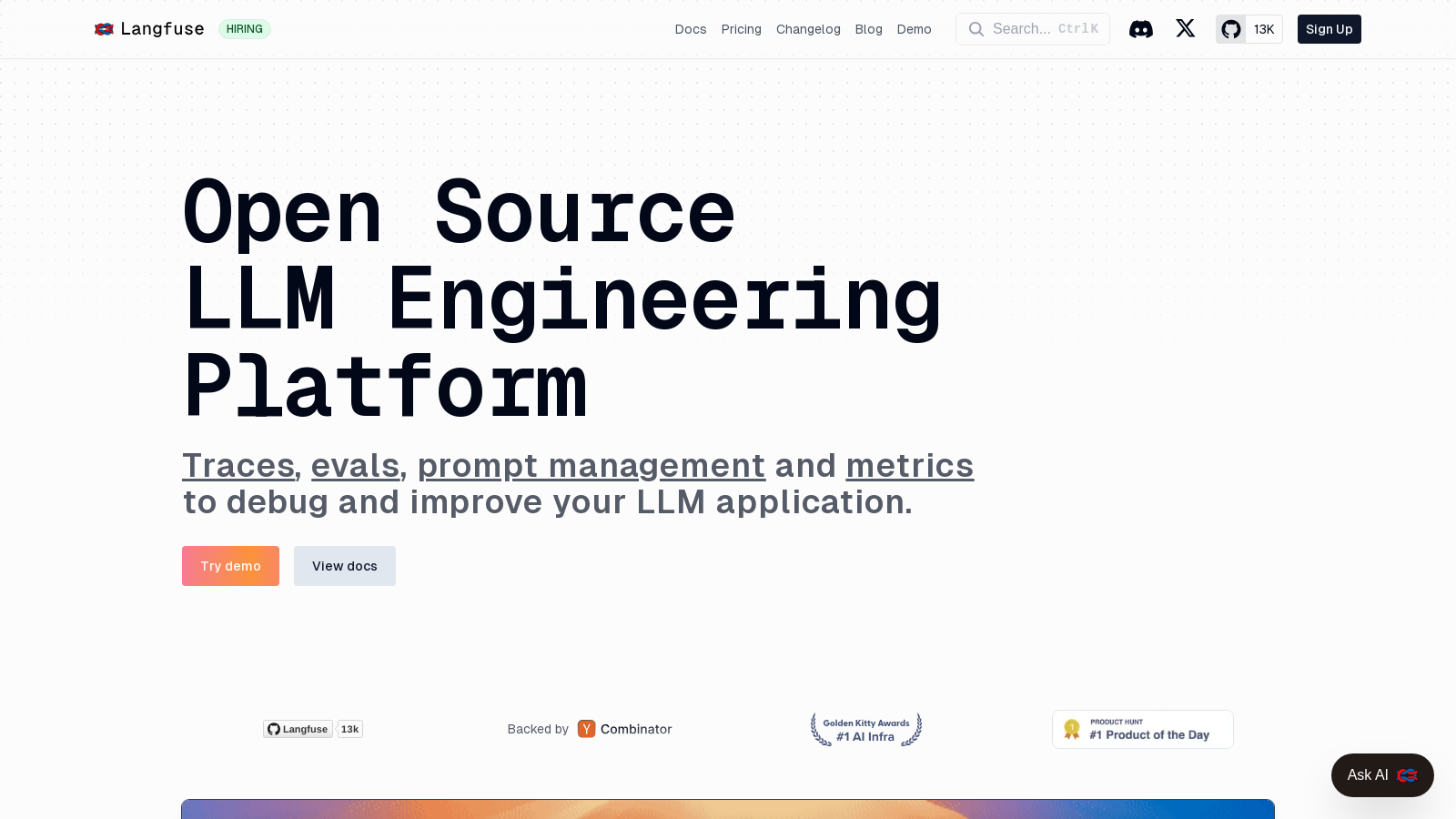

Langfuse

Uma plataforma de código aberto para desenvolver, depurar e monitorar aplicações de Modelos de Linguagem Grande.

Langfuse.comSiga para atualizações e ofertas

Receba alertas sobre descontos, lançamentos de recursos e mudanças de preços do Langfuse

Ferramentas Similares

O que é Langfuse?

Langfuse é uma plataforma de código aberto projetada para ajudar equipes a desenvolver, monitorar e depurar suas aplicações de Modelos de Linguagem de Grande Escala (LLM) de forma eficiente. Esta abrangente plataforma de engenharia integra várias funcionalidades, incluindo rastreamento, gerenciamento de prompts, avaliação e análise, melhorando significativamente o fluxo de trabalho de desenvolvimento. Recentemente, a Langfuse deu um salto notável ao abraçar totalmente uma estratégia de código aberto; todos os recursos do produto agora estão disponíveis sob a licença MIT. Essa mudança não apenas democratiza o acesso a capacidades de ponta para desenvolvedores em todo o mundo, mas também fomenta a colaboração e o feedback da comunidade.

Rastreamento de LLM

No cerne das capacidades da Langfuse está seu robusto recurso de rastreamento de LLM. Essa funcionalidade permite que os desenvolvedores capturem rastros de produção detalhados de suas aplicações LLM, simplificando o processo de depuração e tornando as otimizações mais simples. Ao registrar cada chamada de LLM juntamente com a lógica associada, as equipes podem obter insights vitais relacionados a desempenho, latência e custo. A integração de rastreamento vai muito além de um simples registro; ela suporta frameworks como LangChain e OpenTelemetry, oferecendo assistência robusta para aplicações em múltiplas camadas, o que é vital para casos de uso em produção.

Gerenciamento de Prompts

Outra funcionalidade distinta da Langfuse é seu sistema de gerenciamento de prompts, permitindo que as equipes gerenciem e versionem prompts de forma colaborativa e eficaz. Isso garante implantações ideais de iterações de alto desempenho. Aproveitando a interface do usuário da Langfuse, os desenvolvedores podem testar e ajustar prompts em tempo real. Além disso, o playground dedicado recentemente adicionado facilita o teste direto e a comparação de prompts e modelos, otimizando assim o processo de otimização em vários cenários.

Ferramentas de Avaliação

O feedback do usuário é uma pedra angular para qualquer aplicação bem-sucedida, e, portanto, a Langfuse fornece recursos dedicados para esse propósito. Os usuários podem contribuir com feedback de forma contínua dentro da aplicação, reforçando o ecossistema de avaliação. Métodos recém-introduzidos, incluindo avaliações de LLM como um juiz e fluxos de trabalho de anotação manual, garantem capacidades de teste versáteis para modelos e prompts, assegurando assim saídas de alta qualidade derivadas de interações reais dos usuários.

Análises e Métricas

Equipado com um conjunto abrangente de métricas, a Langfuse permite que as equipes de desenvolvimento monitorem efetivamente indicadores essenciais de desempenho, que incluem custo, latência e satisfação do usuário. Melhorias recentes, particularmente o lançamento de uma Métricas API flexível, permitem aos usuários criar relatórios e dashboards personalizados com dimensões ajustáveis e granularidade de tempo. Essa abordagem orientada por dados apoia processos de tomada de decisão bem informados quando se trata de refinar aplicações.

Auto-Hospedagem e Código Aberto

O compromisso da Langfuse em ser uma plataforma de código aberto significa que pode ser auto-hospedada, concedendo às organizações total controle sobre seus dados e infraestrutura. Essa capacidade é particularmente crucial para equipes que operam em indústrias regulamentadas, onde a privacidade dos dados é de extrema importância. Todo o código-fonte permanece acessível e, com um amplo suporte da comunidade, a Langfuse é continuamente aprimorada com base no feedback dos usuários, garantindo que atenda às demandas tecnológicas em evolução.

Integrações de API

Projetada com a integração em primeiro plano, a Langfuse oferece uma ampla gama de SDKs tanto para Python quanto para JavaScript, juntamente com integrações perfeitas para bibliotecas proeminentes como LangChain, OpenTelemetry e muitas outras. Essa compatibilidade extensa permite que os desenvolvedores integrem a Langfuse em seus fluxos de trabalho existentes de maneira simples. Com sua arquitetura orientada a API, cada recurso é disponibilizado via API, abrindo caminho para integrações personalizadas sem esforço.

Comunidade e Suporte

A Langfuse conta com uma comunidade em rápida expansão, que cultiva um espírito de colaboração e apoio entre os desenvolvedores. Por meio de plataformas como GitHub Discussions, os usuários podem se engajar ativamente, relatar problemas e trabalhar juntos em melhorias de recursos. O suporte da comunidade está prontamente acessível através do Discord e GitHub, complementado por documentação abrangente projetada para ajudar os novatos. À medida que o ecossistema Langfuse evolui, o feedback dos usuários permanece integral ao seu aprimoramento contínuo e alinhamento com as necessidades do mundo real.

Com sua ética de código aberto e comunidade dedicada, a Langfuse se destaca como um ator fundamental no domínio do LLMOps, atendendo equipes prontas para aproveitar modelos de linguagem grandes em seus fluxos de trabalho operacionais. À medida que o cenário de IA continua a se transformar, a Langfuse permanece comprometida em liderar os avanços na engenharia de LLM e observabilidade.

Prós e Contras

Prós

- O status de código aberto permite hospedagem própria e desenvolvimento orientado pela comunidade.

- Ferramentas abrangentes de rastreamento e observabilidade fornecem insights profundos sobre aplicações de LLM.

- A API flexível permite uma integração fácil com vários modelos e frameworks, aumentando a adaptabilidade.

Contras

- Alguns recursos avançados exigem uma licença e não estão incluídos na versão de código aberto.

- A configuração inicial complexa pode ser uma barreira para usuários menos técnicos.

Perguntas Frequentes

Langfuse é de código aberto e gratuito para usar.

De acordo com nossas informações mais recentes, esta ferramenta não parece ter uma oferta vitalícia no momento, infelizmente.

O Langfuse oferece integrações abrangentes com várias bibliotecas e plataformas populares, incluindo Langchain, OpenAI, LlamaIndex, LiteLLM e muitas outras. Além disso, fornece SDKs para Python e JavaScript/TypeScript, permitindo que os desenvolvedores incorporem o Langfuse em suas aplicações existentes de forma contínua. Para uma lista completa de integrações e bibliotecas, consulte a documentação oficial.

O Langfuse oferece ferramentas robustas de gerenciamento de prompts que permitem versionar e implantar prompts de forma colaborativa. Você pode organizar os prompts em pastas, testar diferentes versões diretamente na interface do Langfuse e otimizá-los com base no feedback dos usuários e nas métricas de desempenho. Esse recurso ajuda a garantir que você esteja sempre usando os prompts mais eficazes em suas aplicações de LLM.

O Langfuse inclui várias ferramentas de avaliação que são fundamentais para avaliar a qualidade das aplicações de LLM. Você pode coletar feedback dos usuários, usar o recurso LLM-como-julgador para avaliações e anotar resultados dentro do Langfuse. Além disso, você pode realizar avaliações sistemáticas em conjuntos de dados para garantir um desempenho consistente, ajudando a identificar problemas precocemente.

Para auto-hospedar o Langfuse, primeiro, assegure-se de que você tenha Docker ou Kubernetes configurado em sua infraestrutura. Siga o guia de auto-hospedagem disponível no site do Langfuse, que fornece instruções passo a passo para implantar o Langfuse em seus servidores. Você executará a mesma infraestrutura que alimenta o Langfuse Cloud, permitindo que você gerencie implantações de acordo com suas necessidades.

Sim, o Langfuse oferece uma API poderosa e aberta que lhe dá acesso a todos os seus recursos e dados. Esta API permite que você crie fluxos de trabalho personalizados, automatize tarefas e integre o Langfuse com outros aplicativos ou serviços de forma seamless. Você pode encontrar instruções detalhadas sobre como autenticar e usar a API na documentação.

O Langfuse está comprometido com a privacidade e segurança dos dados, em conformidade com o GDPR e com certificações como SOC 2 Tipo II e ISO 27001. A plataforma utiliza criptografia robusta, controles de acesso e auditorias de segurança regulares para proteger os dados dos usuários. Além disso, os usuários podem optar por hospedar o Langfuse em seus próprios servidores, mantendo controle total sobre seus dados e ambiente.

O Langfuse oferece recursos de rastreamento de métricas que permitem monitorar custos, latência e qualidade de suas aplicações de LLM. Você pode definir métricas e dimensões personalizadas por meio da Metrics API para obter insights sobre seus padrões de uso. Isso permite otimizar custos e melhorar o desempenho de suas aplicações.

O Langfuse oferece várias opções de suporte, incluindo suporte da comunidade através das Discussões do GitHub e do Discord, além de documentação abrangente para autoajuda. Para problemas que requerem atenção imediata, os usuários podem entrar em contato através do chat no aplicativo ou suporte por e-mail. Além disso, usuários nos planos Pro, Team ou Enterprise recebem suporte dedicado por meio de canais privados no Slack.