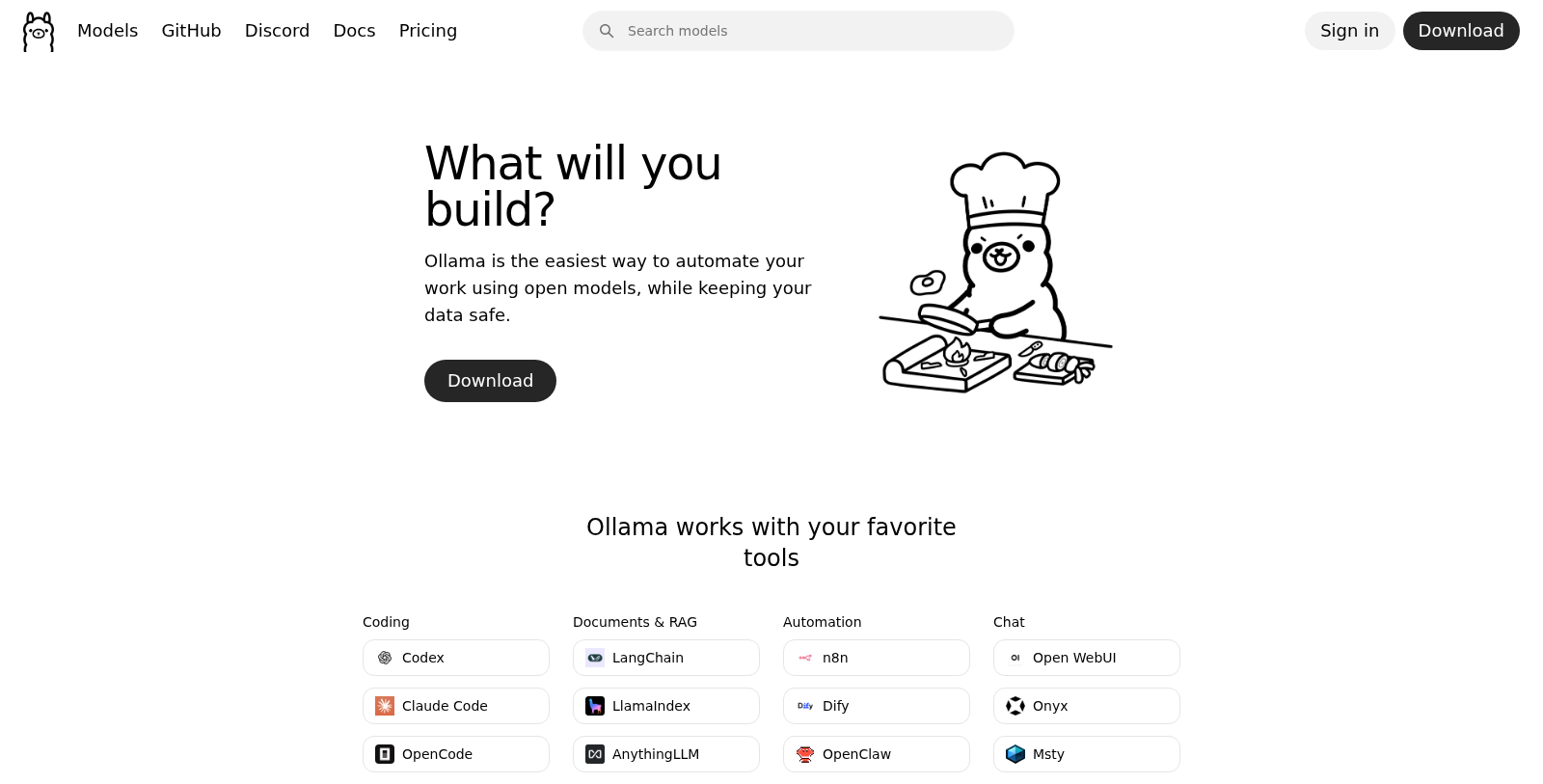

Ollama

Integre facilmente modelos de linguagem abertos para automatizar tarefas enquanto garante a privacidade dos dados.

Ollama.comSiga para atualizações e ofertas

Receba alertas sobre descontos, lançamentos de recursos e mudanças de preços do Ollama

Ferramentas Similares

O que é Ollama?

Ollama é uma ferramenta poderosa que simplifica a automação de trabalhos com grandes modelos de linguagem. Os usuários podem integrar facilmente seus modelos preferidos em várias aplicações, garantindo privacidade e eficiência dos dados.

A plataforma oferece três planos distintos adaptados a diferentes necessidades: Grátis, Pro e Max. O plano Grátis oferece integração e uso básicos, permitindo que os usuários automatizem tarefas sem custo. O plano Pro, com preço de $20 por mês, fornece recursos expandidos, incluindo a capacidade de executar múltiplos modelos na nuvem simultaneamente, uso aprimorado da nuvem, modelos privados e capacidades de colaboração. Para usuários que realizam tarefas mais pesadas, o plano Max está disponível por $100 por mês, permitindo um uso ainda mais extenso dos modelos na nuvem, colaboradores adicionais e recursos abrangentes de gestão de tarefas.

Um dos principais benefícios do Ollama é o compromisso com a privacidade dos dados. Os usuários podem executar tarefas em seu hardware local enquanto aproveitam as capacidades da nuvem para modelos maiores, garantindo que informações sensíveis permaneçam seguras.

O Ollama suporta uma ampla gama de integrações com ferramentas de codificação, análise de documentos e processos de automação, graças a mais de 40.000 integrações impulsionadas pela comunidade. Isso o torna adequado para várias aplicações, desde a automação de tarefas de codificação até a gestão da estrutura de documentos.

Modelos e Uso

Com Ollama, os usuários podem aproveitar vários modelos como gpt-oss, DeepSeek-R1 e outros em seus projetos. O design da plataforma acomoda um uso leve a pesado com base nas necessidades do usuário, com limites de uso adaptados a cada plano. Por exemplo, usuários Grátis recebem uso leve, adequado para interações fundamentais. Ao mesmo tempo, usuários Pro e Max ganham capacidades mais robustas, ideais para trabalho contínuo e tarefas intensivas em dados.

Comunidade e Suporte

O Ollama também promove uma comunidade vibrante onde os usuários podem se juntar a canais no Discord, participar de fóruns e acessar documentação extensa que os ajuda a maximizar o potencial da ferramenta e solucionar problemas. Bibliotecas comunitárias ainda enriquecem o ecossistema, permitindo que os usuários construam sobre capacidades existentes e compartilhem melhorias.

Recursos de Segurança

A segurança dos dados é primordial para o Ollama, pois a plataforma afirma explicitamente que não registra nenhum dado de prompt ou resposta durante o uso. Isso significa que informações sensíveis permanecem nos computadores locais, com os pedidos de modelos na nuvem criptografados em trânsito para maior segurança.

Planos Futuros

Olhando para o futuro, o Ollama planeja implementar recursos expandidos para uso em equipe e empresarial, ampliando sua acessibilidade para empresas que desejam empregar grandes modelos de linguagem em maior escala.

Em conclusão, Ollama é projetado tanto para desenvolvedores individuais quanto para organizações que buscam aproveitar o poder de grandes modelos de linguagem, garantindo que os dados permaneçam seguros. A estrutura de preços simplificada, combinada com uma comunidade robusta e opções de integração variadas, torna-o uma escolha atraente para quem deseja otimizar seus fluxos de trabalho com automação impulsionada por IA.

Prós e Contras

Prós

- Suporta a execução local de modelos, garantindo a privacidade dos dados.

- Integra-se a várias ferramentas, facilitando tarefas de automação flexível.

- Permite a personalização e o compartilhamento de modelos, aprimorando os fluxos de trabalho colaborativos.

Contras

- O uso do modelo em nuvem é limitado pelos níveis de assinatura para cargas de trabalho pesadas.

Perguntas Frequentes

Ollama é gratuito para começar, com planos pagos de 0 a 100 USD por mês.

De acordo com nossas informações mais recentes, esta ferramenta não parece ter uma oferta vitalícia no momento, infelizmente.

O Ollama é particularmente eficaz para automatizar tarefas como geração de código, análise de documentos e manipulação geral de dados usando grandes modelos de linguagem. Ele pode ser utilizado para desenvolver agentes de codificação, realizar análises rápidas de documentos e integrar-se perfeitamente com ferramentas de automação como n8n e Dify, permitindo fluxos de trabalho eficientes em diversos setores.

Sim! O Ollama foi projetado para operar completamente offline no seu próprio hardware, o que é ideal para ambientes isolados. As funcionalidades em nuvem são opcionais, permitindo que você mantenha seus dados privados enquanto utiliza grandes modelos de linguagem localmente.

O Ollama suporta vários modelos otimizados para tarefas de codificação. Notavelmente, o modelo glm-4.7-flash é recomendado para codificação, pois suporta funcionalidade de agente. Além disso, você pode usar ferramentas populares como Codex, Claude Code e OpenCode com o Ollama para aumentar a produtividade na codificação.

O Ollama permite que você pré-carregue modelos para alcançar tempos de resposta mais rápidos. Por padrão, os modelos permanecem na memória por 5 minutos antes de serem descarregados. Você pode gerenciar isso usando o parâmetro 'keep_alive' para especificar quanto tempo os modelos permanecem carregados, configurando diretamente as configurações do servidor Ollama. Isso é especialmente útil para otimizar o desempenho em cenários que exigem acesso rápido.

Os modelos em nuvem no Ollama incluem limites de idade que variam conforme o plano. Por exemplo, o plano gratuito suporta tarefas leves, como suporte por chat. Em contraste, o plano Pro suporta tarefas mais extensas, como análise de dados. O plano Max impõe limites de uso sobre cargas de trabalho, como agentes de codificação e processamento em lote.

Com certeza! Com uma assinatura, você cria modelos privados e convida colaboradores para trabalhar neles. O número de colaboradores por modelo é limitado a 3 para o plano Pro e 5 para o plano Max, permitindo um trabalho em equipe eficaz dentro da plataforma.

As variáveis de ambiente para o Ollama podem ser configuradas dependendo do seu sistema operacional. Por exemplo, no macOS, use 'launchctl' para definir as variáveis, enquanto no Linux, você deve ajustar o serviço systemd. Para Windows, você pode modificar as variáveis de ambiente do sistema através do Painel de Controle. Passos detalhados estão disponíveis na documentação de configuração.

A Ollama leva a segurança dos dados a sério. Ela não registra nem armazena nenhum dado de solicitação ou resposta, e todas as requisições na nuvem são criptografadas durante a transmissão. Isso garante que sua privacidade de dados seja mantida e que você possa executar modelos localmente sem enviar informações para servidores externos.