Thinkless

Estrutura para LLMs otimizar raciocínio, escolhendo a complexidade da resposta com base nas exigências da tarefa.

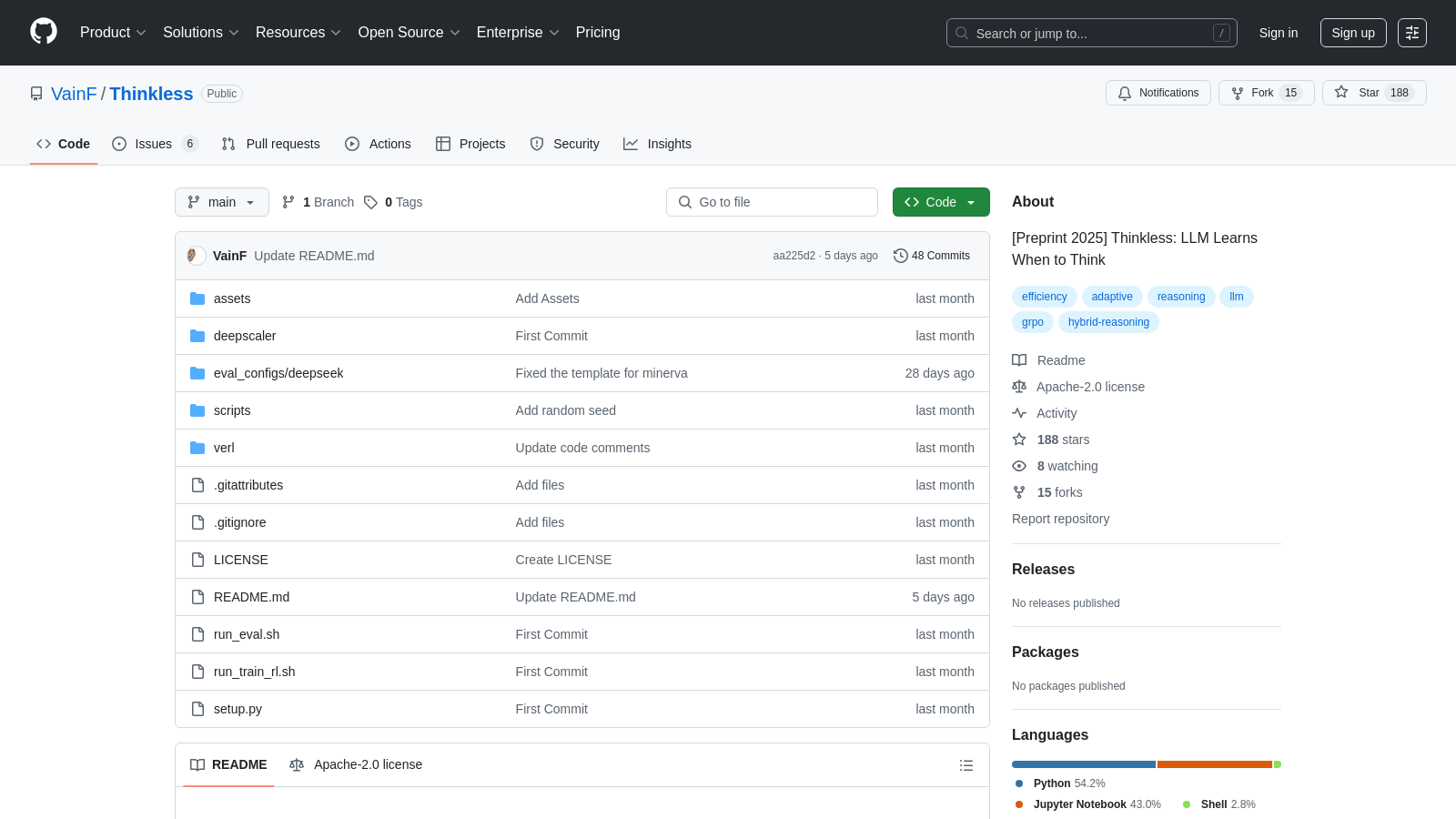

Github.comSiga para atualizações e ofertas

Receba alertas sobre descontos, lançamentos de recursos e mudanças de preços do Thinkless

Ferramentas Similares

O que é Thinkless?

Thinkless é uma estrutura inovadora projetada para grandes modelos de linguagem (LLMs) aprenderem quando pensar criticamente antes de gerar respostas. Ao utilizar um paradigma de treinamento único baseado em aprendizado por reforço, Thinkless tem como objetivo otimizar o raciocínio em grandes modelos de linguagem (LLMs), permitindo que escolham entre respostas curtas e longas com base na complexidade das tarefas. Recentemente, melhorias significativas foram feitas na estrutura, solidificando sua posição como uma solução líder para raciocínio adaptativo em LLMs.

A inovação central do Thinkless reside em seu uso sofisticado do algoritmo Decoupled Group Relative Policy Optimization (DeGRPO). Esta abordagem avançada separa estrategicamente os objetivos de aprendizado em dois componentes distintos: um supervisiona a escolha do modo de raciocínio através de uma perda de token de controle, enquanto o outro aumenta a precisão das respostas geradas por meio da perda de resposta. Essa separação meticulosa não apenas estabiliza o processo de treinamento, mas também minimiza a carga computacional associada ao raciocínio de LLM, facilitando operações mais eficientes. Além disso, melhorias no algoritmo foram feitas para aumentar sua capacidade de estabilizar o treinamento e prevenir o colapso de desempenho, que é frequentemente observado em implementações ingênuas de métodos semelhantes.

Como Funciona

O coração da estrutura Thinkless é composto por dois tokens de controle principais:

Características Principais

- Raciocínio Adaptativo: Thinkless ajusta sua geração de respostas de acordo com a complexidade da tarefa e as capacidades do modelo, tornando-se altamente versátil.

- Eficiência Aprimorada: A estrutura reduz significativamente a necessidade de caminhos de raciocínio extensos, o que se correlaciona com melhorias de desempenho em vários testes de benchmark, reduzindo os requisitos de pensamento em cadeia longa em 50-90%.

- Abordagem de Aprendizado por Reforço: Thinkless emprega uma estrutura de aprendizado por reforço que não apenas promove uma melhor compreensão da complexidade da tarefa, mas também prevê quando um raciocínio mais profundo é imperativo.

- Resultados Empíricos: As últimas iterações da estrutura demonstraram resultados superiores em testes empíricos, validando ainda mais sua abordagem inovadora para treinamento e raciocínio de LLM.

Instalação e Uso

Configurar o Thinkless é descomplicado e pode ser executado diretamente dentro de um ambiente conda. O processo de instalação abrange a configuração das dependências do Python, o download dos componentes relevantes do modelo do repositório oficial e a utilização de um simples processo de linha de comando para iniciar o treinamento. Os usuários são orientados durante a configuração com documentação detalhada encontrada dentro do repositório, melhorando a experiência de integração enquanto eliminam ambigüidades na configuração.

Conclusão

Em resumo, Thinkless personifica uma ferramenta visionária que redefine como os LLMs interagem com tarefas de raciocínio intrincadas, promovendo significativamente a eficiência computacional e a precisão das respostas. Ao aproveitar seu design inovador e aplicações práticas em cenários do mundo real, Thinkless se destaca como um recurso crucial para pesquisadores e profissionais no campo em rápida evolução da inteligência artificial. O envolvimento em seu desenvolvimento contínuo garante que não apenas atenda às demandas atuais, mas se adapte às necessidades futuras no âmbito dos grandes modelos de linguagem e raciocínio avançado.

Prós e Contras

Prós

- Emprega raciocínio adaptativo para melhorar a eficiência na execução de tarefas.

- Utiliza um modelo de aprendizado por reforço único com tokens de controle duplo.

- Reduz significativamente o uso de raciocínio de cadeia longa, melhorando a velocidade de computação.

Perguntas Frequentes

Thinkless é de código aberto e gratuito para usar.

De acordo com nossas informações mais recentes, esta ferramenta não parece ter uma oferta vitalícia no momento, infelizmente.

O algoritmo DeGRPO está no cerne da estrutura do Thinkless. Ele decompõe o objetivo de aprendizado do raciocínio híbrido em dois componentes separadamente: uma perda de token de controle e uma perda de resposta. Essa separação permite um controle detalhado sobre as contribuições de cada objetivo durante o treinamento. A perda de token de controle determina como o modelo escolhe entre raciocínio de formato curto e longo, enquanto a perda de resposta melhora a precisão das respostas geradas. Ao estabilizar o treinamento e prevenir colapsos, o DeGRPO melhora significativamente o desempenho em vários benchmarks de raciocínio.

O Thinkless melhora a eficiência computacional ao permitir que os modelos de linguagem selecionem de forma adaptativa entre raciocínio de curto e longo prazo, dependendo da complexidade da tarefa e das capacidades do modelo. Ao reduzir a necessidade de raciocínio em cadeia longa em 50% a 90%, o Thinkless minimiza o consumo de recursos durante a inferência, mantendo ou até melhorando a precisão dos resultados. Isso o torna mais eficiente do que as abordagens de raciocínio tradicionais em grandes modelos de linguagem.

Para instalar o Thinkless, você precisa criar um ambiente com Python 3.10 e as dependências necessárias. Especificamente, use o Conda para criar um novo ambiente e instalar pacotes como PyTorch, LM_eval e Ray. Para suporte a CUDA, certifique-se de instalar a versão correspondente do NVIDIA CUDA. Comandos detalhados de instalação estão disponíveis no README do projeto no GitHub. Consulte a documentação para quaisquer requisitos adicionais com base na configuração do seu sistema.

Sim, o Thinkless foi projetado para se integrar a frameworks populares de aprendizado de máquina, como o PyTorch, conforme indicado pela instalação do pacote torch como uma dependência. Como é construído usando ferramentas padrão, os usuários podem interagí-lo com outras bibliotecas e frameworks para tarefas como processamento de dados e treinamento adicional de modelos. Os usuários podem consultar as instruções de instalação e uso no repositório do GitHub para obter uma compreensão melhor da integração.

Para começar rapidamente com o Thinkless, você primeiro precisará configurar seu ambiente de programação com a versão e as bibliotecas necessárias do Python. Após ativar seu ambiente Conda, você pode importar o AutoModelForCausalLM e o AutoTokenizer da biblioteca transformers. A partir daí, carregue o modelo Thinkless e prepare seus comandos de entrada para raciocínio. A documentação do projeto inclui trechos de código de exemplo para orientá-lo na geração de respostas e na avaliação eficaz das saídas do modelo.

Você pode avaliar o desempenho do modelo Thinkless usando os scripts de avaliação fornecidos no repositório, que permitem executar múltiplas repetições de inferência. Isso ajudará a reunir resultados para diferentes tarefas e métricas. A ferramenta de avaliação é baseada em prompts no OpenAI/simple-evals, e você pode executar comandos de avaliação para gerar métricas a partir dos resultados salvos em calcs, como precisão e qualidade de resposta, que ajudam a entender as capacidades do modelo.

Embora o Thinkless melhore significativamente a eficiência em tarefas de raciocínio, as limitações potenciais incluem a dependência da qualidade do modelo inicial e da qualidade dos dados de treinamento. O algoritmo também pode não desempenhar de forma otimizada em tarefas de raciocínio específicas e altamente complexas que requerem uma compreensão profunda do contexto. Além disso, a afinação de hiperparâmetros como thinkless_alpha e correct_think_reward pode exigir experimentação para alcançar os melhores resultados, o que pode ser demorado.

Para ajustar o Thinkless, você pode começar alterando os hiperparâmetros, como thinkless_alpha e correct_think_reward. Se a convergência for lenta ou se o modelo tender a um modo específico de raciocínio, considere aumentar esses parâmetros gradualmente para melhorar o desempenho. Experimentar com diferentes conjuntos de dados de treinamento e técnicas descritas na documentação do projeto também pode ajudar a otimizar o desempenho com base em seu caso de uso específico.