Siga para atualizações e ofertas

Receba alertas sobre descontos, lançamentos de recursos e mudanças de preços do vui

Ferramentas Similares

O que é vui?

VUI é uma ferramenta inovadora focada em modelos de fala conversacional projetados para operar diretamente em dispositivos, fornecendo uma solução eficiente e amigável para tarefas relacionadas à fala. Os principais modelos disponíveis no kit de ferramentas VUI são treinados em extensos conjuntos de dados, permitindo que eles processem áudio de forma eficaz e produzam respostas contextualmente relevantes.

Principais Recursos Atualizados:

- Múltiplos Modelos: Vui oferece uma variedade de modelos, incluindo Vui.BASE, Vui.ABRAHAM e Vui.COHOST, cada um otimizado para diferentes tipos de interações conversacionais. Vui.BASE foi especificamente treinado em 40 mil horas de conversas em áudio, proporcionando uma base robusta para várias aplicações.

- Clonagem de Voz: Os usuários podem aproveitar os modelos para capacidades de clonagem de voz, permitindo que eles repliquem vozes com precisão razoável com base nos conjuntos de dados pré-treinados. A capacidade de clonar vozes é aprimorada, mas é notado que os resultados podem não ser perfeitos devido a limitações nos dados de treinamento.

- Eficiência: Os modelos são projetados para funcionar efetivamente em dispositivos sem a necessidade de extensos recursos de cloud, tornando-os ideais para aplicações que requerem baixa latência e alta responsividade. Os modelos VUI utilizam um transformador baseado em llama que prevê tokens de áudio, apresentando avanços na arquitetura do modelo que melhoram sua eficiência operacional.

- Tokenização de Áudio: Um recurso significativo é o tokenizador de áudio fluac, que reduz efetivamente o número de códigos por segundo, aumentando a velocidade geral de processamento de 83,1hz para 21,53hz.

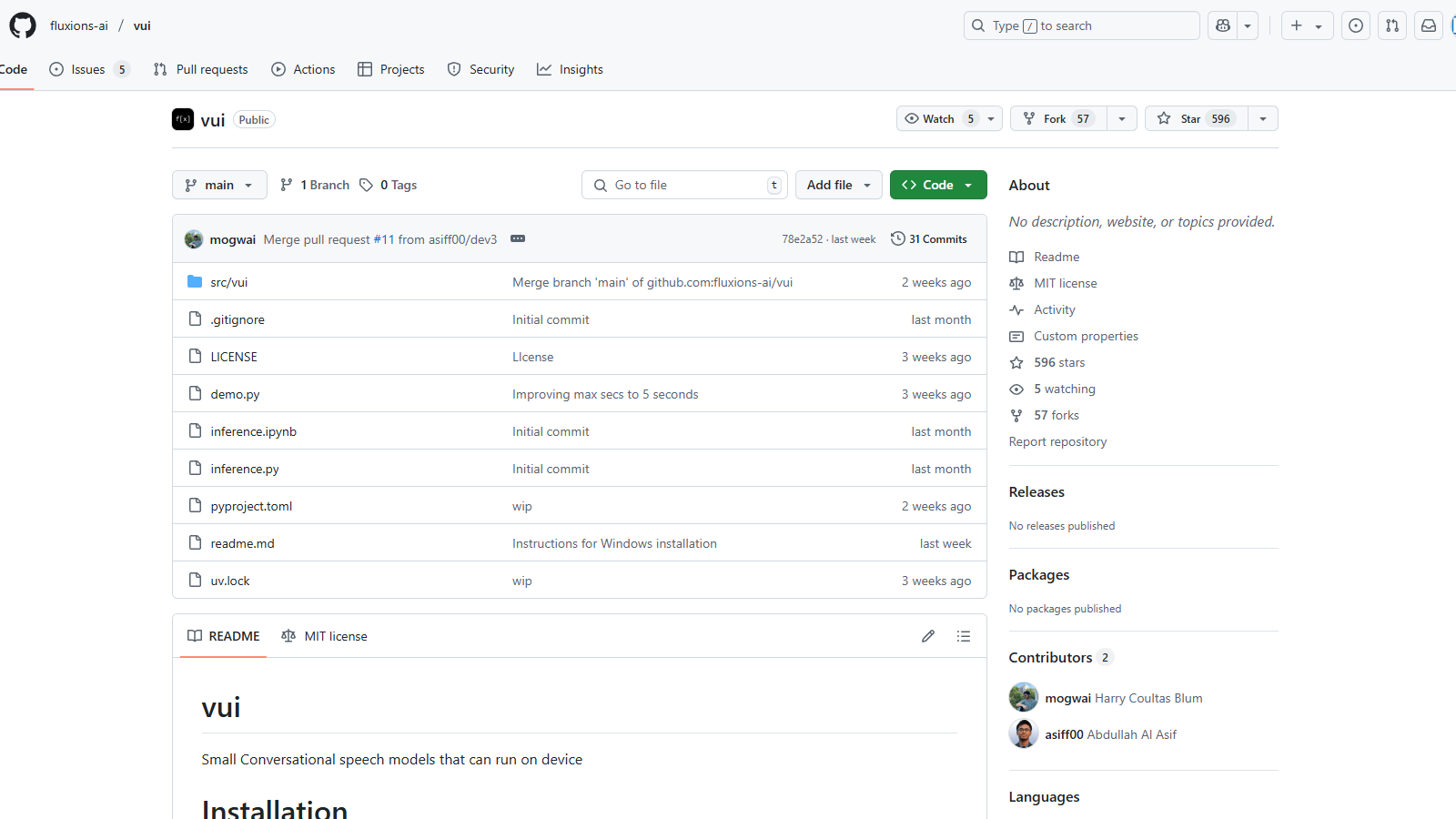

Instalação e Uso:

Para começar a usar o VUI, os usuários podem facilmente instalá-lo via um gerenciador de pacotes usando o comando pip install -e .. O processo de instalação é simples, e uma demonstração pode ser executada com o comando python demo.py. Essa flexibilidade permite que desenvolvedores implementem os modelos em várias aplicações, melhorando as experiências dos usuários com funcionalidades contínuas de reconhecimento e geração de fala.

Desafios e Considerações:

Embora os modelos mostrem capacidades impressionantes, eles não estão sem limitações. Os usuários podem experimentar algumas peculiaridades, como alucinações ocasionais, que ocorrem quando o IA gera respostas que não são baseadas em seus dados de treinamento. Essa realidade é reconhecida pela equipe de desenvolvimento enquanto busca por melhorias contínuas e engajamento da comunidade.

Apesar desses desafios, os modelos VUI representam um avanço significativo na IA conversacional, particularmente para projetos que visam aprimorar a interatividade por meio da voz. A equipe de desenvolvimento enfatiza a melhoria contínua, compartilhando percepções e abordando questões com base no feedback da comunidade. Este compromisso com o desenvolvimento é apoiado pela utilização de tecnologias de ponta e esforços colaborativos com outros projetos de código aberto.

Atribuições:

O desenvolvimento do VUI reconhece contribuições de vários projetos de código aberto, incluindo Whisper da OpenAI e Audiocraft da Facebook Research, exibindo um esforço comunitário em direção à construção de ferramentas robustas para processamento de fala. Através dessas colaborações, o VUI aprimora suas ofertas e mantém relevância na área de tecnologia de processamento de áudio em rápida evolução.

Prós e Contras

Prós

- Oferece pequenos modelos de fala conversacional que podem ser executados no dispositivo sem precisar de suporte em nuvem.

- Inclui modelos de único falante e de dois falantes com consciência de contexto para aplicações versáteis.

- Utiliza um transformador baseado em lhama para previsão de tokens de áudio, melhorando o desempenho.

Contras

- A clonagem de voz não é perfeita devido a dados e recursos de treinamento limitados.

Perguntas Frequentes

vui é de código aberto e gratuito para usar.

De acordo com nossas informações mais recentes, esta ferramenta não parece ter uma oferta vitalícia no momento, infelizmente.

{toolName} oferece três modelos principais: Vui.BASE, que é o ponto de verificação base treinado com 40 mil horas de conversas em áudio; Vui.ABRAHAM, projetado como um modelo de único orador capaz de respostas contextualmente conscientes, e Vui.COHOST, que permite a comunicação entre dois oradores. Esses modelos atendem a diversos casos de uso, variando de interações conversacionais fundamentais a diálogos complexos entre múltiplas partes.

Sim, você pode executar {toolName} localmente. Para instalá-lo, use o comando pip com a seguinte sintaxe: 'pip install -e .'. Isso instalará a ferramenta em modo editável. Certifique-se de ter o Python instalado no seu dispositivo para a configuração. Siga a documentação README no repositório para passos detalhados e requisitos.

Embora o {toolName} ofereça capacidades de clonagem de voz, é importante notar que o modelo base pode não produzir resultados perfeitos devido a um conjunto de dados de treinamento limitado. O modelo não recebeu entradas de áudio extensas, resultando em inconsistências ao clonar vozes específicas. Os usuários devem gerenciar suas expectativas e considerar este aspecto ao usar o recurso de clonagem de voz.

{toolName} utiliza uma técnica robusta de tokenização de áudio, desenvolvida em colaboração com o Fluac, que é baseada no Descript-Audio-Codec. Isso reduz significativamente o número de códigos de áudio processados, diminuindo de 83,1 Hz para 21,53 Hz, permitindo um manuseio de dados mais eficiente durante o processamento de áudio. Essa melhoria possibilita previsões de voz mais rápidas e precisas.

Para um desempenho ideal, o {toolName} deve ser executado em hardware de alto desempenho, especificamente em configurações equipadas com GPUs NVIDIA 4090, conforme indicado por seu desenvolvedor. A utilização de hardware tão potente reduz o tempo de processamento e melhora a capacidade do modelo de lidar com operações de áudio intensivas.

Sim, o {toolName} realmente apresenta alucinações, onde a saída pode não estar alinhada com a realidade. Este é um desafio comum no desempenho dos modelos de IA, especialmente quando treinados com recursos limitados. Os usuários devem estar cientes disso e verificar a precisão de saídas críticas.

Integrar o {toolName} com outras ferramentas, como o Whisper e o Audiocraft, pode expandir suas capacidades. O Whisper ajuda no reconhecimento de fala robusto, enquanto o Audiocraft pode aprimorar os recursos de processamento de áudio. Explorar essas parcerias pode elevar significativamente a experiência do usuário e a funcionalidade do {toolName}.

O {toolName} está hospedado no GitHub, onde os usuários podem encontrar suporte da comunidade através de problemas e discussões. Para orientações detalhadas sobre o uso, os usuários devem consultar a documentação README fornecida no repositório. Participar da comunidade também pode trazer dicas valiosas de solução de problemas e insights de outros usuários.