关注以获取更新和优惠

获取关于Hugging Face折扣、功能发布和价格变动的提醒

什么是Hugging Face?

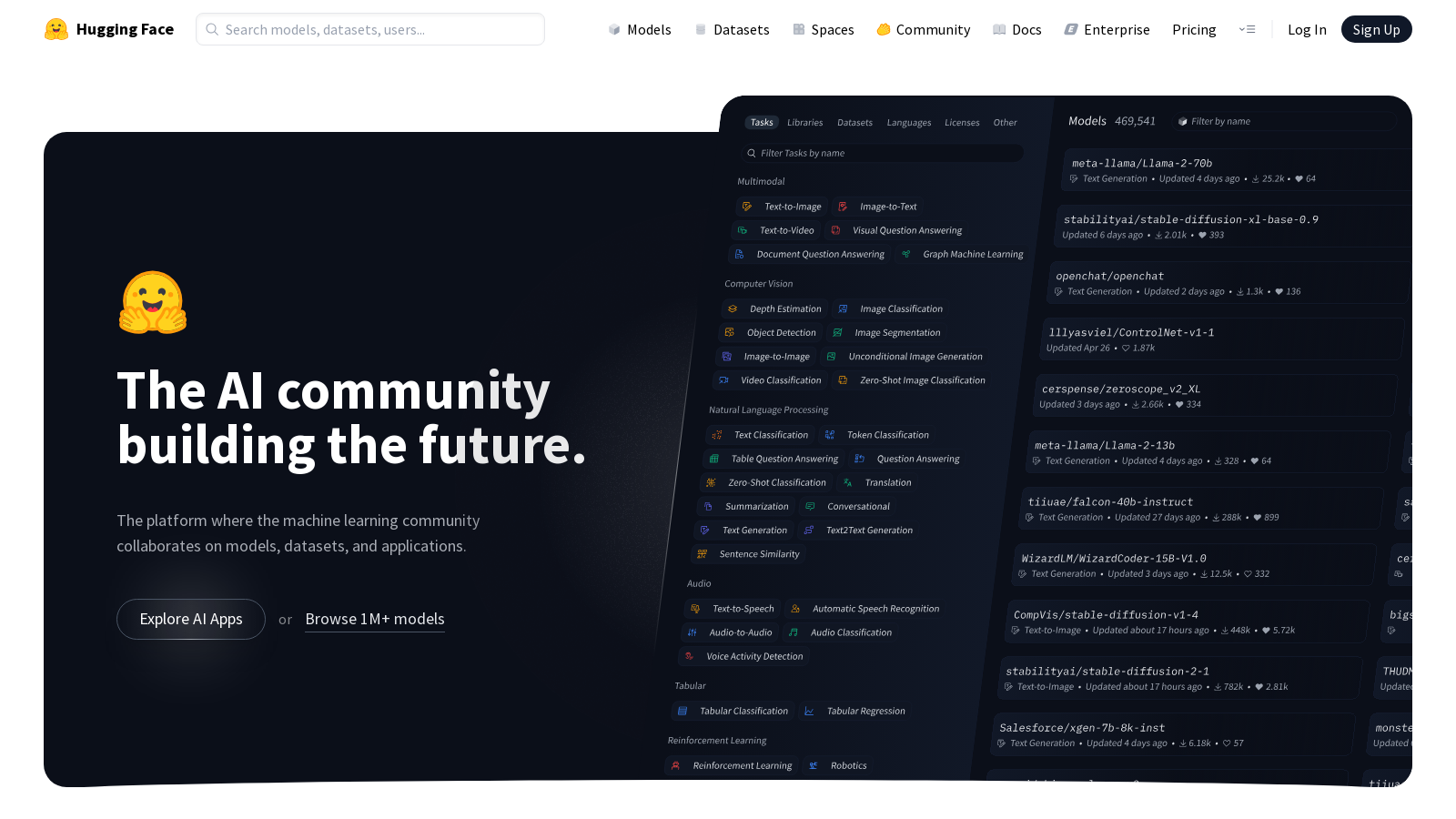

Hugging Face 正在通过建立一个以社区为中心的平台,革新人工智能领域,旨在通过开源和开放科学推动和实现 AI 的民主化。作为机器学习爱好者、研究人员和开发者的首选中心,Hugging Face 使用户能够无缝协作于模型、数据集和应用程序。

Hugging Face Hub 是一个集中式的存储库,用于分享和发现超过 200 万个模型 和 100 万个应用程序,这是任何致力于推动 AI 边界的人不可或缺的资源。凭借对集体增长的承诺,Hugging Face 允许用户托管无限数量的公共模型和数据集,同时确保强大的社区支持。

对于希望增强能力的组织,该平台提供 付费计算和企业解决方案。企业计划的订阅者可以从 每用户每月 NULL 开始,转变他们的 AI 策略,解锁单点登录 (SSO)、优先支持和全面审计日志等高级功能,以保持对其 AI 操作的严格监督。

此外,Hugging Face 还开发了一个令人印象深刻的开源技术栈,推动协作研究与开发。它涵盖了多种模态,包括文本、图像、音频、视频和 3D 内容,使用户能够在蓬勃发展的社区中有效地创建和展示他们的作品集。

主要功能

Hugging Face 的多种功能旨在优化机器学习过程:

- 计算解决方案:该平台提供优化的推断端点,支持主要的深度学习框架,如 PyTorch、TensorFlow 和 JAX。这使用户能够轻松部署他们的模型,只需几次点击。

- 开源承诺:Hugging Face 极大地支持开源贡献,提供访问一套高质量机器学习库的权限,包括 Transformers、Diffusers 和 Tokenizers。

- 文档与社区:丰富的文档和充满活力的社区使学习和使用机器学习工具变得更容易,无论是对新手还是经验丰富的用户。

协作与学习资源

除了模型托管和计算服务外,Hugging Face 还以提供广泛的学习资源而自豪,旨在提升用户的 AI 技能:

- Hugging Face 博客 特色教程、更新和行业专家提供的思想领导内容,使用户了解 AI 的最新发展。

- 课程和教程:各种课程涵盖广泛的主题,从大型语言模型到应用程序开发,确保用户获得全面的教育材料。

这种技术资源与支持社区的结合巩固了 Hugging Face 作为任何认真追求人工智能职业的人的基本工具。

优缺点

优点

- Hugging Face 主办了超过 100 万个模型和 40 万个应用程序,支持多样的机器学习任务。

- 该平台支持用于构建、共享和发现机器学习模型的协作工具。

- 它提供了一个多功能系统,能够管理文本、图像、音频和 3D 数据的模型。

缺点

- 选项的丰富可能会让对机器学习概念不熟悉的新用户感到不知所措。

常见问题

Hugging Face 可以免费使用,付费计划从 20 到 0 USD 每 月。

根据我们最新的信息,该工具目前似乎没有终身优惠,很遗憾。

Hugging Face 提供了多种类别的各类模型,包括文本生成、图像分类、语音识别等。您可以在文本、图像、视频、音频,甚至 3D 等多种模态中发现超过 100 万个模型。用户可以根据特定任务、库(如 PyTorch、TensorFlow 和 JAX)以及参数等进行筛选。这一广泛的资源库使开发者和研究人员能够找到最适合其具体需求的模型。

要开始使用 Hugging Face,首先在他们的平台上创建一个账户。您可以开始探索 Hugging Face Hub 上提供的各种模型和数据集。对于机器学习新手,Hugging Face 提供了详尽的文档和教程,涵盖关键领域,包括 Transformers、Datasets 和 Diffusers。此外,可以考虑参加 Hugging Face 提供的在线课程,这些课程涉及大型语言模型和深度强化学习等主题,以提升您的技能。

Spaces 是 Hugging Face 的 AI 应用程序目录,提供了一个平台供开发者创建、分享和发现机器学习应用。应用的范围可以从生成图像和文本到数据可视化等多种功能。您可以通过选择一个模型并与 Hugging Face 的功能进行集成,轻松创建一个 Space,使用户能够体验您的应用。Spaces 支持协作元素,使用户能够分享和学习彼此的作品。

PEFT,即参数高效微调(Parameter-Efficient Fine-Tuning),是一个旨在简化将大型预训练模型适应特定任务的库,无需微调所有模型参数。通过仅允许训练模型参数的一个小子集,PEFT显著降低了计算成本并加快了处理速度,使开发人员更容易、更便捷地在消费者硬件上部署大型模型。

虽然 Hugging Face 提供了广泛的免费套餐,但用户可能会遇到一些限制,例如较低的 GPU 使用配额和对某些高级功能的访问。对于需要更好性能、优先支持和额外存储的组织或个人,建议升级到 Pro 或 Enterprise 计划。寻求商业用途或高级部署的用户也可以通过这些付费选项来提升他们的体验。

可以,Hugging Face 模型可以通过他们的推理 API(Inference API)集成到各种应用程序中,这使得模型的部署和访问变得更加简便。该 API 允许你从任何应用程序提供模型和运行推理,无论你是在使用网页应用程序还是本地脚本。此外,Hugging Face 的库,如 Transformers 和 Diffusers,提供了将模型纳入 Python 代码的简单方法。

Hugging Face 为遇到问题的用户提供了强大的支持渠道。社区论坛和 Discord 频道可供用户互动,您可以在这里提问和分享解决方案。此外,机构用户可以在 Pro 和 Enterprise 计划中访问高级支持选项,确保他们在遇到任何技术挑战时获得专门的帮助。

从 Hugging Face 部署模型用于生产环境非常简单,您可以使用它们的推理端点(Inference Endpoints),这使得在专用基础设施上无缝部署 Hugging Face Hub 上的任何模型变得可能。您可以轻松设置这些端点,管理它们以实现可扩展性,并优化成本。根据您的使用情况和需求,提供了不同的计费等级供您选择,以满足您的生产需求。