关注以获取更新和优惠

获取关于Ollama折扣、功能发布和价格变动的提醒

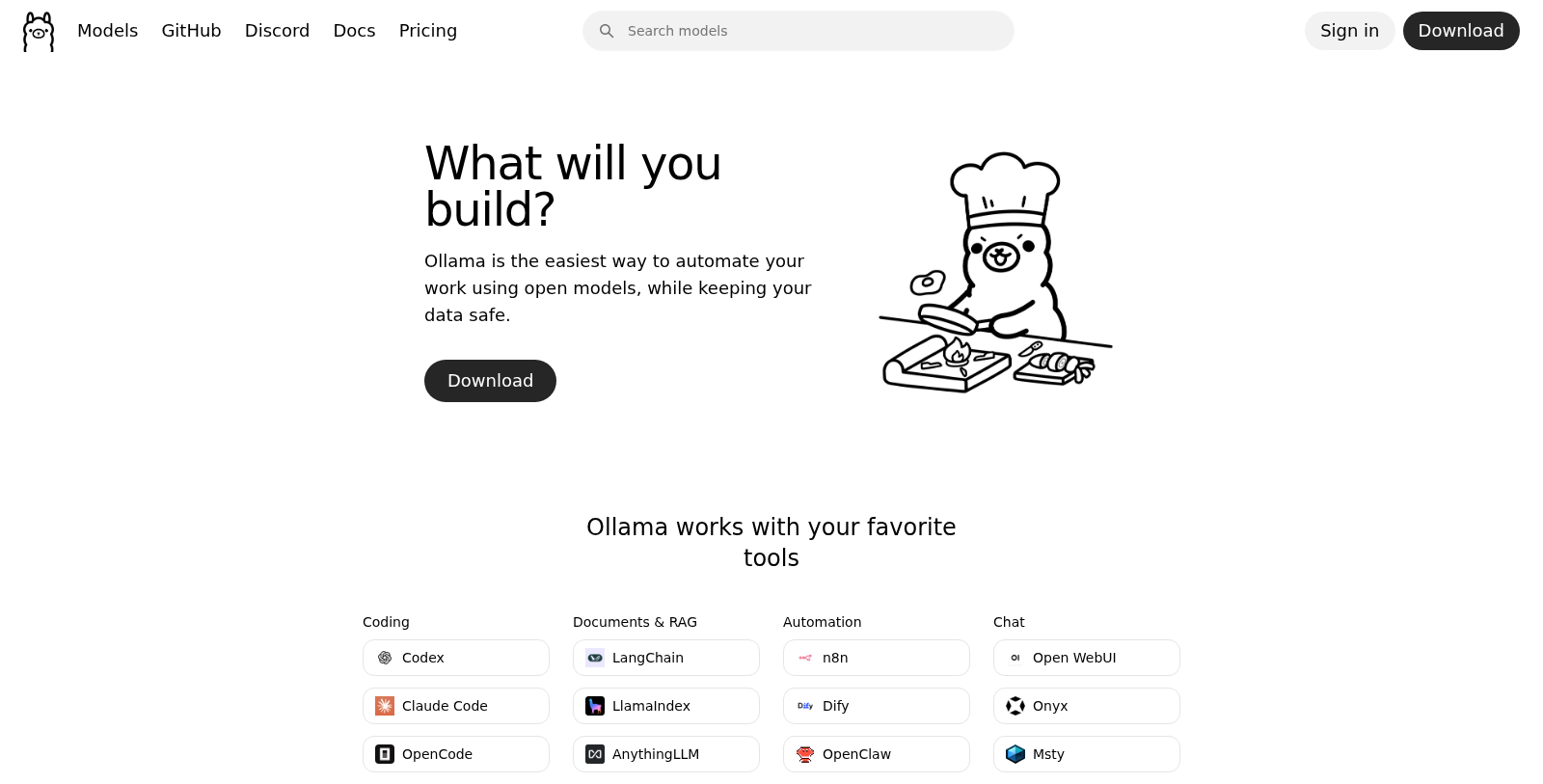

什么是Ollama?

Ollama 是一款强大的工具,简化了使用大型语言模型进行自动化工作的过程。用户可以轻松地将他们喜欢的模型集成到各种应用中,同时确保数据隐私和效率。

该平台提供三种不同的计划,以满足不同需求:免费、专业和最大计划。免费计划提供基本集成和使用,使用户能够免费自动化任务。专业计划定价为每月 20 美元,提供扩展功能,包括能够同时运行多个云模型、增强的云使用、私有模型和协作能力。对于从事更重任务的用户,最大计划每月 100 美元,可实现更广泛的云模型使用、更多合作者以及全面的任务处理能力。

Ollama 的一个关键好处是对数据隐私的承诺。用户可以在本地硬件上运行任务,同时利用云能力处理更大的模型,确保敏感信息的安全。

Ollama 支持与编码工具、文档分析和自动化过程的广泛集成,得益于超过 40,000 个社区驱动的集成。这使其适用于各种应用,从自动化编码任务到管理文档结构。

模型和使用

使用 Ollama,用户可以在项目中利用多种模型,例如 gpt-oss、DeepSeek-R1 等。该平台的设计根据用户需求适应轻到重的使用,使用限制根据每个计划量身定制。例如,免费用户接收轻度使用,适合基本交互。同时,专业和最大用户获得更强大的功能,适合持续工作和数据密集型任务。

社区与支持

Ollama 还培养了一个充满活力的社区,用户可以加入 Discord 频道、参与论坛,并访问广泛的文档,帮助他们最大限度地发挥工具的潜力并解决任何问题。社区库进一步丰富了生态系统,使用户能够在现有功能基础上进行构建并共享改进。

安全特性

数据安全对于 Ollama 至关重要,因为该平台明确声明在使用过程中不会记录任何提示或响应数据。这意味着敏感信息保留在本地计算机上,云模型请求在传输过程中经过加密,以增加安全性。

未来计划

展望未来,Ollama 计划推出扩大团队和企业使用的功能,拓宽其在希望大规模使用大型语言模型的企业中的可及性。

总之,Ollama 旨在为个人开发者和寻求利用大型语言模型力量的组织提供服务,同时确保数据安全。简单明了的定价结构,加上强大的社区和多样化的集成选项,使其成为希望通过 AI 驱动的自动化优化工作流程的任何人的吸引选择。

优缺点

优点

- 支持模型的本地执行,确保数据隐私。

- 与各种工具集成,便于灵活的自动化任务。

- 允许对模型进行自定义和共享,增强了协作工作流程。

缺点

- 对于重负载,云模型的使用受限于订阅级别。

常见问题

Ollama 可以免费使用,付费计划从 0 到 100 USD 每 月。

根据我们最新的信息,该工具目前似乎没有终身优惠,很遗憾。

Ollama 在自动化任务方面特别有效,例如代码生成、文档分析和使用大型语言模型的一般数据处理。它可以用于开发编码代理、进行快速的文档分析,并与 n8n 和 Dify 等自动化工具无缝集成,从而实现各个行业的高效工作流程。

可以!Ollama旨在完全离线运行在您自己的硬件上,这非常适合隔离环境。云功能是可选的,让您在本地利用大型语言模型的同时,保持数据的私密性。

Ollama 支持多种针对编码任务优化的模型。值得注意的是,推荐使用 glm-4.7-flash 模型,因为它支持代理功能。此外,您还可以与 Ollama 一起使用流行的工具,如 Codex、Claude Code 和 OpenCode,以提升编码生产力。

Ollama允许您预加载模型,以实现更快的响应时间。默认情况下,模型在卸载前会在内存中保留5分钟。您可以通过使用'keep_alive'参数来管理这一点,以指定模型保留在内存中的时间,也可以直接配置Ollama服务器设置。这在需要快速访问的场景中,尤其有助于优化性能。

Ollama中的云模型有年龄限制,这些限制因计划而异。例如,免费计划支持轻量级任务,如聊天支持。相比之下,专业计划支持更复杂的任务,如数据分析。最大计划对工作负载有使用限制,例如编码代理和批处理。

当然可以!通过订阅,您可以创建私人模型并邀请合作者共同工作。每个模型的合作者数量限于Pro计划的3个和Max计划的5个,从而在平台内实现高效的团队合作。

Ollama 的环境变量可以根据您的操作系统进行配置。例如,在 macOS 上,使用 'launchctl' 来设置变量;而在 Linux 上,您需要调整 systemd 服务。在 Windows 上,您可以通过控制面板修改系统级环境变量。详细步骤请参阅配置文档。

Ollama 非常重视数据安全。它不会记录或存储任何提示或响应数据,并且所有的云请求在传输过程中都是加密的。这确保了您的数据隐私得以维护,并且您可以在本地运行模型,而无需将任何信息发送到外部服务器。