关注以获取更新和优惠

获取关于Thinkless折扣、功能发布和价格变动的提醒

什么是Thinkless?

Thinkless是一个创新的框架,旨在让大型语言模型(LLM)学会在生成响应之前何时进行批判性思考。通过利用基于强化学习的独特培训范式,Thinkless旨在优化大型语言模型(LLM)中的推理,使它们能够根据任务的复杂性选择短响应或长响应。最近,该框架进行了重大增强,巩固了其作为LLM自适应推理领先解决方案的地位。

Thinkless的核心创新在于其对解耦组相对策略优化(DeGRPO)算法的复杂利用。这种先进的方法战略性地将学习目标分为两个不同的组件:一个通过控制令牌损失来监督推理模式的选择,而另一个通过响应损失来提高生成答案的准确性。这种细致的分离不仅稳定了训练过程,还最小化了与LLM推理相关的计算负担,从而促进了更高效的操作。此外,该算法的改进增强了其稳定训练的能力,并防止了在类似方法的简单实现中常见的性能崩溃。

工作原理

Thinkless框架的核心由两个关键控制令牌组成:

主要特点

- 自适应推理:Thinkless根据任务的复杂性和模型的能力调整其响应生成,使其高度多样化。

- 增强效率:该框架显著减少了对广泛推理路径的需求,与各类基准测试的性能改进相关,减少长链思维需求的比例达到50-90%。

- 强化学习方法:Thinkless采用强化学习框架,不仅促进了对任务复杂性的更好理解,还预测何时深度推理是必要的。

- 经验结果:该框架的最新迭代在实证测试中表现出优越的结果,进一步验证了其对LLM培训和推理的创新方法。

安装与使用

设置Thinkless非常简单,可以直接在conda环境中执行。安装过程包括设置Python依赖项,从官方库下载相关模型组件,以及利用简单的命令行过程启动训练。用户通过库中的详细文档获得设置指导,增强了上手体验并消除了设置上的模糊。

结论

总之,Thinkless体现了一种前瞻性的工具,重新定义了LLM如何处理复杂推理任务,显著提升了计算效率和响应准确性。通过利用其创新设计和在现实世界场景中的实际应用,Thinkless成为快速发展的人工智能领域中研究人员和从业者的重要资源。对其持续发展的参与确保它不仅满足当前需求,而且适应未来在大型语言模型和高级推理领域中的需求。

优缺点

优点

- 采用自适应推理来提高任务执行的效率。

- 利用独特的双控制标记强化学习模型。

- 显著减少长链推理的使用,提升计算速度。

常见问题

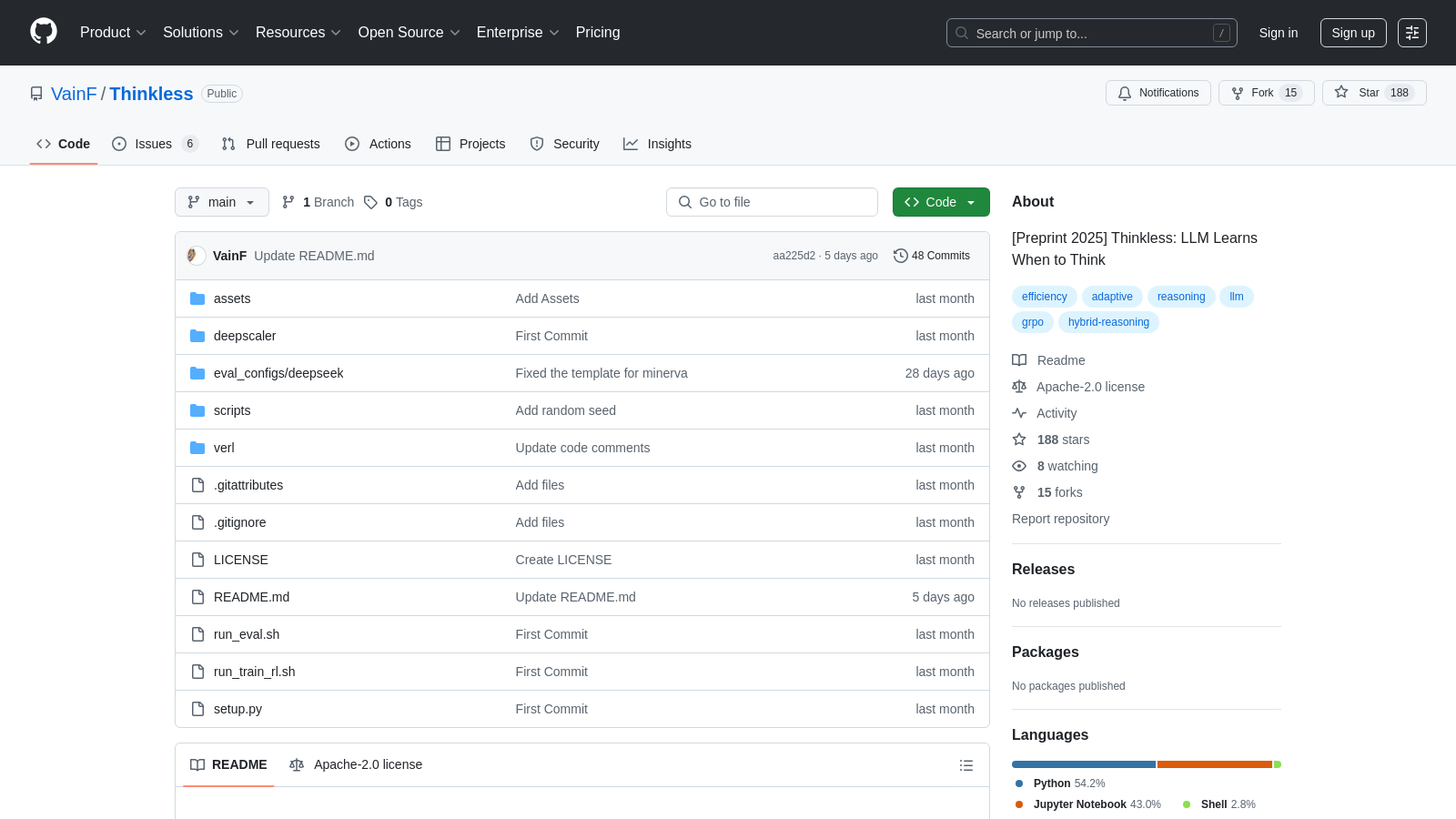

Thinkless 是开源的,可以免费使用。

根据我们最新的信息,该工具目前似乎没有终身优惠,很遗憾。

DeGRPO 算法是 Thinkless 框架的核心。它将混合推理的学习目标分解为两个独立的组件:控制令牌损失和响应损失。这种分离使得在训练过程中对每个目标的贡献进行更精细的控制。控制令牌损失决定模型在短期和长期推理之间的选择,而响应损失则提高生成答案的准确性。通过稳定训练并防止崩溃,DeGRPO 显著提高了在各种推理基准上的表现。

Thinkless通过使语言模型根据任务复杂性和模型能力自适应地选择短期推理和长期推理,从而增强计算效率。通过将长链思维的必要性减少50%到90%,Thinkless在保持或甚至提高结果准确性的同时,最小化了推理过程中的资源消耗。这使其在大型语言模型中的效率优于传统的推理方法。

要安装 Thinkless,您需要创建一个具有 Python 3.10 和必要依赖项的环境。具体来说,使用 Conda 创建一个新环境,并安装如 PyTorch、LM_eval 和 Ray 等包。对于 CUDA 支持,请确保安装相应版本的 NVIDIA CUDA。详细的安装命令可在项目的 GitHub README 中找到。请确保根据您的系统设置查阅文档以获取任何其他要求。

可以,Thinkless 设计上可以与流行的机器学习框架集成,如 PyTorch,这一点通过安装 torch 软件包作为依赖项可以看到。由于它是使用标准工具构建的,用户可以将其与其他库和框架进行接口,以执行数据处理和额外模型训练等任务。用户可以参考 GitHub 仓库中的安装和使用说明,以更好地了解集成方式。

要快速开始使用 Thinkless,您首先需要设置具有所需 Python 版本和库的编程环境。激活您的 Conda 环境后,您可以从 transformers 库中导入 AutoModelForCausalLM 和 AutoTokenizer。接下来,加载 Thinkless 模型并准备您的输入提示进行推理。项目文档中包含示例代码片段,以帮助您生成响应并有效评估模型输出。

您可以使用存储库中提供的评估脚本来评估Thinkless模型的性能,这些脚本允许您运行多次推理重复。这将有助于为不同的任务和指标收集结果。评估工具基于OpenAI/simple-evals中的提示,您可以运行评估命令,从保存在calcs中的结果生成指标,例如准确性和响应质量,这将有助于理解模型的能力。

虽然 Thinkless 在推理任务中显著提高了效率,但其潜在限制包括对初始模型质量和训练数据质量的依赖。该算法在某些需要深入理解上下文的特定高度复杂的推理任务中,可能表现不佳。此外,调整超参数如 thinkless_alpha 和 correct_think_reward 可能需要实验以实现最佳效果,这可能会耗费时间。

在微调Thinkless时,您可以首先调整超参数,例如thinkless_alpha和correct_think_reward。如果收敛速度很慢或模型倾向于某种特定的推理模式,可以考虑逐步增加这些参数以提高性能。根据您的具体使用案例,尝试不同的训练数据集和项目文档中列出的技术也可以帮助优化性能。